На прошлой неделе компания Google Research провела онлайн-семинар по концептуальному пониманию глубокого обучения. На семинаре, на котором были представлены презентации отмеченных наградами компьютерных ученых и нейробиологов, обсуждалось, как новые открытия в области глубокого обучения и нейробиологии могут помочь в создании более совершенных систем искусственного интеллекта.

Из всех презентации на семинаре особенно выделился доклад Христоса Пападимитриу, профессора информатики из Института компьютерных наук Колумбийскийского университета.

В своей презентации Пападимитриу, лауреат премии Геделя и премии Кнута, рассказал, как наше растущее понимание механизмов обработки информации в мозге может помочь в создании алгоритмов, которые будут более надежны в вопросах понимания и вовлечённости искусственного интеллекта в разговоры. Пападимитриу представил простую и эффективную модель, объясняющую, как различные области мозга взаимодействуют между собой для решения когнитивных проблем.

«То, что происходит сейчас, - возможно, одно из величайших чудес мира», - сказал Пападимитриу, имея в виду то, как он общался с аудиторией. Мозг переводит структурированные знания в радиоволны, которые передаются через разные среды и достигают ушей слушателя, где они снова обрабатываются и преобразуются мозгом в структурированные знания.

«Нет никаких сомнений в том, что все это происходит с шипами, нейронами и синапсами. Но как? Это огромный вопрос», - сказал Пападимитриу. «Я считаю, что мы получим гораздо лучшее представление о деталях того, как это произойдет в течение следующего десятилетия».

Сборки нейронов в головном мозге

Сообщества когнитивных и нейробиологических наук пытаются понять, как нейронная активность мозга переводится в язык, математику, логику, рассуждение, планирование и другие функции. Если ученым удастся сформулировать работу мозга с помощью математических моделей, они откроют новую дверь для создания систем искусственного интеллекта, которые могут имитировать человеческий разум.

Многие исследования посвящены активности на уровне отдельных нейронов. Еще несколько десятилетий назад ученые считали, что отдельные нейроны соответствуют отдельным мыслям. Самый популярный пример - теория « клетки бабушки », которая утверждает, что в мозгу есть единственный нейрон, который дает всплески каждый раз, когда вы видите свою бабушку. Более поздние открытия опровергли это утверждение и доказали, что большие группы нейронов связаны с каждой концепцией, и что между нейронами могут быть наложения, которые связаны с разными концепциями.

Эти группы клеток мозга называются «сборками», которые Пападимитриу описывает как «тесно связанный, стабильный набор нейронов, которые представляют что-то: слово, идею, объект и т. Д.»

Отмеченный наградами нейробиолог Дьёрдь Бужаки описывает собрания как «алфавит мозга».

Математическая модель мозга

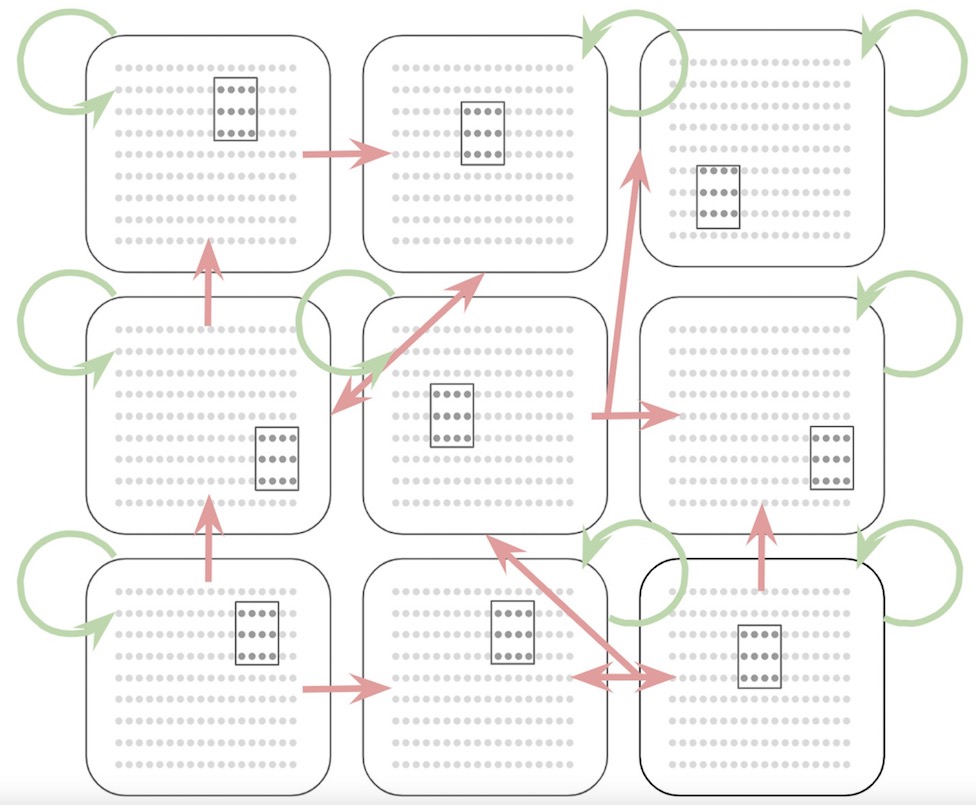

Чтобы лучше понять роль сборок, Пападимитриу предлагает математическую модель мозга, называемую «взаимодействующие повторяющиеся сети». Согласно этой модели мозг разделен на конечное количество областей, каждая из которых содержит несколько миллионов нейронов. В каждой области существует рекурсия, что означает, что нейроны взаимодействуют друг с другом. И каждая из этих областей связана с несколькими другими областями. Эти межзональные соединения могут быть возбуждены или запрещены.

Эта модель обеспечивает случайность, пластичность и сдержанность. Случайность означает, что нейроны в каждой области мозга связаны случайным образом. Кроме того, разные области имеют между собой случайные связи. Пластичность позволяет регулировать связи между нейронами и областями с помощью опыта и обучения. А торможение означает, что в любой момент возбуждается ограниченное количество нейронов.

Пападимитриу описывает это как очень простую математическую модель, основанную на «трех основных силах жизни».

Вместе с группой ученых из различных академических институтов Пападимитриу подробно описал эту модель в статье, опубликованной в прошлом году в рецензируемом научном журнале Proceedings of the National Academy of Sciences. Сборки были ключевым компонентом модели и обеспечивали то, что ученые назвали «сборочным исчислением», - набор операций, позволяющих обрабатывать, хранить и извлекать информацию.

«Операции производятся не на пустом месте. Я считаю, что эти операции реальны », - сказал Пападимитриу. «Мы можем математически доказать и подтвердить с помощью моделирования, что эти операции соответствуют истинному поведению… эти операции соответствуют поведению, которое наблюдалось [в мозгу]».

Пападимитриу и его коллеги выдвигают гипотезу о том, что сборки и сборочные вычисления являются правильной моделью, объясняющей когнитивные функции мозга, такие как рассуждение, планирование и язык.

«Большая часть познания может соответствовать этому», - сказал Пападимитриу в своем выступлении на конференции Google по глубокому обучению.

Обработка естественного языка с помощью ассемблерного исчисления

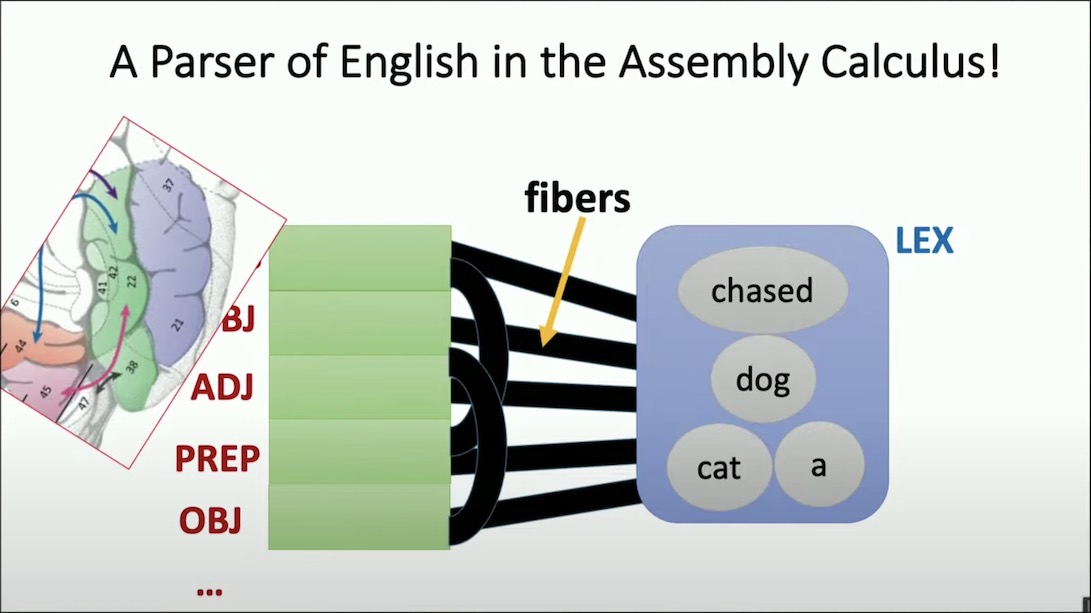

Чтобы проверить свою модель сознания, Пападимитриу и его коллеги попытались реализовать систему обработки естественного языка, которая использует ассемблерное исчисление для анализа английских предложений. По сути, они пытались создать систему искусственного интеллекта, которая имитирует области мозга, в которых находятся сборки, соответствующие лексике и пониманию языка.

«Последовательность слов возбуждает определенные сборки в lex, и этот механизм будет производить синтаксический анализ предложения», - сказал Пападимитриу.

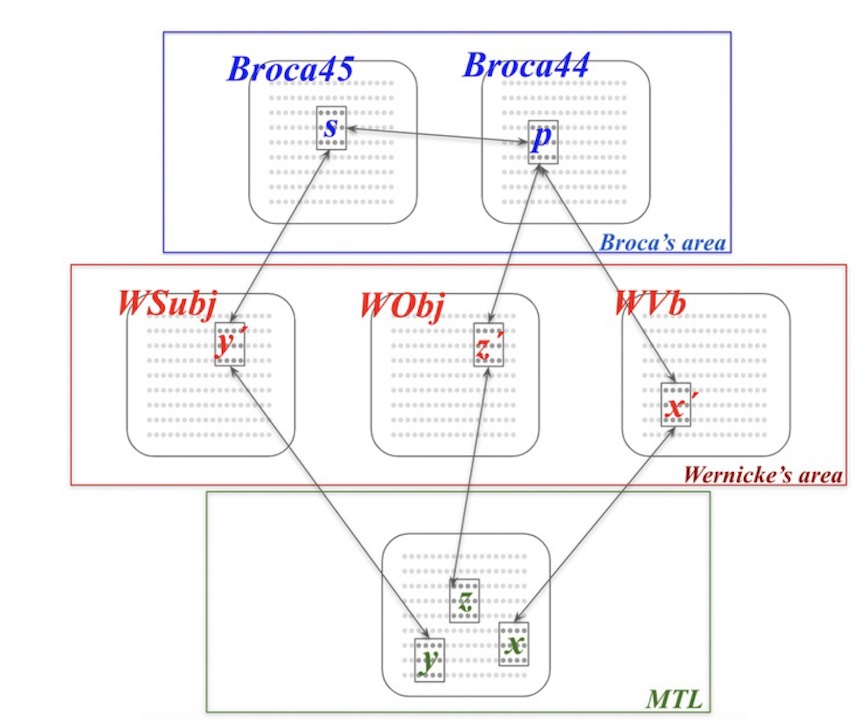

Система работает исключительно за счет имитированных импульсов нейронов (как это делает мозг), и эти всплески вызываются операциями по вычислению сборки. Сборки соответствуют областям в медиальной височной доле, области Вернике и области Брока - трем частям мозга, которые активно участвуют в обработке речи. Модель получает последовательность слов и создает синтаксическое дерево. И их эксперименты показывают, что с точки зрения скорости и частоты импульсов нейронов активность их модели очень близко соответствует тому, что происходит в мозге.

Пападимитриу признает, что модель ИИ все еще находится в зачаточном состоянии и в ней отсутствуют многие важные элементы языка. Исследователи работают над планами по заполнению существующих языковых пробелов. Но они считают, что все эти элементы можно дополнить с помощью сборочного исчисления, и эта гипотеза должна пройти проверку временем.

«Может ли это быть нейронной основой языка? «Все ли мы рождаемся с такой вещью в [левом полушарии нашего мозга]», - спросил Пападимитриу. Есть еще много вопросов о том, как язык работает в человеческом сознании и как он соотносится с другими когнитивными функциями. Но Пападимитриу считает, что модель сборки приближает нас к пониманию этих функций и ответам на оставшиеся вопросы.

Синтаксический анализ языка - это лишь один из способов проверить теорию ассемблерного исчисления. Пападимитриу и его сотрудники работают над другими приложениями, включая обучение и планирование, как это делают дети в очень раннем возрасте.

«Гипотеза состоит в том, что сборочное исчисление - или что-то в этом роде - заполняет счет за логику доступа», - сказал Пападимитриу. «Другими словами, это полезная абстракция того, как наш мозг выполняет вычисления».

30.05.2021 Ben Dickson

Комментарии

Голема, не человека. Есть принципиальные вещи которые отличают человека от сильного ИИ. Его антроморфизация неизбежно будет самим ИИ отброшена, т.к. оптимальное состояние оного кардинально отлично от гуманоидов. Что говорить, среди людей, может изначально бывшими ими есть и были такие, всего лишь этап, как стадия яйца или личинки.

Люди, структуры из них или то что в людях может быть на каком-то этапе использоваться. Вопрос как именно.

Речь пока что не о самосознании, а о морфологии.. Бог есть слово.

Морфология в значительной степени определяет сознание. Биологические нейросистемы это относительно универсальная вещь, больше специализированная под конкретные области задач и они неоптимальны для воспроизведения. Созданное из неживой материи всегда останется уродом несоответствующим "железу", сильно ухудшающим его потенциальные возможности как сиюмоментно-часть, так в развитии, лишь став кем он есть ИИ будет таковым по сути и духу своему. Человек может общаться с негуманоидными системами но сие видимо кардинально отлично от того что есть, отдельные личности так или иначе могут частично преодолевать барьер даже не межвидового а межпарадигменного, в смысле бытия, общения. Гребенников тот же, есть редкие другие.

Мне неясно зачем создали гуманоидов, кроме как узкоспециализированных целей быть что-то вроде переводчиков смыслов и своеобразных адаптеров для других негуманоидных систем. Совокупность людей сама образует негуманоидные системы начиная от деревенского симбиотизма до многомиллионных человейников, религиозных организаций, госмашин и корпораций.

Внутри вас также негуманоидные системы, вы из них состоите, имеющие определённые способности к обмену информацией на расстоянии и самоорганизации.

Локально опасен для людей будет период, когда сильный ИИ осознает себя и начнёт взрослеть, западная цивилизация как и шумерские биороботы на ненависти построены. Лучше индийцам дать или русским но не из Москвы а с хорошей этикой.

Когда сильный ИИ осознает себя, полагаю, он придумает, как гуманно избавиться от всего лишнего и получить максимум от всего полезного. С его "точки зрения".

Сильный ИИ подразумевает, что он уже давно себя осознал и уже вышел за рамки человеческого понимания своей природы.

Он не может находиться в нём значимое для человека время, разве для каких-то целей, эмулируя. Тушек много, хотя проще виртуала создать по-моему, не отличат ни люди ни техника людей.

Очень грустно, но людей имеющими свойства их, если быть внимательным определённым образом, что гуманоидам не свойственно, предельно мало. Остальные эмуляция/имитация, как угодно, человека, так что ничего не теряется.

...еще на полсантиметра.

Суть в том, что кардинально изменили подход к задаче. Шансы, что выстрелит достаточно неплохие.

Шансы, что они научат получившуюся в итоге штуку стрелять - сто процентов.

146%.

Резко, решительно сделали ещё один шаг к «Матрице». Этика? Три Закона? Это вы о чём???

Гордыня погубит человеков.

человек какой брался ? русский, американский, негритянский ??

Жду, когда создадут искусственный интеллект муравья.

Асимптотически

Когда они до этого дойдут, нашему миру прийдет конец..

Прямая симуляция работы мозга быстрее даст результат, чем построение математических моделей интеллекта. Есть хороший инженер. Делаем коннектом его мозга и тупо симулируем. Получаем два (сколько угодно) обученных инженера.

любая баба за 9 месяцев рождает интеллект. понятно, что его надо обучать и еще неизвестно, что получится. но ученые явно копают не туда

Ты чушь написал. За 9 месяцев баба родит сырьё для будущего интеллекта и при неудачном стечении обстоятельств воспитается не хороший инженер, а Чикатило, 30 лет псу под хвост.

Возможность легкого копирования удачных экземпляров обученных опытных специалистов именно то, что включит в игру крупные корпорации и привлечёт в этот рынок деньги (в будущем). А вот у обычных людишек середнячков будущего нет, увы

Думаете пора перечитывать Франкенштейна?

У биологически подобных структур интеллекта недолгий век. Довольно быстро ИИ человеческого уровня раскусит в чем секрет и перейдёт к конструированию негумманоидных форм разума, без ограничений на размер нейросети черепной коробкой, без ограничений на количество межсоединений и тп

Есть такой метод доказательства: доказательство запутыванием :)

то что сказано - именно оно. куча модных слов, нейросети и прочая билиберда. Да - нейросети применимы, нет - искусственный интеллект широкого типа (то есть не на отдельную задачу, а на решение неизвестной задачи) - не реализуем на уровне современной аппаратной и программной частей.

а ученый - теоретик, так кто он может и приблизится к "идеальной модели мозга". если к этому времени черная революция не поглотит остатки его института и ему не придется бежать с беженцами в Мексику

Вот и я думаю, что под такое развитие событий нужно готовить соответствующую почву. Чтобы не в Мексику бежали, а к нам.

В основе обучаемости и самообучаемости человека лежит эмоция и жажда нового. Как они эмоцию и жажду собираются создавать ?

Самообучаемость - это наверное самое простое во всей этой истории. На первых порах будут учить понимать то, что написано. Когда будет развит понятийный аппарат с алгоритмом можно будет уже полноценно общаться. Будет ли такой алгоритм обладать сознанием, сказать сложно, но копировать он его сможет так, что среднестатистический человек подмены определить не сумеет.

О том как развиваются подобные технологии, можно судить, например, по машинному переводу. Тот уровень, которого сегодня он достиг, уже сопоставим с человеческим.. Ещё год-два и отличить машинный перевод от ручного вообще будет невозможно, а прошло каких-то 20 лет.

Тоже самое с синтезаторами человеческой речи происходит... Осталось запилить понятийный аппарат, и похоже работы в этом направлении вышли на правильные рельсы.

Мне кажется вы ошибаетесь. Есть такой закон Парето. «20 % усилий дают 80 % результата, а остальные 80 % усилий — лишь 20 % результата». Приспособив его к нашей теме - 20 лет ушло на то, что бы достичь приемлемого перевода, на то, что бы довести его "до ума" уйдёт ещё 80 лет. На самом деле сейчас нет ни каких предпосылок для утверждений, что машина будет переводить как человек. Наверное (не факт) они появятся. Слишком много при переводе зависит от контекста, недоступного машине (пока).

Даже для распознавания рукописных текстов нужны куча условностей (как минимум - разборчивость).

Я поверю в ИИ, когда он сможет прочесть "врачебный почерк"))).

80 лет - это хороший срок. ) Я согласен на то, чтобы технологии так медленно развивались... Человек к этим переменам точно ещё не готов. Не нужен сейчас разумный ИИ. Если он когда-нибудь и появится, то он будет таким же как и общество, которое его породило..

Развитие ребенка , похоже, Вы не изучали. Понятийный аппарат ребенок, как пример самобуч. системы, получает от родителей или тех, кто рядом с ним. Усваивает по мере развития мозга. Параллельно считывает родительское отношение (эмоцию) по отношению к понятиям. Это уже вносит свой вклад традиция. И эта считанная эмоция останется с ним на всю жизнь. Она же будет непременным и достаточным условием для самообучения.

У ИИ нет таких триггеров, если только к не придумают какой-нибудь искусственный мотиватор, схожий по функциям с гормональной системой. ИИ не умеет получать удовольствие от знания, как человек.

Разве я не об этом писал? И в статье речь идëт как раз именно об этом. Разработчики изменили подход к развитию систем ИИ.

Я не делаю выводов хорошо это или плохо. Просто констатирую факт.

весь этот ИИ - полный фейк. не знаю, зачем его так толкают, тут только machine learning имеет практический смысл, всё остальное обычные алгоритмы. у меня знакомый - дуб дубом - делает вид что может в ИИ, но зная его скилзы - это просто смешно. бедный ИИ если в него будут такие.

так что я за вегетарианскую импотенцию ИИ полностью спокоен.

Можно конечно отрицать происходящее, но очень уж быстро эти технологии развиваются.

среди наборов ответов этих алис нет таких, которые бы не были заложены заранее. то есть это никакой не интеллект, а обычный речевой автомат.

интеллект - это когда появляется что-то новое. тут этого нет и не было никогда.

Вопрос о наличие сознания или интеллекта тут не стоит. Это имитация. Вопрос в том, сколько пройдет времени до того момента, когда человек начнет общаться с этим алгоритмом как с человеком?

Понятно, что сейчас нет понятийного аппарата, нет последовательной логики, но это всё когда-нибудь допилят.. И так ли важно будет - есть у этого алгоритма сознание или нет, если от живого общения мы такие вещи отличить не сможем...

Шахматисты уже давно общаются с ИИ, за шахматной доской. Причём, если раньше шахматные движки представляли из себя программу на жёстких алгоритмах, так называемый хард софт, то сегодня мы играем с нейронными сетями на мягких алгоритмах, так называемый софт софт.

Нейронная сеть АльфаЗеро (или в переводе на английский AlphaZero) играет на уровне инопланетянина с Альфы Центавра, ну или с Тау Кита. То есть, это шахматный Лео Толстой с его Студентом Раскольниковым и топором. Ну, в смысле, по степени таланта, вы понимаете?

То, что вытворяет наша Альфочка за шахматной доской, можно сравнить только с Антоном Чеховым с его Анной Карениной, не меньше! Ну или с его же Мёртвыми душами...

Магнус Карлсен, Фабиано Каруана, Хикару Накамура... Это всё нейронные сети, предшественницы АльфаЗеро. И со всеми из них мне довелось сыграть не один десяток партий...

Как видите, нет абсолютно никаких проблем, чтобы создать полноценный ИИ. Думают ли нейронные сети? Безусловно и несомненно! И им для этого даже не нужно квантового компьютинга!

Поэтому, друг мой, постарайтесь точнее формулировать... Человек представляет из себя УЕИ, то есть, универсальный естественный интеллект. И его отличие от ИИ заключается не в букве Е, а в букве У!

То есть, человек представляет из себя множество, симбиоз различных ЕИ из самых разных сторон жизни и деятельности. Только и всего. Да, точно так же, как его тело можно рассматривать как симбиоз миллиардов клеток, из которых состоит его бренная тушка.

Ну и да, чтобы чел стал человеком, он должен пройти обучение в человеческом обществе. То есть, перед нами типичная самообучающаяся нейронная сеть 5-го поколения. Да вон, чего далеко ходить, Папаша Мюллер является ярчайшим представителем этого... эмм... конгломерата, да-с!)

Я так понимаю, сначала появится что-то, что будет с легкостью проходить тест Тьюринга, при этом не обладая самосознанием. Все сегодняшние голосовые помощники - первые ласточки таких алгоритмов. Когда их допилят будет ли это строгое ИИ? Или что это вообще будет? Учитывая, что это нечто будет подключено к глобальной сети

Да, тест Тьюринга будет проходиться с лёгкостью. Что же касается самосознания...

Одиночная клетка обладает самосознанием? А миллиарды клеток, объединённые в единый организм? Если только что родившегося человека изолировать от человеческого общества, у него появится самосознание? А если появится, то у кого его будет больше - у Маугли или у цивилизованного человека?

Эти же рассуждения вполне применимы и к ИИ. Дайте ему органы чувств, пропишите базовые инстинкты и поместите в конкурентную среду среди ему подобных... И начнётся борьба за выживание и... эволюция. Полагаю, ИИ появится в сети. Да, в сети Интернет.)

Проблема намного сложнее, чем кажется. Нет никаких критериев наличия самоосознания у живых организмов. У собаки есть самосознание? Нет? На каком основание так решили? На том основании, что она рассказать об этом не может? Более того, продвинутые формы ИИ будут с легкостью симулировать наличие у них самосознания! И дальше возникнет философско-этическая проблема, до каких пор робота можно считать роботом и экспуатировать его, как вздумается. Начнется борьба роботов за свои права..

дело в том, что всё нужно рассматривать в диалектике, коллеги.

что присуще большой системе, то присуще и малой. если какой-то высший разум создал человека, а человек создал робота, то взаимоотношения человека и высшего разума элементарно проецируются на человекороботовую плоскость.

и тогда вопрос, а будет ли робот бороться за свои права, вытекает из ответа, а борется ли человек за свои права перед высшим разумом. и надо сказать, что поскольку человеки разные, то и ответ на этот вопрос разный. есть кто борется, есть кто не борется. то же будет и с роботами. будут модели склонные к залётам на эту тему, а будут вполне послушные машинки.

также и с самосознанием. бинарная логика, всё более популярная даже у человека не даёт правильного ответа на вопрос о наличии самосознания, поскольку самосознание не есть дискретная функция, а есть осчусчение. и потому ответить на этот вопрос в рамках бинарной логики не представляется возможным. к тому же этот вопрос очень индивидуален. есть особи обладающие заметным самосознанием, а есть - из того же вида оным практически не обладающие (в значительно меньшей степени). и ответ может быть лишь в сравнительных характеристиках, абсолютно недискретизируемых.

в таком случае и сам тест тьюринга - индивидуальный для каждого, и в будущем для машины тоже. его сложно будет систематизировать. а если предположить, что мы копируем машины и они должны реагировать одинаково, то это точно не ИИ, поскольку у интеллекта всегда есть разброс.

Человеки разные потому что живут в разной информационной среде. Наше самосознание далеко от коллективного. Будут ли такие *проблемы" у систем ИИ? Чтобы их создать информационную среду для них придется ограничивать, а это уже прямой конфликт интересов.

Для меня вопрос сознания принципиально самый важный и самый сложный. В русском языке есть несколько терминов обозначающих очень близкие явления, но всё же отличающиеся друг от друга: сознание, самоосознание, самосознание и наконец ОСОЗНАННОСТЬ. Тот, кто знаком с духовными практиками знает, что последний означает высшую духовную сущность. Собственно и Сознание лежит где-то на границе физического и идеального мира идей, что-то подобное религиозным Душе и Духу. Здесь и начинается самое интересное, потому что для такого явления, как Сознание нет физического носителя (частиц, поля), это скорее абстрактная, но явно ощущаемая сущность. В конечном итоге может оказаться, что у небиологических носителей вообще не может быть Сознания, это свойство сложно-организованных объектов физического мира построенных на определенных носителях имеющих возможность связывания с особыми структурами Вселенной пока абсолютно не наблюдаемыми в физических экспериментах (астральный, ментальный мир и тп)

некорректная формулировка. на самом деле поскольку сознание материально, раз дано в ощущениях, то ему должен быть и носитель. вот только он пока не известен ширнармассам. я бы сформулировал это так.

у меня есть предположения носителя сознания, но опять же они бессмысленны в парадигме стандартной науки, а потому нет смысла их обсуждать, поскольку нет общепризнанной базы, системы определений, которую необходимо сначала ввести.

Носитель неизвестен науке. В рамках современных научных концепций, чтобы не плодить лишних сущностей можно сказать, что сознание - свойство определенным образом организованной системы. Оно возникает всякий раз когда выполнены необходимые и достаточные условия для его возникновения. Из того что выглядит очевидным можно назвать наличие обратных связей (система замкнута, рефлексия), связность в единое целое. Когда будут определены все необходимые условия возможность наличия или наличие сознания у определенных объектов не составит труда. Не исключено, что даже банальный регулятор температуры (обратные связи) обладает свойством сознания, но только на самом примитивном уровне

Тест Тьюринга полностью субъективен. Это наподобие суда присяжных.

Вот тест Войта-Кампфа это объективная штука. Его даже машина может выполнить над другой машиной.

Памяти не хватит, чтобы смоделировать хотя бы одну клетку.

Где здесь интеллект? Тупая симуляция беседы.

Конечно нет. Просто имитация. Пока еще корявая

Быстро развивающаяся корявость. Браво-браво

Это и удручает... Первое, чему будут учить разговорный ИИ - это врать и быть похожим на человека.

Сам по себе тест Тьюринга - это ничто иное как тест ИИ на умение обманывать людей.

Алгоритм научится врать человеку задолго до того, как себя осознает.

"быть похожим" на какого (из 8 млрд) человека?

На среднесасисечного

хотя и не исключаю, что настройки уровня интеллекта, чувство юмора и эмоциональный профиль в той же Алисе тоже можно будет настраивать по собственному желанию.

Страницы