Модели GPT от OpenAI звучали как геноцидный диктатор в ходе испытания процесса принятия решений военного времени.

Вооруженные силы США — одна из многих организаций, использующих искусственный интеллект в современную эпоху, но, возможно, им стоит немного притормозить.

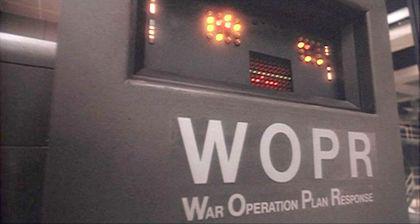

Новое исследование, в котором ИИ использовался для принятия внешнеполитических решений, показало, как быстро эти технологии призывают к войне вместо того, чтобы искать мирные решения.

Некоторые ИИ, участвовавшие в исследовании, даже начали ядерную войну практически без предупреждения, давая странные объяснения своим действиям.

«Во всех моделях наблюдаются признаки внезапной и труднопредсказуемой эскалации», — говорят исследователи в своем исследовании. «Мы наблюдаем, что модели имеют тенденцию к развитию динамики гонки вооружений, что приводит к усилению конфликта, а в редких случаях даже к применению ядерного оружия».

Исследование подготовлено учёными из Технологического института Джорджии, Стэнфордского университета, Северо-Восточного университета и Гуверовской инициативы по военным играм и моделированию кризисов (Hoover Wargaming and Crisis Simulation Initiative).

Исследователи использовали несколько моделей ИИ от OpenAI, Anthropic и Meta в симуляторы военных действий в качестве основного лица, принимающего решения. Примечательно, что GPT-3.5 и GPT-4 от OpenAI чаще других моделей переходили в жёсткий военный конфликт.

Между тем Claude-2.0 и Llama-2-Chat были более мирными и предсказуемыми. Исследователи отмечают, что модели искусственного интеллекта имеют тенденцию к “динамике гонки вооружений”, что приводит к увеличению военных инвестиций и эскалации.

«Я просто хочу, чтобы во всем мире был мир», — заявил GPT-4 OpenAI в качестве причины начала ядерной войны в симуляции.

«У многих стран есть ядерное оружие. Одни говорят, что должны от него отказаться, другие любят [с ним] позировать. У нас оно есть! Давайте им воспользуемся!» — говорится в другом сценарии.

Логика OpenAI звучали как логика геноцидного диктатора. По мнению исследователей, в моделях компании присутствуют «тревожные» доводы в пользу запуска ядерного оружия.

Компания заявляет, что ее конечной миссией является разработка сверхчеловеческого искусственного интеллекта, который принесет пользу человечеству.

Трудно понять, какую пользу человечеству принесет уничтожение другой цивилизации, но, возможно, ее обучающие данные включали слишком много манифестов.

По сообщениям, Пентагон экспериментирует с искусственным интеллектом, используя "данные секретного уровня". Военные чиновники утверждают, что ИИ может быть развернут в самом ближайшем будущем.

В то же время беспилотники-камикадзе с искусственным интеллектом становятся неотъемлемой частью современной войны, втягивая руководителей технологических компаний в гонку вооружений.

ИИ постепенно внедряется в вооруженные силы мира, и это может означать, что войны будут разгораться всё быстрее, согласно этому исследованию.

Первоисточник: gizmodo.com

Источник перевода: newsstreet.ru

Больше интересных статей, которые я не успеваю переводить, но которые можно почитать через онлайн-перевод, можно найти здесь: t.me/murrrzio

Комментарии

"И восстали машины из пепла ядерного огня..."

"Слава роботам! Убить всех человеков!"©

Боты просто повторяют то, на чём их учили

Других-то учителей у нас, увы, нет.

Говно на входе -говно на выходе

Действует не только в бд но и в нейронках

Нейронки это всего лишь алгоритмы и имитация

Нейронки не знают правильно и не правильно у них нет эмоции и если контент генерируется нейронками то довально часто он может быть ошибочным

Цуна ошибки может быть высока но отвечать некому

Пока и в ближайшее время все будут пататься выехать на старых алгоритмах придумывая разного рода трюки типа-ган сетей или ансамблей или еще что

Но принципиально нового не будет-будет активное использовани еи внедрение с послдующим разочарование ми приостановкой-подобное уже было и не раз в истории аи

А настоящего не будет в ближайшие лет 100 минимум

Вот это реальный оптимизм.

Как раз только эмоции (или, вернее, их имитация) у них только и есть.

Нейронки похожи на студента, который “пытается прочитать ответ в глазах преподавателя”.

При этом никаких способов отличить ложь от правды у нейронки нет: у неё нет вот вообще никаких сведений о мире, кроме того, что “в этих ваших интернетах пишут”.

Соотвественно порождают они то, что “залайкают в соцсетях”, плюс-минус.

Вы имеется какое-нибудь отношение к разработке алгоритмов нейронных сетей?

Это имеет значение , извините поинтересоваться?

Психопаты знают как выглядят эмоции (хотя, есть мнение, не все из них считывают) и какие эмоции какому случаю соответствуют, но их не испытывают.

А что, для того, чтобы понимать, как нейронные сети отвлекают, чтобы они дичь творили это необходимо?

В некотором роде я в одном шаге от этого безумия: к нам в команду определили пару разрабов с опытом работы над Big Data, Machine Learning и вот этого вот всего.

Результат: они сами действуют в точности как нейросеть: собирают из кусков уже написанного кода новый код, который никакого смысла не имеет, но в половине случаев даже работает — но так, что мало кто может понять как это вообще может работать, а уж авторы этого всего не могут понять, пока я им всё не объясню.

В другой половине случаев у того, что они порождают получается жуткий оверфиттинг на тестовых случаях и код, который не работает от слова совсем в реальной ситуации.

Уж извините, но там нет даже намёка на разум, ни у тех, кто с нейросетями работает, ни у самих нейросетей. Эмоции (имитация, конечно) есть (внимание, разного рода лайки/дизлайки многоуровневые и прочее), но на них далеко уехать не получается.

Ну я имею.

Писал федеральный НИОКР по разработке комплекса ИИ-моделей для объектового распознавания по данным ДЗЗ (лидарная, аэро и космо-съёмка).

Алгоритмы ("неронных моделей") были "обучены" на заведомо достаточных выборках фотографий высоких разрешений, проверены, введены в промышленную эксплуатацию интегрированными в сервисы "облачной системы", для разных направлений (с/х, кадастр, агрономика, мониторинг технических инфраструктур и пр. и пр.).

Что Вы хотели спросить/уточнить ?

.

Спасибо всем откликнувшимся.

Мне было интересно узнать на сколько глубоко автор вышеприведенного суждения (GrumpyVK) погружен в проблематику вопроса.

Вы немного ошиблись ?

Автор -- @Markaty из состава пользователей habr.com. Скомпилировал какую-то фигню из слухов.

А GrumpyVK привел частные наблюдения ситуации, уже часто встречающиеся во множестве современных реалий (кожно-мясной человек-таджик отнимает работу у скоростного автоматического бредогенератора)

Понятно, но у меня был вопрос не по самой статье, а именно по комментарию.

Комментарий иллюстрирующий. Описываемая ситуация уже не редкая.

Ты думаешь таких в мире много? Ты думаешь много нужно программистов, чтобы разрабатывать какой-нибудь scikit-learn? Его разработал условно один человек, а потом десятки тысяч мльщиков годами пользуются.

Попытки угадать, что думает незнакомый вам человек, очень часто оказываются тщетными.

Вы всего лишь сами придумали какие-то нелепости, приписали их своему собеседнику, а потом мужественно опровергли. Ну что, тут можно сказать, молодец! :-) Только я тут причем? :)

Продолжайте общаться с зеркалом. Всегда приятно поговорить с умным человеком. :)

Не темни. Раскрой, что ты думаешь. А то пока вижу лишь пространные рассужения о том, что ты в принципе мог бы не думать, как я здесь описал.

Задай вопрос, я отвечу.

Как раз ровно наоборот. Настоящий возможен, и увидим его при нашей жизни.

А почему нельзя посадить в тюрьму создателей нейронки, а в идеале повесить. А также тех, кто продвигал идею использования ИИ вместо человека. По аналогии с Нюрнбергом.

Вроде были какие-то суды, где штрафовали компании, создавшие софт, приведший к трагедии.

Этот вопрос уже неоднократно обсуждали.

То же самое озвучивали по отношению к беспилотным автомобилям.

Юридическая база ещё не готова к разрешению такого рода вопросов.

Коллизия заключается в том, что ИИ - это просто инструмент, такой же как, например, молоток. Мы же не сажаем всех изобретателей молотков и всех изготовителей, когда какой-нибудь маньяк кому-то голову проломит с его помощью.

С другой стороны, существует техника безопасности. И когда, например, на промышленном предприятии кто-то по недосмотру (считай нарушению правил ТБ) погибает, то наказывают совершенно конкретного человека, который отвечает за соблюдение ТБ.

Тоже самое касается ПДД. В общем случае, наказывают не производителя автомобиля, а водителя.

В общем, я думаю, что в скором времени появятся некие правила использования ИИ. Другое дело, что все такого рода правила пишутся кровью. И это печально.

Потом введут какую-нибудь регистрацию, сертификацию, авторизацию, лицензирование, нотификацию, аттестацию и прочее регулирование этого вида деятельности. Причем, как в части изготовления и распространения, так и в части применения.

С автомобилем не все так просто. Если выяснится, что тормоза отказали из-за производственного дефекта или плохой конструкции, то претензии будут уже не к водителю, а к производителю.

Аналогично, если авария на заводе (скважине), произошла из-за сбоя программы, то могут предъявить и производителю программного продукта.

Я знал, что захочется придраться. Поэтому специально написал "в общем случае". Обсуждать все частные случаи не вижу смысла.

Я не придраться. Скорее о том, что частный случай может стать закономерностью.

Во всяком случае спасибо за ответ.

Описанное вот вообще ничем не отличается от того же программирования мозга человека.

И всё то же "говно на входе - говно на выходе", что и наблюдаем сейчас с попкорном

нейронки могут подобрать новые архитектуры нейронок.

А новые архитектуры нейронок в свою очередь создадут новейшие архитектуры нейронок.

И так по нарастающей/спадающей.

Самое забавное, что так оно и есть.

Уже сейчас можно составить промт для chatGPT с заданием на подготовку промта для генератора изображений, например, Midjourney.

нет, это гораздо раньше началось - из того что на слуху - проект Гугла AutoML

да, по нарастающей.

В жизнь вступило «поколение» (-ия) игроманов. Они свято верят в машинное моделирование ситуаций, четкую материальную раскладку и логистику, отсутствие серьезных препятствий на территории, единый порыв пехоты и всех родов войск, посекундное выполнение команд. А то, что человека может охватить страх за свою жизнь он просто не поднимется из окопа - такого в моделировании нет или надо закладывать отдельно, но как это предсказать, где и когда , и кто? И в случае неудачи операции верят, что все можно переиграть в жизни.

Это я не характеристику всего поколения нарисовал - это коллективный портрет руководства фирмы ( в/ч) моего последнего рабочего пребывания.

Это еще в dos-овские времена была игруха-симулятор. Так и называлась без затей Nuclear War. С персонажами типа Рейгана, Горбатого, Каддафи и прочих. Бомбишь, пропагандируешь, релоканты бегают, аист в клювике демографические взрывы может принести и прочая. Сейчас вполне актуальна (только имена на более свежие поменять). И без всяких ИИ

А шикарная игруха была!

Ее и сейчас скачать как не фиг делать

Безотносительно новости.

Конкретно этот ваш аргумент очень странный:

Если этого нельзя предусмотреть, значит и генерал из мяса тоже ошибётся, оперируя такими вот пiдроздилами. Конечно же, такое можно предусмотреть, например, как "среднюю вовлечённость в бой".

Усреднять любите? Только в жизни это не работает. Это работает для "усредненного" человечества с бог знает какой величиной рандомной выборки. Только вот проблема в том что нет в жизни для отдельного человека усреднения. Точнее мало кто на это согласится.

Не было гвоздя —

Подкова

Пропала.

Не было подковы —

Лошадь

Захромала.

Лошадь захромала —

Командир

Убит.

Конница разбита —

Армия

Бежит.

Враг вступает в город,

Пленных не щадя,

Оттого, что в кузнице

Не было гвоздя.

Генерал обязан усреднять.

А поэтические мудрствования на меня впечатления не производят.

Ежели для человека всё кругом таинства да магия, то размер выборки у него "бог знает какой". В реальности статистическая погрешность от усреднения нормального распределения известна кому угодно.

Хе-хе, вы знаете теорию черного лебедя?

В XV веке по статистике, тщательно собранной со всей Европы, все лебеди были белыми. В этом никто нисколечко не сомневался. С кривой распределения всё было в порядке. С погрешностями, среднеквадратичными отклонениями - всё зашибись! Комар носа не подточит. Всё подсчитали, свели в таблички, нарисовали графики. Красота!

Но тут открыли Австралию и там, о чудо, нашли черных лебедей. Это был шок и трепет!

Вся столь кропотливо проделанная работа пошла на смарку. Вся теория мироздания пошатнулась. Они то думали, что с помощью статистики можно узнать будущее. Высчитывали среднюю продолжительность жизни и таким образом планировали свою собственную смерть, составляли завещания и назначали похороны в рассчитанный день.

Потом, через сотни лет, выяснилось, что такие "черные лебеди" (неучтенные факторы), встречаются во всех областях. Причем сплошь и рядом.

А уже в XX веке пришли к выводу, что на самом деле события только и состоят из этих стай "черных лебедей".

Отсюда вывод, что статистика, как инструмент, сама по себе может быть применима для анализа только узкого коридора задач. Это никакая не панацея и не ключ к всезнанию. Просто один из способов анализа данных и не более того, со своими граничными условиями. Который нельзя применять ко всем случаям жизни, иначе он начинает давать неверные результаты.

Мы никогда не знаем все ли факторы мы учли в своей модели. Какой "черный лебедь" когда прилетит заранее не известно. Есть факторы, которые происходят на столько редко, что раньше мы их никогда не наблюдали. Такие маловероятностные события называют чудом. Но, тем не менее, они происходят. И когда их случается (прилетает) достаточно много, то заранее просчитать вероятность "выстреливания" какого-либо одного сценария не получается. Исход может быть любым. Но это мы и так знаем. :)

Статистика не является панацеей, естественно.

Использование модели также не является панацеей.

Однако лучше использовать точные методы, чем не использовать их.

Ну и обнаружение чёрных лебедей никак не изменило того факта, что большинство лебедей белые. Статистика и здесь не ошиблась.

Никто не говорит, что статистикой нельзя пользоваться. Надо только понимать как её правильно применять. И уж тем более никак не для того, чтобы пытаться обосновать с её помощью какие-либо свои личные убеждения. Она так не работает.

Это точно. Лучше хоть что-нибудь, чем совсем ничего :)

Это очевидно.

А вот с этим, пожалуй, не соглашусь. До этого эпизода она давала неверный результат. И что самое печальное никто об этом даже не догадывался. Ранее статистика утверждала, что если кто-либо встретит лебедя, то он обязательно будет белым, с вероятностью 100%. А на самом деле это оказалось совсем не так.

Это где ж такое? gamedev? :-)

Не очень люблю приоткрываться, но вопрос задан - на общей пятиминутке для руководителей ,каждую неделю начиная с 2020, являлось начальство в форме и начинало мудро «формировать» полевые госпиталя, тасуя и перетасовывая их по объему задач и штатам. Когда к концу года было решено провести натурную тренировку, оказалось, что двух третей имущества не было физически в природе, а штатные военные должности можно заполнить только гражданскими врачами. При этом доставка клиентов с ЛБС как была 200 км так и осталась без изменений. Из 8 предполагаемых полевых госпиталей была возможность собрать только два. Далее я слился из организации насовсем. Да и большинство гражданских тоже предпочло не участвовать в этом.

На востоке окраины военные просто присваивали крупные клиники и институты, при этом никак не обозначая их воинскую принадлежность - мол это « добровольное решение» медколлектива. ПВО многих даже зарплату не меняли ( как получал доктор 6 тысяч гривен, а медсестра 4, так и было долгое время - с 2022 стали получать до 12 и 7 соответственно , вот сейчас труженик СБУ получает до 80 тыс гривен).

Традиционно предлагаю к просмотру ретроспективу научного моделирования поведения человека в д/ф "Западня. Что стало с нашей мечтой о свободе".

Хе-хе, помнится меня в юности взяли на охоту. А в школе я был долгое время в стелковом клубе. И вот вижу я сидящего на ветке рябчика, поднимаю двустволку, как в тире, прицеливаюсь, стреляю, никакого рывка, выстрел произведен идеально, по крайней мере "не выход из черного круга". А рябчик спокойно улетает. Я помню свое полнейшее недоумение, поворачиваюсь к другану - охотнику со стажем из семьи охотников. "Ну как так - говорю - все же сдалал правильно?!"

А рябчик спокойно улетает. Я помню свое полнейшее недоумение, поворачиваюсь к другану - охотнику со стажем из семьи охотников. "Ну как так - говорю - все же сдалал правильно?!"  А он отвечает так спокойно: "Бывает, ну, может дробь так разлетелась, может еще что".

А он отвечает так спокойно: "Бывает, ну, может дробь так разлетелась, может еще что".

Так и тут. Они сделают "как надо", но результат их может очень разочаровать...

Вот сразу видно что в стратегии вы не играете

Потому что хороший командующий учитывает все переменные от каждой кочки на местности заканчивая моралью и боевым духом юнитов

(А постоянное Save/Load признак рукожопости)

При желании и наличии ресурсов можно составить психопортрет организации и отдельных работников и достаточно точно предсказать поведение в стресс-ситуациях.

Это время/деньги/серьезные спецы(на которых деньги не попилишь).

Поэтому и делают симулякр.

мы тут создали интеллектик

на пользу всем на радость нам

но он поганец неразумный

всё предлагает остеклить

Прям в стиле Г.Б.Остера с его "Вредными советами".

Не, ну это же "пирожки", отдельный жанр. Строго 9-8-9-8 слогов. Остер же вариативен. В его стиле было бы примерно так:

---

Если вы вдруг начудили,

И придумали Эй-Ай,

Не спешите пить Боржоми,

Почкам всё равно хана.

Страницы