История про слепых мудрецов и слона по-прежнему не теряет своей актуальности.

Несколько дней назад в комментариях слоном оказался «ЦОД». И, поскольку большинство на АШ в той или иной степени – мудрецы, они уж точно знают, что такое «ЦОД». Вот только каждый его щупал по-своему, со своей стороны. Есть предложение привести всё к общему знаменателю. В качестве основы предлагается взять действующий в нашей стране с 01.08.2020 ГОСТ Р 58811-2020 Центры обработки данных. Инженерная инфраструктура. Стадии создания.

Что же такое Центр Обработки Данных (ЦОД)?

ЦОД в традиционном представлении хипстеров и прочих спецов.

центр обработки данных; ЦОД: Специализированный объект, представляющий собой связанную систему ИТ-инфраструктуры и инженерной инфраструктуры, оборудование и части которых размещены в здании или помещении, подключенном к внешним сетям, как инженерным, так и телекоммуникационным.

Примечание - При необходимости здание ЦОД может иметь прилегающую территорию.(по ГОСТ Р 58811-2020)

Таким образом ЦОД – это некий набор строений, подключенных к разного рода сетям, в которых размещается инженерная инфраструктура и ИТ-инфраструктура.

Реальные инженерные элементы ЦОД

инженерная инфраструктура центра обработки данных: Комплекс систем и их оборудования, обеспечивающий бесперебойное функционирование систем и оборудования ИТ-инфраструктуры ЦОД.

Примечание - Состав инженерной инфраструктуры определяется требованиями к ее функционированию со стороны оборудования ИТ-инфраструктуры и требованиями к обеспечению безопасной работы всего ЦОД. Как правило, в состав инженерной инфраструктуры входят системы электроснабжения, поддержания климата, связи и управления, комплекс систем безопасности.(по ГОСТ Р 58811-2020)

Примечание.

Специально для великих икспердов-критиков всего и всея. Я сознательно упрощаю картину мира, дабы видна была именно суть темы. Ежели начать казуистически придираться – от моих последующих рассуждений камня на камне не останется. Ибо они «в корне неграмотные с точки зрения бла-бла-бла великих гуру облаков и другого бреда». Ну, таковым пионэрам предлагаю либо не читать сей опус, либо – читая – свою великонаучную критику излагать в своих собственных материалах. В общем – в путь…

Продолжим. Дальше можно толковать по-разному.

ЦОДы можно разделить на «корпоративные» (то есть те, которые организации используют для собственных нужд) и «коммерческие». Про корпоративные рассуждать можно много, но вот публичности в этой области ох как мало. Известны, например, монстрообразные ЦОДы у Сбербанка. Их еще в узких кругах именуют «мегацоды».

А вот в отношении коммерческих – прозрачности чуть поболее. Ибо будучи заточенными на зарабатывание денег путем предоставления неких услуг внешним клиентам, они вынуждены себя рекламировать, и, как следствие – раскрывать часть информации. Именно по этой причине у нас имеется возможность лицезреть некоторые рейтинги коммерческих ЦОД как минимум от двух конкурирующих в этой области структур (CNews и IKS-Media).

Зачем же нужен клиентам коммерческий ЦОД? В модном нынче «дискурсе» - чтобы предоставлять некие услуги. Коих, по-крупному, – всего три типа (на которых отдельные маркетологи умудряются сформировать толстенные прайс-листы путем накручивания разноцветных бантиков и прочих прибамбасов). В виду традиционно принятого у нас желания всё модное и технологичное именовать «не по-нашенски», первый (и пока - основной) тип услуг именуют «colocation», что в реальности означает просто аренду места под размещение собственного ИТ-оборудования заказчика. Место может быть как под стойку, так и внутри стойки. Но это уже детали. Второй тип – это когда ИТ-оборудование тоже принадлежит ЦОДу. Соответственно, заказчику достается либо аренда реального ИТ-оборудования, либо – виртуального. Именуют порой IaaS, что на буржуйской мове звучит Infrastructure as a Service. Ну и третий тип, когда ЦОДу же принадлежит еще и установленный на оборудовании софт, а заказчику дается право им пользоваться. Те самые «облачные услуги». То есть Cloud service. Ну, иногда еще Saas, читай Software as a Service.

Можно долго спорить о вреде и пользе того или иного варианта. Пока что практика показывает, что бОльшая часть площадей крупных коммерческих ЦОД работает на первый тип услуг.

Разные специалисты по-разному оценивают доли типов услуг, но большинство склоняется к тому, что доля услуг сложности выше аренды места составляет от 10 до 20%. Косвенным подтверждением является, например, то, что два крупнейших ЦОД (если не считать Ростелеком), а именно - IXcellerate и DataPro – «являются нейтральными ЦОДами (не оказывают сами облачных услуг, а предоставляют исключительно услуги colocation и смежные услуги)». (по информации iKS-Consulting – см. тут.

Запомним маленький вывод: в большинстве коммерческих ЦОД основой бизнеса являются услуги размещения оборудования заказчиков.

Как работает коммерческий ЦОД.

В первую очередь (с учетом того самого маленького вывода – см. выше) надо сделать так, чтобы размещенное оборудование нормально работало. То есть обеспечить электроснабжение, охлаждение, подключение к сетям передачи данных, ну и сохранность. Опять сознательно загрубляю, в жизни, конечно же, много нюансов.

В отношении охраны и доступа к сетям передачи данных – задачи вроде как простые и понятные (в первом случае – опыта чуть ли ни у половины страны, во втором – достаточно обратиться к провайдерам и дать им возможность протянуть кабель и поставить свое оконечное оборудование – остальное они как-нибудь сами). Конечно, есть некоторые правильные вещи по организации охраны. Даже технологии заумные можно накрутить (вплоть до сканеров сетчатки глаза и систем тотального видеонаблюдения с ИИ). К счастью, всё это не обязательно, ибо практически всё может быть решено организационными мероприятиями и нужным количеством сотрудников. Дальше – каждый ЦОД решает для себя сам как сделать лучше.

А вот вокруг электроснабжения и охлаждения, собственно, и вращаются все проблемы, связанные с ЦОД и их услугами. Обе системы являются наиболее критичными почти для любого ЦОД, хотя возможны и варианты. Ну, и, как всегда, поскольку «все равны, но некоторые – равнее», самой важной системой ЦОД всё же будем считать систему электроснабжения. Ибо не умеют компьютеры без электричества. Даже если оного не будет доли секунды.

Два ключевых вопроса в этой связи:

- Как построить надежную систему электроснабжения?

- Как обеспечить ее бесперебойное функционирование?

Важно понимать еще один момент: кто источник электроснабжения? Вариантов, по большому счету – всего три: территориальная сетевая компания, собственная генерация или комбинация этих вариантов. Надеяться исключительно на сетевую компанию можно только если удалось получить для ЦОД 1 категорию электроснабжения, а еще лучше – особую группу. Автору не известны ЦОД, имеющие 1 категорию (возможно – скрывают?). Поэтому ЦОДы ориентируются на третий вариант (второй – сложно и организационно, и технически, а часто – еще и дорого). То есть подключаются со 2 категорией и имеют собственную генерацию в качестве резерва.

Варианты построения системы электроснабжения ЦОД в этих условиях более-менее подробно описаны в сети: дублированные (или порой - многократно резервированные) источники и каналы распределения, надежность переключения с внешнего источника на собственную генерацию обеспечивается статическими или динамическими источниками бесперебойного питания (ИБП и ДИБП). В принципе, идейно – всё.

DRUPS компании LPI

Система охлаждения – крайне важная система, особенно в случае, если ЦОД размещен в компактном помещении, и используемое ИТ-оборудование генерит кучу тепла. В отличие от электроснабжения, даже нагруженный ЦОД может практически незаметно для себя пережить кратковременное отключение системы охлаждения. Ключевое слово – именно «кратковременно». Хотя бывают и исключения: ежели ИТ-оборудование разместить в бесконечном ангаре, расставить его поширше, а сам ангар поставить куда-то поближе к полюсу – система охлаждения может вообще не понадобиться. Такое тоже встречается, но мы всё же про более традиционные ситуации.

Два ключевых вопроса для систем охлаждения будут такими:

- Как построить надежную систему охлаждения?

- Как обеспечить ее функционирование, не допускающее заметных для ИТ-нагрузки простоев?

Источником холода в них являются собственные машины (порой – с помощью внешнего прохладного воздуха). Работают эти машины на электричестве, опускают температуру рабочего тела до определенного предела, далее по каналам распределения разносят прохладу по машинным залам. Для надежности – всё это резервируется (то есть создается избыточность по количеству и мощности).

Теперь небольшое отступление.

Сказка про ТИР (очень краткая промо-версия будущего материала).

В инете бродит мулька про классификацию ЦОД имени некой «международной компании Uptime Institute». Буков написано толкователями (именно толкователями, а не авторами!) много. Так много, что все уже почти в них и поверили. Как всегда, во всякой лжи есть доля правды.

Правда в том, что есть продвигаемый частной консалтинговой компанией в виде зарегистрированного бренда некоторый «уровень надежности ЦОДа», называемый Tier с цифровым индексом от I до IV. И чем больше номер – тем более надежный ЦОД. И что присвоить ЦОДу этот самый Tier имеет право только эта консалтинговая компания. За мзду, и часто – не такую уж и малую.

Почти всё остальное – не правда. Например, не правда то, что присвоенный даже этой компанией уровень Tier означает конкретное значение какого-угодно из коэффициентов надежности. Об этом неоднократно заявлял глава российского представительства этой самой компании – см. например тут.

Основная причина столь серьезного прокола проста: считать и обосновывать надежность трудно, да и отвечать потом за расчеты надо. А не хочется… Есть и вторая, не менее «приятная», причина. Дело в том, что по факту производители инженерного оборудования для ЦОД не готовы раскрыть реальную надежность своих изделий. А не имея данных по отдельным элементам – посчитать итоговое значение вообще невозможно.

Так что не верьте фразам типа «для ЦОДа Tier III коэффициент отказоустойчивости равен 99,98 %.» В ней прекрасно всё. Начиная с того, что в теории надежности не знают, что такое «коэффициент отказоустойчивости». И заканчивая тем, что Tier III про надежность в цифрах ничего не гарантирует. Так что вся фраза – ложь. Не ведитесь на нее.

Блуждающая в инете лживая картинка про надежность уровней Tier.

Когда-то, если хватит сил и настрой будет соответствующий, изложу более подробно эту сказку. Может даже с фамилиями, как знать? А пока - продолжим по-серьезному.

Итак, мы каким-то образом построили надежные системы. И далее надо заняться вторым вопросом: как обеспечить их функционирование в соответствии с требованиями? Отвечает за это так называемая

Служба эксплуатации ЦОД

служба эксплуатации центра обработки данных: Организация или ее подразделение, в обязанности которой вменяется проведение работ по эксплуатации систем и оборудования центра обработки данных.

(по ГОСТ Р 58811-2020)

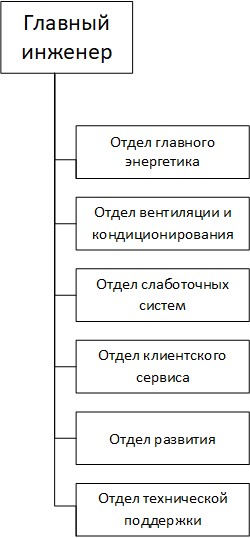

Но какой она должна быть и чем ей следует заниматься? Опять же, любая потенциальная помощь зала легко даст нам кучу различных советов. Ибо все это хорошо знают, и имеют собственное мнение. Но мы будем опираться на нечто более научное. Оказывается, есть такая (уже упоминавшаяся выше) «теория надежности». Которая однозначно говорит, что если уж кому-то надо, чтобы построенная реальная система нормально функционировала – ее следует нормально эксплуатировать, в том числе - своевременно обслуживать и ремонтировать. Всё просто, и будет вам счастье. Сия простая истина приводит к тому, что в типичном коммерческом ЦОДе (достаточно крупном) структура службы эксплуатации примерно такая:

Задачи первых трех отделов – своевременное обслуживание и ремонт оборудования систем в своей зоне ответственности. Текущий мониторинг (который включает в обязательном порядке и регулярный визуальный осмотр) – обязательная часть такого обслуживания. Есть еще регламентное ТО (обычно – по времени или по наработке). Ну и ремонты, плановые и аварийные.

Для электрических и механических систем всё это – трудоемкие процедуры, требующие останова и отключения оборудования, его частичной разборки и т.п. В виду наличия заложенных резервов, для потребителей это как правило проходит незаметно, без снижения параметров предоставляемых услуг. Но следует понимать, что проведение любых работ (как плановых, так и внеплановых) – однозначно приводит к снижению надежности объекта. Просто потому, что часть резервов выводится в обслуживание, и при отказе работающей системы – они не могут быть задействованы, ну – раз уж они отключены и разобраны (см. выше).

Отдел клиентского сервиса – это диспетчерская, принимающая запросы от потребителей и организующая их отработку. Реально с клиентским ИТ-оборудованием работает отдел технической поддержки.

Отдел развития – ведет учет задействованных мощностей и просчитывает варианты удовлетворения запросов существующих и новых клиентов на предоставление услуг и/или изменение уже предоставляемых услуг.

Сколько же народу надо для всего этого? В крупном коммерческом ЦОД до 20 чел. в отделе главного энергетика, до 10 – в отделе ВиК, 3-4 в отделе слаботочных систем, 6-8 чел. в отделе клиентского сервиса, 5-7 чел. в отделе развития, до 10 чел. в отделе техподдержки. Всего численность службы эксплуатации – до 60 чел. И это все – только по инженерным системам и услугам размещения оборудования!

Все приведенные цифры - абсолютно реальные. Из реальной штатки. А вот чья именно это штатка – не скажу. Не велено.

Про удаленку.

Могут ли перечисленные люди работать удаленно? Ну, разве что – диспетчеры. И только если они не делают ничего, кроме приема звонков и переадресации писем. В большинстве ЦОДов они еще видят состояние оборудования ЦОД, а это уже требует доступа к системам мониторинга и управления. Доступ удаленно конечно же организовать можно. Хлопотно и не дешево (если делать качественно и безопасно). То есть дать им (каждому!) по приличному компу домой плюс организовать защищенный VPN домой. А еще надо, чтобы дома они все правила безопасного пользования соблюдали…. В офисе таких проблем нет. А вот по всем остальным – удаленки не будет. От слова совсем. Ибо работа требует непосредственного контакта с железом. Как-то так.

Немного слайдов про коммерческие ЦОДы.

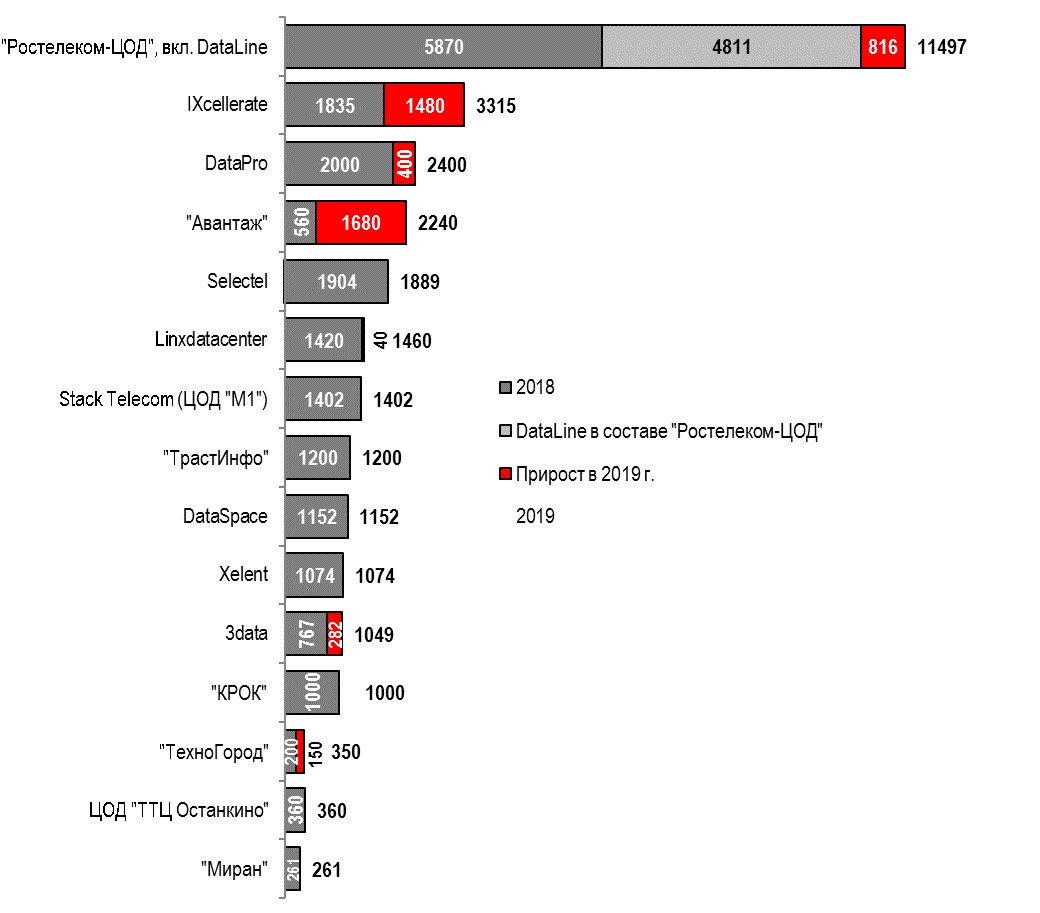

Как уже ранее упоминалось - как минимум две конкурирующие структуры (CNews и IKS-Media) публикуют рейтинги коммерческих ЦОД. Предлагаю их некоторое время поразглядывать.

Рейтинг ключевых участников рынка КЦОДов РФ в 2019 г. по количеству введенных стойко-мест Источник: iKS-Consulting

Крупнейшие поставщики услуг ЦОД в России 2020

Поскольку данные ЦОДы предоставляют сами, по своему желанию, конечно же в рейтинг попадают не все. Что интересно – первые 12 в обоих случаях почти совпадают, хотя и видно, что у CNews информация посвежее.

Всего заявлено 12 крупных коммерческих ЦОД с размером более 1000 стойко-мест.

А если не считать Ростелеком и МТС (для которых ЦОДы – незначительное дополнение к основному бизнесу) – то только 10. Десять, Карл!

Общее число стойко-мест в крупных ЦОД – 30 606, общая площадь машинных залов – 78149 м2. Суммарная подведенная мощность – 317 МВт, мощность на одну стойку – от 5,5 до 15 кВт.

Много это или мало?

В сравнимом виде бесплатную статистику мне найти не удалось. Наверное - плохо искал. Буду благодарен, если кто подскажет где взять. Но хоть с чем-нибудь сравнить можно. Например – с самым большим в мире ЦОДом. Известно, что это - ЦОД TAHOE RENO 1, размещенный в кампусе Цитадель на севере штата Невада, США. Он имеет суммарную подведенную мощность более 650 МВт, площади под размещение ИТ-оборудования – более 650 тыс. м2. Делайте выводы.

Кстати, есть еще один важный факт из экономики услуг ЦОД.

Дело в том, что отечественные ЦОДы – лидеры по доле электроэнергии в структуре себестоимости. В среднем она составляет 50%, а в ряде случаев достигает и 60%. Думаю, речь идет именно о ЦОДах в нашем понимании. Ибо для ориентированных на облака цифры скорее всего будут несколько иными.

Не удивительно, что, сравнив стоимость электроэнергии в России и за бугром, а также увидев масштабы и количество ЦОДов по миру, власти задались логичным вопросом: почему этого добра у нас так мало? И тут же поставили задачу увеличивать долю экспорта в услугах ЦОД. Ни много, ни мало – именно так. И уже приняли ряд решений, скажем так – способствующих повышению этой самой доли. В том числе.

Главный редактор АШ часто ругается, когда видит материалы про выработку криптовалюты за счет дешевой электроэнергии. Он прав, люди действительно палят по сути - самое дорогое что у них есть и генерят виртуальный дорогостоящий мусор. Это так. Проблема, как мне видится, в том, что другого способа выгодно для себя продать эту самую энергию порой найти не удается. Вот и рыскают в поиске варианта завуалированной продажи. И услуги ЦОДов на экспорт – один из таких способов. На мой взгляд – не являющийся бесспорным, но в целом – может быть действенным. Косвенным подтверждением можно считать бурную активность в ЦОДостроительстве в последнее время проявляемую Росатомом. А энергии у нас пока много. Коэффициенты использования установленной мощности в 2019 году по ГЭС составил 43,85%, по АЭС - 79,82%. Это хорошая стабильная энергия, без ненужных трат углеводородов. И ее резервы можно и нужно с выгодой продавать. ИМХО.

Что же про облачные и прочие ЦОДы?

Есть огромное подозрение, что этих зверей несколько больше, чем может показаться на первый взгляд, да и покрупнее они. Только ведут себя несколько иначе, чем традиционные ЦОД, ориентированные на услуги размещения оборудования. И вот почему. Была тут недавно заметка про новый ЦОД в Норильске.

Так вот совокупная мощность уже запущенной фермы заявлена в 11,2 МВт. И далее ее вроде как планирую увеличить до 31 МВт. И это – только ИТ-нагрузка. Подведенная мощность обычно в два раза больше.

А еще есть, например, ЦОД Bitriver в Братске. Который заявляет 100 МВт подведенной мощности. А в рейтинге самый энерговооруженный – всего 20 МВт. Что тут сказать? Делайте выводы. Правда, выглядят эти ЦОДы несколько иначе…

Машинный зал ЦОДа Bitriver в Братске.

Как интересно тут с чистотой воздуха? С температурой? Где тут дефицит площадей? Вопросы можно продолжать. Но в целом – прикольно, ведь да? Особенно если сравнить с более привычной для глаза самой первой (после слона) картинкой из этого материала.

Понятно, что традиционного бизнес-заказчика в такой ЦОД не загонишь ничем. У этого ЦОДа – свои, специфичные клиенты.

Продолжение следует…

Комментарии

Первая картинка с трехметровым коридором между рядами взята из какого-то фантастического фильма.

В реальной жизни ряды в ЦОДе разнесены на две плитки пола. Иногда даже на одну

Три метра конечно перебор знатнейший но это вот как то совсем хреново. Тут если нужно будет стойку сменить убиться же можно будет нафиг.

Не беспокойся, это вид стоек со "спины". Если бы такое расстояние было между мордами, то монтировать оборудование даже глубиной 450 мм было бы невозможно. Я уж не говорю о серверах глубиной 600+.

коридор еще и для обслуживания, в том числе и вынимать-вставлять содержимое шкафа. А там сервера и коммутаторы длиной зачастую под метр, да еще и на рельсах, наклонить не получится. Ширины шкафов тоже по минимуму 600 мм, чем больше шкафов впихнули, тем больше заработал ЦОД.

Да и по максимуму - обычно тоже, ибо нет смысла их делать шире. Иногда бывают на 800мм. Это глубина шкафа бывает обычно 450мм, 600мм, 800мм и 1000мм. При этом в ЦОД-ы предпочитают ставить именно 1000мм - чтоб осталось нормально места под кабельные органайзеры.

Это рендер от какого-то художника.

"Серверное сияние". Не путать с северным.

Ну здрасьте, лично был в ЦОДах ФНС, есть и по три и по четыре. Пол навесной, под ним можно ходить, пригнувшись, так как там все провода расположены. И открытая панель не должна препятствовать движению вдоль стоек противоположного ряда

Сколько зарабатывают ЦОДы?

Видим что оборудование сложное, должна быть и прибыль.

Из того списка многие не зарабатывают, а тратят. Возможно, это временно.

"Прибыль" в экономике кредита и ссудного процента давно отсутствует, это всего лишь переливание Долга

Вот это-го хипстеры - никогда не поймут. С их точки зрения это примитивные системы, которые работают сами и не нуждаются в ежедневном обслуживании, типа "я в свой электрощиток - годами не заглядываю, а свой комп - настраиваю каждый день". С их точки зрения - проблем с этим нет и быть не может и все тут!

И как им объяснить что они - в корне неправы, я не знаю. Вы - попробовали (респект вам за это), но боюсь скоро набегут всякие "Системники" и начнут рассказывать вам какой вы лох...

За оценку спасибо.

Касательно "лох- не лох" - будем ждать. Придут - тогда и поговорим. :-)

Уже прибежал, выше...

Уровень осведомленности - проявил в первом же посте. Не сообразила хипстота что на фото - "задний" проход между рядами шкафов, со стороны которого - одни кабельные органайзеры и смонтированы.

\\Автору не известны ЦОД, имеющие 1 категорию

Я знаю несколько таких ЦОдов. Один из них находится в Удомле.

В табличке CNews намешаны приватные и публичные ЦОДы, зато, нету такого интересного, например, как Mail.ru...

Насчет Удомли позволю себе выразить определенный скепсис. Ибо запитан он напрямую от распределительных устройств на площадке у АЭС Калинин. Соответственно, говорить о "обеспечиваться электроэнергией от двух независимых взаимно резервирующих источников питания", как того требует категория 1 - сложно, хотя теоретически и возможно. Например, возгорание на этой площадке скорее всего приведет к обесточиванию питающих линий, даже если их будет и две. Именно поэтому там стоят куча друпсов. См, напр. тут.

Хотя - есть шанс что вы и правы.

Если по существу - мне было бы весьма интересно ознакомиться с теми аргументами, которые использовали владельцы или застройщики ЦОДа, чтобы убедить сетевую компанию, что им нужна категория 1. Если есть информация - поделитесь, буду благодарен.

//Хотя - есть шанс что вы и правы.

Если учесть, что на любой АЭС есть, как минимум, два независимых линейных комплекта и два комплекта собственных нужд, то это довольно вероятно.

Насколько мне известно, владельцы ЦОДа в Удомле не использовали сетевую компанию...

Кстати, что касается IXcellerate, Вы правы, там чистая колокация в продаже. Кроме того, к ним уже зашли несколько ведущих магистральных операторов, так что, и с коннективитью у них всё хорошо.

За Selectel и их процент облачных услуг с разбегу не скажу, попробую их завтра поспрошать, если, конечно, это не закрытая информация.

Тут вы похоже "колхозных баранов с личными путаете". АЭС - это АЭС. А ЦОД - это ЦОД. Это две разные организации. Территориально разнесены на несколько сотен метров. И - внимание! - использовать для каких угодно иных целей что-то, предназначенное для собственных нужд АЭС - низзя ни под каким соусом. Ибо - тюрьма.

Возможно. Интересно как в этом случае они обеспечили требования ПУЭ: "электроприемники первой категории в нормальных режимах должны обеспечиваться электроэнергией от двух независимых взаимно резервирующих источников питания"? У них собственные ЛЭП? И куда они (эти ЛЭП) идут - не интересовались?

Не вижу смысла продолжать полемику. Я имею информацию из первых рук.

Вы же, либо не читали, что написано в вашем же журнале:

"Это, в частности, минимальные оптовые цены на электроэнергию – используется тариф, по которому она покупается станцией для собственных нужд, отсутствует сбытовая надбавка. Кроме того, минимизированы затраты на технологическое подключение, поскольку распределительные устройства и подстанции уже установлены."

,либо не понимаете, что эти слова означают.

Вот радуют меня такие "имеющие информацию из первых рук". Вы вот ее имеете. Но, похоже - в ЦОДе этом не были. Как и на КАЭС. В отличие от меня.

Использовать тариф - это не то же самое, что и подключиться к источникам энергии, предназначенным для поддержания работоспособности АЭС. Печально, что вы этого не понимаете. Поясняю: станция для собственной деятельности потребляет существенные объемы энергии. Эти объемы в нормальных условиях отбираются из производимой станцией энергии. Но на случай аварий используются внешние источники и дизеля. И лезть в эту цепь каким-то ЦОДам нельзя от слова совсем.

КАЭС является в некотором роде транзитной станцией. В том смысле, что рядом с ней находится целое поле распределительных устройств, которые получают энергию из разных источников (включая КАЭС) и перераспределяют ее в зависимости от потребностей в разные стороны. Именно к этим распределительным устройствам (а не прямо к КАЭС) и подключен ЦОД. Одним лучом - точно. А вот второй луч, по-идее, должен уходить в другую сторону, к совершенно другой распределительной подстанции. Это если обеспечивать 1 категорию. В противном случае распределительная подстанция рядом с КАЭС - это единая точка отказа, и 1 категория превращается в нечто иное. Я вот сейчас точно не помню - вроде там так и было сделано (доп.ЛЭП на восток). Но это уже явно будут чужие сети, а не ЦОДа. И тогда услугами сетевой компании пользоваться придется.

То, что пишите вы - это исключительно про тариф, а не про провода. Про бессмысленность полемики с учетом сказанного выше - наверное соглашусь.

Заказчиком проектирования ЦОД является КРЭА. Поставщиком электричества должна была быть КРЭА. Зачем кого-то в чем то убеждать? Реализовать 1 категорию в условиях АЭС очень просто. Достаточно осуществить подключение от разных секций шин подстанции. Ведь на территории КАЭС находятся четыре абсолютно независимых источника питания. А вот реализовано ли автоматическое восстановление питание на низкой стороне большой вопрос, который вызывает у меня сомнения. Так что несмотря на возможность 1 категории по факту скорее всего работает 2, которая фактически доводится до 1 за счет источников бесперебойного питания, которые включаются и выключаются автоматически. И за время работы которых работник может дойти и врубить/вырубить рубильник.

Вроде как у нас имеют место быть правила для торговли электроэнергией. И там не всё так уж однозначно. Я про "должна".

Помимо независимых источников должны быть независимые каналы распределения. Для исключения единой точки отказа. А это вроде как означает, что и подстанции должны быть разные. Ибо если какая неприятность - подстанция швах - потребителю тоже плохо будет.. Какая уж тут 1 категория? Я что-то путаю?

Источники питания (которых, кстати, существенную часть времени на АЭС - всё же 3, а не 4, ибо блоки надо обслуживать, и их на это время по очереди глушат), - да, вроде как технически независимые. Вот только территория - единая, персонал тоже. Техногенные аварии никто не отменял. Ежели что - все четыре хором и станут. И что тогда ЦОДу бедному делать?

С эти всё нормально. Там в каждом модуле есть по нескольку ДИБП. По идее, должны сколько-то часов держать нагрузку.

А че там такого, особо интересного? Не знаю, сколько у них площадок, но на одной из них-Варшавка125 бывать приходилось. Ничего особо выдающегося в сравнении с двумя другими по тому же адресу.

Само собой, делайте выводы хотя бы по категрии э/питания от одного для всех троих поставщика. Собственной генерации там нет ни у кого.

ЦОД в Удомле заявлен на 70 мВт, не уверен насчет 1-й категории.

Я уверен насчёт 1-й категории, т.к. плотно общался с людьми, которые его строили.

И это, дружище... 70 мВт - это 70 милливатт. Таки должно быть "МВт".

80МВт. Из них первая очередь 40МВт.

https://udomlya.rt-dc.ru/

Основная задача у ЦОДа - это не электропитание и бесперебойность, а чтоб маски-шоу не нашли где находятся сервера ооошеньки, ведущей тройную бухгалтерию:))

Мимо. Для таких унылых дел существует свой комп в подвале или Ажур.

свой комп в подвале зависит от наличи питания в подвале, наличия тырнета в подвале (обычно все скулят "какой у вас самый дешевый тариф,,,!" и прочей мути. И при этом все уверены, что 6 человек смогут удаленно с этим подвалом нормально работать. Ну да. ща. огурцов в телегу.

При стоимости в ДЦ за размещение юнитной тачки тыщи три в месяц - несут туда, с визгом и песнями.

Если тебе нужна чёрная бухгалтерия, то у тебя есть и прибыль, которую можно потратить на питание и подвал вообще. Если чёрная бухгалтерия у тебя есть, а прибыли нет, значит ты лох, и никакой ЦОД тебе не поможет.

Вот только нет решения, как это сделать если ты регулярно - раз в 3 месяца - переезжаешь:)))

Мне все эти теории не надо рассказывать, у меня в ДЦ в двух десятках стоек находятся именно такие "жители". Часто не имеющие офиса вообще. Соответственно и подвала.

Ставить его дома в квартире, по понятным причинам, не следует:)

Что я могу сказать... Горе им!

однозначно, нефиг крысятничать:)

Считаю, что маленький вывод не совсем верный. Прошел по предоставленной ссылке, там этого нет. Даже более того: ЦОД Selectel в последние несколько лет, наоборот, сфокусировался на предоставлении облачных услуг, доля которых в его выручке уже превышает 80%.

Ну да, размещение базы 1С в облаке - весьма востребовано. Собственный сервак иметь - это надо скилы админа 8 левела, а все хоЧут чтоб узбекский приходящий админ делал все под ключЬ за 5 тыщ.. :)

Во-во.

Спасибо за реплику. К сожалению, вы не совсем внимательны: по приведенной ссылке можно убедиться, что

Касательно вашего заявления насчет Selectel - не уверен, что вы правы. По крайней мере в 2018 году они говорили всего о 50%, и были лидером рынка. Что-то я не верю в такой скачок (с 50 до 80%) всего за год.

В целом, ежели немного покопаться в открытых источниках - можно увидеть цифры и в 55% по колокейшн. Мне встречались цифры "до 80%", но под рукой подходящей ссылки нет.

Кстати, а вы можете подтвердить свое мнение проверяемым источником? По Селектелу вроде как не очень получается, да и он не очень удачный пример, ибо изначально сильно на облака заточен был.

80% в то же ссылке.

В основном связан с корпоративными ЦОДами. Но знаю пару не особо крупных коммерческих - там чужое оборудование не видел. Сдают в аренду свое железо либо облачные сервисы.

А где "Служба безопасности" в штатном расписании?

Они обычно не подчиняются Главному инженеру, и не входят в Службу эксплуатации. Поэтому в примере их нет.

В реальности - варианты разные бывают. От собственной службы, до профессиональной охраны. Та же Удомля, например, пользуется охраной АЭС. Ежели не шутят ...

КИУМ практически всех существующих ГЭС поднять нельзя из-за гидрологии.

КИУМ АЭС поднять можно до 90-92% и Росатом старается тут больше сложностей технического характера, а не диспечерские ограничения.

Большой резерв мощности это ТЭС у них КИУМ в РФ около 50%.

Тут я не спец, поэтому спорить не могу.

Однако ситуация в Братске как бы заставляет задуматься. Там энергию девать вроде как некуда, и там только гидро...

Знали бы вы сколько у нас тут более мелких майнеров... а генерация ещё тепло есть

А энергию жрёт Братский алюминиевый (насколько я помню 3/4 всей выработки Братской ГЭС)

Плюс ещё не особо далеко строят Тайшетский алюминиевый, Усть-Кутский газоперерабатывающий, так что найдется куда энергию деть

Локально есть излишки с этим ни кто и не спорит, но это проценты, а не десятки процентов от общей выработки ГЭС или АЭС. В основном это "запертые" мощности и тут только локальный потребитель сможет помочь.

Классный ник)

Извините за оффтоп.

Я когда регился - проверял на дубль. Но без точки проверить не догадался. Так что просю просчения за невольный почти дубль... :-)

А так - оный герой мне по жизни близок.

Да.

"Я мистер Вульф, я решаю проблемы" (с) классика.

Я тоже решаю проблемы, только совсем в другой области.

Прочитал про 30 МВт Bitriver -- прям майнерский рай. Но есть нюанс -- ASIC или же аналоги видеокарт. Ибо асики заточены под конкретный алгоритп, а вычислительные модули наподобии видеокарт легко переориентируются на любую другую задачу.

Если бы всю эту мощь, да на настоящий ИИ на базе разработок от "когнитивные технологии" ^_^

По моим расчетам получится в режиме реального времени создать небольшой городок когнитивчиков.

Еще есть ARM, у которых эффективность на ватт выше обычных х86 процов.

Слушал выступления одного комерса. Говорит, что у него 70 МВт вычислительных мощностей. По его оценкам примерно половина - видеообработка. Китайские фирмы что-то там рисуют. Заявляет, что спрос - как минимум еще столько же. Как оказалось, проблема - каналы связи. Из Братска в Китай - через Европу и Америку. Надо бы напрямую протянуть - ещё больше бы было...

Но, опять таки - это "гаражный ЦОД". Хранить ничего не надо, только тупо считать. От майнинга недалеко ушли...

Там же рядом в 2014 году канал толстый кинули на Китай. А до 2014 да. Из Бангкока в Москву трафик шел через Японию-Штаты-Европу.

Страницы