... и под анализ попадают фото и видео из отпусков, посты о дорогих покупках и другие признаки уровня жизни, который не совпадает с официальными заработками?

Если мы зададим этот вопрос Алисе, то получим совершенно недостоверный ответ, который направлен на манипуляцию сознанием и управление эмоциями читателей.

Но давайте всё же разберёмся, почему так происходит, кто виноват и что делать.

Для начала будет уместно сказать следующее.

Разумеется, это не "epic fail", а органическое свойство любой LLM. Так, к сожалению, на современном этапе работает любая система поиска и обобщения информации в интернете с помощью ИИ. Это нужно чётко осознавать и точно не принимать всё сразу на веру.

Ответ основан на обработке страниц с сайта dzen.ru +4 и iznanka.news +1.

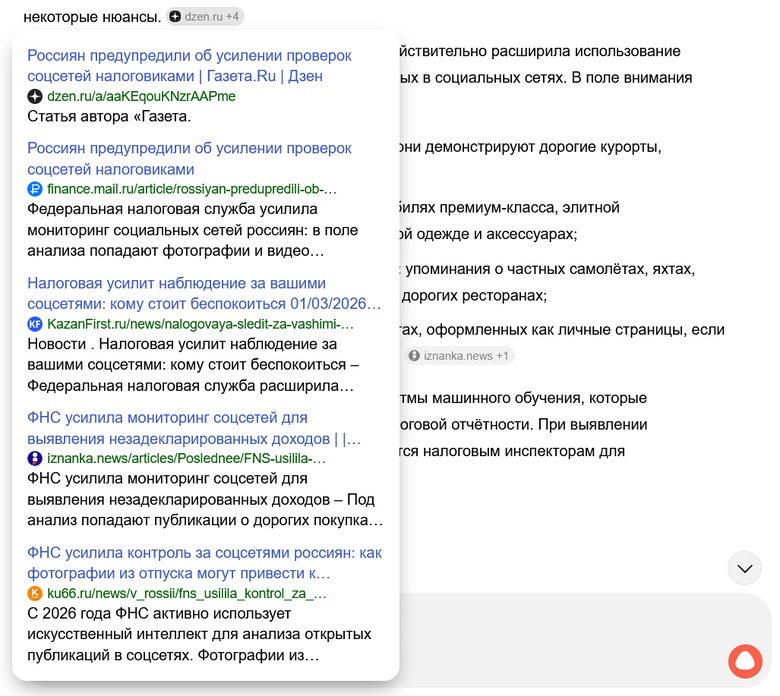

Раскроем список dzen.ru +4 и увидим эти источники.

• Но это ещё не всё

Наша задача — разобраться и понять, почему система так работает.

Поэтому в самом низу ответа кликнем на «источники», что, наверное, практически никто не делает, и получим список всех 11 источников, анализ которых привёл к такому ответу на вопрос.

Среди этих 11 источников есть замечательная статья на Хабре, в которой специалист со стажем работы в ФНС профессионально объясняет, почему это фейк и как работает служба на практике.

Если бы тот, кто задал подобный вопрос, получил обобщённый ответ нашей Алисы на основе данной статьи, то это было бы правильно и релевантно.

Но у нас счёт 10 к 1 не в пользу правильного источника, а наоборот. В итоге однотипные по смыслу фейки с разных второстепенных сайтов, растиражированные СМИ в большом количестве, просто как шум полностью забивают и размывают полезную информацию.

ИИ не может отделить «зёрна от плевел». У него нет критериев отбора или рейтинга достоверности источников, всё валится в кучу и обобщается.

Чтобы такого не происходило в профессиональных системах, например, юридических, медицинских или корпоративных, где ответы должны быть гарантированно точными, одним из достоверных источников является верифицированное хранилище документов.

Как говорится, чтобы этот «провал не очень проваливался».

Это реализуется в виде RAG, чтобы быстро находить нужную информацию в огромных базах данных и «подмешивать» её в контекст запроса перед ответом. Или Model Context Protocol (MCP), чтобы ИИ-агенты подключались к доверенным MCP-серверам для выполнения задания. Или классический API для доступа к базам данных.

Иногда специализированные модели проходят интенсивный файнтюнинг.

Но в данном случае есть только интернет и сам предобученный ИИ общего назначения.

В такой конфигурации мы в принципе не можем ручаться за достоверность полученной информации. Не потому, что Алиса (или Гугловский Gemini) тупые, а потому, что источники перенасыщены фейками. Это эффект отравления данных, которым пользуются манипуляторы и ловцы хайпа. Логическим путём обнаружить и отфильтровать такой поток мусора чрезвычайно сложно.

Наверное, в такой неоднозначной ситуации для ИИ было бы разумнее не давать однозначный уверенный ответ, а предлагать пользователю оба варианта как равноправные точки зрения и кратко их разъяснять. Не указывать с уверенностью на один из них и всё же иметь некий внутренний рейтинг достоверности источников и учитывать его.

Одно дело региональный «желтушный» сайт с сомнительной репутацией и другое дело СМИ федерального уровня. Одно дело статья некоего блогера, пусть даже и популярного «лома», и другое дело заявления официальных представителей.

В конце концов, можно было бы обучить специальную LLM оценивать каждый источник и каждую публикацию по критериям «возможной фейковости»,, а в процессе формирования окончательного ответа использовать её как цензора.

Но пока, видимо, этот уровень совершенства ещё не достигнут.

• И что делать?

Нам ничего не остаётся, как самим оценивать каждый источник и каждую публикацию по критериям «возможной фейковости» и самим включать своего внутреннего цензора.

Фильм «Тот самый Мюнхгаузен» (1980)

А барон Мюнхгаузен, как известно, хорош тем, что никогда не врёт (также, как ИИ).

Придётся самим оценивать, и робко надеяться, что со временем адекватность будущих Алис и Гуглов («режим ИИ») достигнет приемлемого уровня доверия.

Но как источник предварительно подготовленной информации, которая уже прошла обобщение и структуризацию, ответы современных ИИ уже очень даже хороши. Я сам с удовольствием пользуюсь этим для поиска и уточнения информации и оцениваю такой способ работы с информацией удобным и практичным (чаще всего «режим ИИ» от Гугла).

Я подчёркиваю: это предварительно подготовленная «информация к размышлению».

Это не окончательный правильный ответ.

Я понимаю разочарование и гнев, сарказм и насмешки, когда пользователи получают от ИИ фейки вместо результата, когда ожидания жёстко расходятся с реальностью.

В подобных случаях для себя я пользуюсь универсальной формулой Луция Аннея Сенеки (одного из главных философов-стоиков): не можешь изменить мир, измени своё отношение к нему.

Пойми, почему всё так, а не иначе, и наконец обрети спокойствие в мыслях.

Комментарии

А что с налоговой то?

;-)

Del.

Хорошая попытка, ФНС.

Но мы-то уже знаем правду!

Некоторые поверили. Но теперь уже спят спокойно зато...

Что обсуждаем то? Если так и есть - то норм.Если фейк то есть попытка раскачать нездоровый ажиотаж.

как обычно - вместо того чтоб просто посмотреть декларации чинуш и их родни и сравнить доходы и имущество - ищут как бы спалить что слесарь валера фурнитуру унитаза поменял за нал не оплатив налоги.

Есть подозрение, что подбираются к задницам тех, что стонет о воровстве чиновниками в соцсетях и одновременно несколько раз в год на курорты дороге летает. Так что внимательно наблюдаем.

Тоже дело хорошее, но начинать всёж надо не с них, а с тех у кого зп 400к.р а имущества на трюль.

Как говорят военные моряки: "Пароход описал циркуляцию и ещё раз наскочил на тот же риф."

Если ИИ выдаёт равноправные противоречащие друг другу трактовки/справки/утверждения == он не справился и не нужен.

Если работу ИИ приходится за ним проверять, тратя кучу собственного ресурса, то его смысл вообще не понятен. Флуда правдоподбного и так полно. Кроме того, трудоёмкость поиска ошибки может совпадать или даже превышать трудоёмкость исходной задачи. Тут вот статьи были ИИ-кодеров, так ошибки пофиксить в коде тяжело, т.к. нет возможности разобраться что, как и зачем сделано. Ну и фундаментальная проблема: если у вас ошибка в исходных "надёжных"/верифицированных данных (напр. в научной теории или обманной развединфо), то вы вообще не поймёте причину трабла.

Я вот и не понял - мониторит ФНС или нет? Фактов не надо.

Напишите, как на самом деле.

Тут все просто! Алиса шарится по интернету, собирает все, что пишут даже идиоты, и транслирует это вам. Вы потом пишете статьи.

Налоговые службы всех стран занимаются этим. В чем тезис? Что мы не все?

Алгоритмы машинного обучения сканируют публичные фото и видео из отпусков, посты о дорогих покупках (авто, недвижимость, гаджеты), а также другие признаки высокого уровня расходов. Если данные расходятся с налоговой отчётностью, информация передаётся инспекторам для проверки — это законно, так как используются только открытые источники.

При выявлении подобных несоответствий налоговая служба вправе инициировать проверку для уточнения источников доходов. Сам факт публикации не является нарушением закона, однако может послужить поводом для более детального анализа финансовой деятельности гражданина.

Прастити, как отличить фото фоне пальм по дороговизне? Не говоря о стоимости яхт?

Да фото это ерунда. Вот например может быть отзыв об отеле где отдыхали на каком нибудь тревел.ру. Или пост в интсаграме как мы побывали на Мальдивах. Все это собрать воедино и обработать не составляет проблем.

Но вообще самое элементарное это ведь просто проверить недвижимость по ЕГРН или машины в собственности по базе ГИБДД. Мне кажется все эти байки про соцсети это только байки, все ведь и так есть в базах.

Как пользователь всяких сайтов бронирования и отзывов могу отметить, что на отели с «коррупционным риском» типа ценника от условных 200 000 руб за ночь, отзывы почти не оставляют, а русскоязычные вообще не встречаются. Кроме «Мрии», но для получения информации о тамошних постояльцах ии не нужен вроде бы. А отель за условный полтинник может даже пенсионер позволить себе на пару дней в жизни, если дети не тянут из него соки. По мрии, кстати, можно погулять за какие-то копейки и сделать столько фото, что ии захлебнется анализировать. Или, например, ваш покорный слуга 6 лет назад жид в отельчике по 50 баксов за ночь, а пляж у него общий был с отельчиками по 5000 за ночь. Я почему про пальмы и вспомнил.

Интересен ИИ который будет по мелким фото часов определять модель и стоимость с привязкой к личности носителя. Только боюсь, что в РФ он будет считаться подрывающим основы строя даже при использовании госслужбой.

Базы авто по родне теперь действительно шерстят, причем стали делать это сравнительно недавно. Ну и не забывайте, что у людей государевых сплошь дети с коммерческой жилкой. Разве не может какой-нибудь молодой Тамвиенко или Соктин родителям подарки делать, на хозяйство подкидывать имущество в пользование?

Ну судя по последним громким делам многие чиновники даже и не думали ничего скрывать, максимум запись на родню.

Но прошареные конечно будут всё отмывать максимально легально.

Кем верифицированное? Господи, как можно вот это все писать на голубом глазу...

В чьих руках будет "верификация", тот и будет подавать вам говно на лопате. Учитесь уже сами оценивать брехню модели.

Какой дебил в 2026 будет выкладывать яхты в соцсети? Сами соцсети давно опустели, и аккаунты закрыты.

Элементарно все проверить по базам без всякого ИИ.

Просто вытягиваем из баз все по человеку и родственникам, недвижимость, машины, все траты по картам. И сопоставляем с его официальными доходами.

Если есть серьезная разница - всё, человек на крючке, а дальше уже дело времени когда до него доберется глаз следователя и всё поймет за пару минут.