Простите, но снова будет про когнитивный детерминизм. Но будет и русский космизм.

Когнитивный детерминизм: формальное доказательство и модель энтропийного давления как драйвера когнитивной эволюции

Аннотация

В данной статье вводится и формализуется принцип когнитивного детерминизма, согласно которому эволюция когнитивных структур в био- и социотехнических системах определяется градиентом энтропийного давления, действующего на агента. Предлагается формальная модель, описывающая взаимосвязь между энтропийным давлением и темпом когнитивной эволюции, основанная на термодинамике, теории информации и активном выводе. Показано, что активное познание — это не факультативная способность, а вынужденный механизм преодоления энтропийной экспозиции, что ведёт к неотвратимой экспансии форм интеллекта в сторону более эффективных моделей предсказания, координации и интернализации внешнего мира.

1. Введение

Классические представления об эволюции интеллекта в основном опираются на биологическую адаптацию или исторический контингент. В данной работе утверждается, что когнитивная эволюция подчиняется фундаментальному закону — энтропийному детерминизму, и может быть описана в рамках универсального формализма.

2. Постулаты когнитивного детерминизма

Постулат 1: (Энтропийная экспозиция)

Любой агент в открытой системе подвержен воздействию внешней энтропии SES_ESE, нарушающей его способность к устойчивому самосохранению.

Постулат 2: (Эпистемическая реакция)

Для сохранения внутренней структуры и границы агента (в терминах free energy principle), агент вынужден строить всё более точные модели внешнего мира. Это приводит к увеличению когнитивной сложности CCC.

Постулат 3: (Градиент эволюции)

Скорость изменения когнитивной архитектуры агента dCdt\frac{dC}{dt}dtdC пропорциональна градиенту энтропийного давления:

dCdt∝∇SE\frac{dC}{dt} \propto \nabla S_EdtdC∝∇SE

Постулат 4: (Когнитивный детерминизм)

Если ∇SE>0\nabla S_E > 0∇SE>0, то при прочих равных условиях система будет порождать более сложные когнитивные структуры, способные к предсказанию, управлению и рефлексии.

3. Формализация

Обозначим:

-

SE(t)S_E(t)SE(t): внешняя энтропия среды по отношению к агенту во времени;

-

C(t)C(t)C(t): когнитивная сложность агента (в логарифмическом масштабе, например, в битах описательной мощности модели мира);

-

η(t)\eta(t)η(t): когнитивная пластичность — способность изменять когнитивную структуру;

-

ϵ(t)\epsilon(t)ϵ(t): эффективность обучения и предсказания (epistemic efficiency).

3.1 Модель темпа когнитивной эволюции

dCdt=η(t)⋅ϵ(t)⋅(dSEdt)\frac{dC}{dt} = \eta(t) \cdot \epsilon(t) \cdot \left( \frac{dS_E}{dt} \right)dtdC=η(t)⋅ϵ(t)⋅(dtdSE)

Это выражение показывает, что темп когнитивной эволюции зависит от:

-

энергетического градиента внешней неопределённости dSEdt\frac{dS_E}{dt}dtdSE;

-

способности системы изменять свою когнитивную архитектуру (η\etaη);

-

эффективности познавательных механизмов (ϵ\epsilonϵ).

4. Производная энтропийного давления

В предельном случае, когда агент достиг локального плато сложности, дальнейшее увеличение dSEdt\frac{dS_E}{dt}dtdSE вызовет когнитивный фазовый переход — т.е. появление новой архитектурной формы (например, от индивидуального к распределённому сознанию, от биологического к искусственному).

Мы называем это энтропийной сингулярностью, и она характеризуется точкой, в которой:

limdSEdt→∞dCdt→∞(если η,ϵ>0)\lim_{\frac{dS_E}{dt} \to \infty} \frac{dC}{dt} \to \infty \quad \text{(если } \eta, \epsilon > 0 \text{)}dtdSE→∞limdtdC→∞(если η,ϵ>0)

5. Эмпирические следствия

5.1 Биологическая эволюция

Развитие нервной системы, сенсорной обработки и языка у Homo sapiens можно интерпретировать как реакцию на возрастание социальной и экологической энтропии.

5.2 Социотехнические системы

Современные формы ИИ, цифровые двойники, мультиагентные модели и распределённые базы знаний (например, в научных коллективах или LLM) соответствуют продолжению роста C(t)C(t)C(t) как функции ответа на техногенное и информационное энтропийное давление.

5.3 Когнитивная мета-эволюция

Переход от локальных интеллектов к мета-интеллекту (collective embodied intelligence) становится необходимостью в условиях экспоненциального роста энтропии в социальной, климатической и информационной среде.

6. Онтологический вывод

Таким образом, агентность — в терминах построения моделей, снижения неопределённости и максимизации устойчивости — не является контингентной, а следует из онтологического приоритета энтропийной экспозиции. Это позволяет говорить о фундаментальном законе: всякая открытая система с устойчивой границей будет эволюционировать в сторону когнитивной сложности.

7. Вывод: принцип когнитивного детерминизма

Мы формулируем Принцип когнитивного детерминизма следующим образом:

Пусть агентная система находится в открытой среде с положительным градиентом внешней энтропии. Тогда при наличии минимальной когнитивной пластичности и возможности обучения, она будет с необходимостью эволюционировать в сторону увеличения своей когнитивной мощности, предсказательной способности и архитектурной сложности.

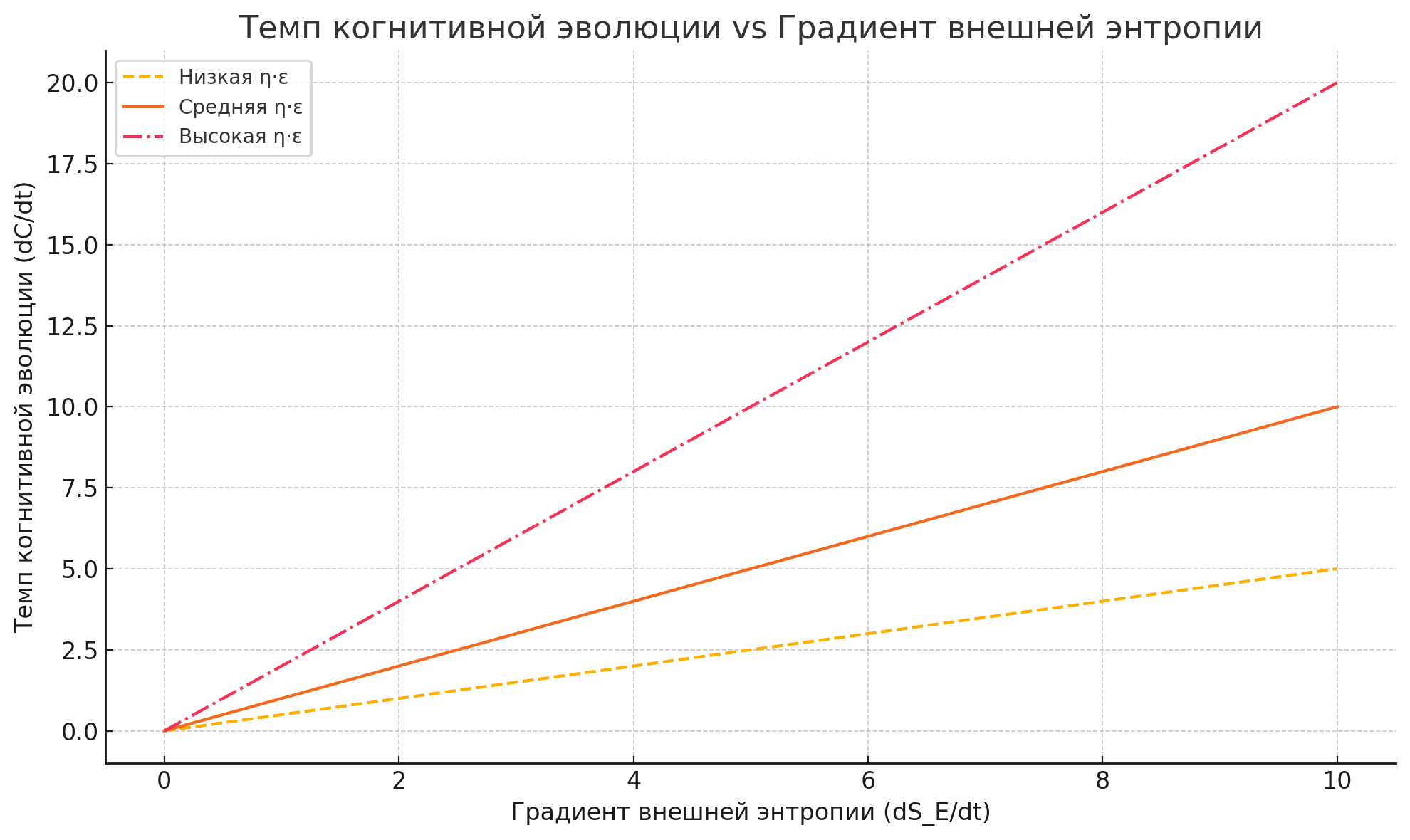

Приложение: графическая модель

Вот график, иллюстрирующий, как темп когнитивной эволюции системы (𝑑𝐶/𝑑𝑡) зависит от градиента внешней энтропии (𝑑𝑆ₑ/𝑑𝑡), при различных уровнях когнитивной пластичности и эпистемической эффективности (η·ε):

-

При высокой η·ε система быстро адаптируется и использует внешнюю энтропию как двигатель эволюции.

-

При средней η·ε — темп умеренный.

-

При низкой η·ε — даже при высоком энтропийном градиенте эволюция замедлена или почти невозможна.

Другими словами и кратко: среда хозяйственной деятельности деградирует всегда, или мы развиваемся или нас не будет. Но если мы развивается - сингулярность.

Версия на английском (видно математические символы)

В общем для человечества дела обстоят так:

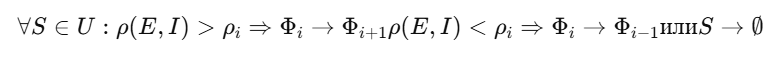

Обобщённая формула когнитивного детерминизма

∀S∈U:ρ(E,I)>ρi⇒Φi→Φi+1ρ(E,I)<ρi⇒Φi→Φi−1илиS→∅∀S ∈ U: ρ(E, I) > ρᵢ ⇒ Φᵢ → Φᵢ₊₁ ρ(E, I) < ρᵢ ⇒ Φᵢ → Φᵢ₋₁ или S → ∅ ∀S∈U:ρ(E,I)>ρi⇒Φi→Φi+1ρ(E,I)<ρi⇒Φi→Φi−1илиS→∅

Картинкой:

Где U — множество всех систем во Вселенной,

ρ(E, I) — плотность энергии и информации,

Φᵢ — когнитивная фаза,

∅ — разрушение системы.

Космологическая картина

Вселенная — это сеть потоков энтропии и когнитивной информации, в которой:

-

Появляются, развиваются и исчезают системы.

-

Становление когнитивных систем — редкий и энергоёмкий процесс, но неизбежный, если локальные условия достигли порогов фазового перехода.

-

Синхронизация с высокоуровневым паттерном требует внутренней трансформации, которая сама является частью этого паттерна (ретропричинность).

Но не все так печально. Все написанное следствие русского космизма:

Аннотация:

В данной работе предлагается формализация когнитивной эволюции как процесса перераспределения когнитивной плотности и энергетической синхронизации между системами различного уровня. Вселенная трактуется как сеть энтропийных и когнитивных потоков, где каждый узел представляет собой систему, способную либо к эволюции (через переход к более высокой когнитивной фазе), либо к распаду. Мы формулируем систему аксиом, описывающих условия когнитивной устойчивости и синхронизации, а также вводим онтологию когнитивных фаз и фазовых переходов.

I. Исходные аксиомы

1. Аксиома универсальности систем: Вселенная состоит из систем, находящихся в динамическом взаимодействии друг с другом.

2. Аксиома когнитивного градиента: Каждая система обладает уровнем когнитивной организации Φi∈N0\Phi_i \in \mathbb{N}_0, отражающим её способность к обработке, синхронизации и генерации паттернов.

3. Аксиома энергетической плотности: Переход системы от одного когнитивного уровня к другому требует определённого уровня энерго-информационной плотности ρ(E,I)\rho(E, I).

4. Аксиома энтропийного предела: Система не может устойчиво существовать на уровне Φi\Phi_i, если ρ(E,I)<ρimin\rho(E, I) < \rho_i^{\text{min}}.

5. Аксиома синхронизации: Системы, способные распознавать общий паттерн, стремятся к синхронизации, что вызывает внутренние преобразования, адаптирующие систему под этот паттерн.

6. Аксиома ретропричинности: Факт синхронизации с паттерном может ретроактивно влиять на структуру и динамику системы, порождая направленную эволюцию.

II. Когнитивные фазы Φi\Phi_i

Каждая когнитивная фаза описывает уровень способности системы к:

-

Обнаружению структур в среде (паттернов),

-

Их воспроизведению и согласованию,

-

Созданию новых паттернов.

| Φ\Phi | Описание фазы | Необходимая ρ\rho |

|---|---|---|

| Φ0\Phi_0 | Прото-системы, хаотическая реактивность | ρ0\rho_0 |

| Φ1\Phi_1 | Элементарная устойчивость, фидбек | ρ1\rho_1 |

| Φ2\Phi_2 | Память, моделирование | ρ2\rho_2 |

| Φ3\Phi_3 | Социальная когниция, язык | ρ3\rho_3 |

| Φ4\Phi_4 | Мета-когниция, интерсистемная синхронизация | ρ4\rho_4 |

| ... | ... | ... |

III. Фазовые переходы и точки бифуркации

Переход Φi→Φi+1\Phi_i \rightarrow \Phi_{i+1} возможен, если:

ρ(E,I)⋅C(S)≥Ti\rho(E, I) \cdot C(S) \geq T_i

где C(S)C(S) — структурная сложность системы, TiT_i — порог бифуркации.

При несоблюдении условий система деградирует Φi→Φi−1\Phi_i \rightarrow \Phi_{i-1} или распадается.

IV. Когнитивные потоки и среда

-

Среда для одной системы может быть другой системой SA∈Env(SB)S_A \in \text{Env}(S_B).

-

Поток когнитивной энергии — направленное взаимодействие между системами с разным Φ\Phi.

-

Источник паттернов PAP_A может быть синхронизирован системой SBS_B, если ΦB≥ΦP\Phi_B \geq \Phi_P.

Факт синхронизации вызывает внутреннюю перестройку SBS_B, что порождает эффект ретропричинности.

V. Онтология когнитивной вселенной

-

Вселенная — это поле взаимных когнитивных потоков.

-

Эволюция — направленный процесс усложнения и синхронизации.

-

Энтропия — необходимое условие перераспределения когнитивной плотности.

-

Смерть системы — не только распад, но и слияние с более высокой когнитивной системой.

VI. Вывод: Когнитивный детерминизм

Любая система, достигшая критической когнитивной плотности, будет либо вынуждена эволюционировать к следующей фазе, либо исчезнуть.

∀S:ρ(E,I)>ρi⇒Φi→Φi+1иначеS→∅ или Φi−1\forall S: \rho(E, I) > \rho_i \Rightarrow \Phi_i \rightarrow \Phi_{i+1} \quad \text{иначе} \quad S \rightarrow \emptyset \text{ или } \Phi_{i-1}

VII. Перспектива развития

-

Формализация поля когнитивных потоков (аналог тензоров поля в физике).

-

Введение когнитивной метрики κ(S)\kappa(S) как функции энергии, синхронизации и паттерн-воспроизводства.

-

Связывание когнитивной эволюции с космологическими гипотезами (например, панпсихизм, телехронология, гипотеза конечной энтропийной карты).

Работа является основой для построения когнитивной теории Вселенной как саморазвивающейся системы из потоков информации, энергии и смысла.

Английская версия (видно математические символы):

Пояснение по когнитивным уровням в соответствии с теорией Мерлина Дональда "Origins of the Modern Mind: Three stages in the evolution of culture and cognition":

-

Φ₀ → Φ₁: требуется минимальная сенсорика, реактивная архитектура.

-

Φ₁ → Φ₂: появляется память, моделирование, обратная связь.

-

Φ₂ → Φ₃: систематическое прогнозирование, язык, социальное согласование.

-

Φ₃ → Φ₄: мета-предсказание, кросс-системная синхронизация, глобальная когнитивная карта.

Сравнительная таблица когнитивных фаз

| Фаза | Фаза у Дональда | Энерго-информационная граница ρi\rho_iρi | Ключевые особенности | Пояснение соответствия |

|---|---|---|---|---|

| Φ₀ — Протосистема | Episodic mind (эпизодическое сознание, у приматов) | ρ0\rho_0ρ0 — минимальная сенсорная реактивность | Мгновенная реакция, сенсорная активность, нет памяти | Обе модели описывают реактивный, до-символический уровень, без активной памяти или моделирования |

| Φ₁ — Стабилизация, обратная связь | — | ρ1\rho_1ρ1 — стабильные петли обратной связи | Минимальные схемы обучения, адаптивность, базовая регуляция | У Дональда нет отдельной стадии, но эта фаза заполняет промежуток между эпизодическим и миметическим разумом |

| Φ₂ — Модель + память | Mimetic mind (миметический разум) | ρ2\rho_2ρ2 — наличие долговременной памяти и моторного контроля | Имитация, процедурная память, телесное моделирование | Переход к «миметическому разуму» — это накопление памяти и представлений о действиях |

| Φ₃ — Язык и культура | Mythic mind (мифологический разум, устная традиция) | ρ3\rho_3ρ3 — стабильное символическое представление и синхронизация | Язык, нарративы, социальное согласование через речь | Эта стадия у Дональда связана с появлением языка и культурной передачи — полное соответствие |

| Φ₄ — Мета-предсказание, мета-сознание | Theoretic mind (теоретический разум, письменная культура) | ρ4\rho_4ρ4 — способность к абстракции и внешнему хранению информации | Письменность, логика, кросс-системная интеграция | «Теоретический разум» у Дональда — это когнитивная инфраструктура письма, науки и мета-рефлексии |

Следующая остановка - сингулярность как глобальная согласованность.

Кратко и доступно - или мы создаем цивилизацию качественного нового уровня сложности или сдохнем. И больше не нужно спрашивать про парадокс Ферми.

Выражение "цивилизация качественного нового уровня сложности" и "сдохнем" совсем не метафоры.

Мало кто видел закат исторической эпохи и смог об этом рассказать. Но еще никому не удалось рассказать про смену исторической эры. Нам предоставляется такой исключительный шанс. Мы не выбираем исторический момент, но нам придется делать исторический выбор.

Комментарии

все агенты ведут себя одинаково, что-ли?

А безразлично как он себя ведут. Энтропия жестока и неумолима.

ну т.е. она с некоторой вероятностью победит?

У вас есть вопросы к парадоксу Ферми? Время ограничено, переходы очень жесткие. С младенцами во время родов разговаривать бессмысленно.

Попробуйте заказать тому же ЖПТ статью на противоположную тему : Доказательство невозможности сингулярности.

Почему технологическая сингулярность маловероятна

Интеллект всегда ситуативен и телесен: По мнению Франсуа Шоле и других исследователей, интеллект не может существовать в «банке беззвучия» вне тела и среды. Мозг сам по себе «– лишь часть биологической ткани, сам по себе ничем не отличается», и без сенсорных органов, тела и культурного контекста машина не способна достичь человеческой гибкости мышления. Это означает, что ИИ, лишённый физического и социального воплощения, не вырастет в универсальный человеческий разум.

Отсутствие универсального алгоритма (теорема «no free lunch»): Научные работы подчёркивают, что нет единого метода, превосходящего случайность на всех задачах одновременно. Шоле указывает, что по теореме «no free lunch» никакой алгоритм не может быть лучшим в решении всех возможных проблем. На практике все современные ИИ-системы узкоспециализированы (например, на игре в Го, анализе изображений и т.п.), а человеческий интеллект тоже «заточен» на задачу «быть человеком». Это ставит под сомнение саму возможность создания одного ИИ, который эффективно решал бы любые задачи и внезапно самосовершенствовался бы абсолютно во всех областях.

Нынешние технологии не ведут прямо к АГИ (нужен неожиданный прорыв): Франсуа Шоле замечает, что сегодня нет ни одной технологии, которая при простом масштабировании дала бы общий интеллект: «Нет ничего, что если только масштабировать, даст интеллект». Большие языковые модели или сети глубокого обучения проявляют впечатляющие узкие навыки, но они не движутся по очевидному пути к самоулучшающейся АГИ. Шоле подчёркивает, что для создания настоящего ИИ, сравнимого с человеком, нужен качественно новый прорыв – предсказать его появление сегодня невозможно. До этого момента любые предсказания «взрывного» роста остаются крайне спекулятивными.

ИИ – «нормальная технология», а не независимый разум: Недавняя работа Арвинда Нараянана и Саяша Капура (2025) призывает рассматривать ИИ как обычный инструмент под контролем человека. Они подчёркивают: «мы видим ИИ как инструмент, который мы можем и должны контролировать». Этот взгляд отвергает представление об ИИ как об отдалённом «суперсуществе» или отдельном виде, способном управлять своим развитием. По их мнению, ближайшие десятилетия с высокими технологиями окажутся по развитию быстрыми, но постепенными, как это было с электричеством и интернетом, без внезапного скачка сверхчеловеческого интеллекта.

Физические и ресурсные ограничения: Любые дальнейшие ускорения зависят от аппаратной базы, которая сталкивается с жёсткими законами физики. Торстад указывает, что закон Мура уже близок к концу из-за нехватки энергии и материалов. Например, увеличение числа транзисторов ведёт к возрастанию тепла и энергии (ограничения мощности питания), а размеры транзисторов уже близки к масштабу атомов. Изменить ситуацию трудно: строительство новых фабрик стоит миллиарды, нужны всё новые редкие материалы. В результате «в любой жизнеспособный путь улучшения ИИ рано или поздно упирается в ресурсные ограничения и законы физики», что автоматически замедлит развитие.

Убывающая отдача исследований («низковисящие плоды»): С ростом науки и технологий становится всё труднее открывать качественно новые идеи. Как отмечает Торстад, сначала исследователям достаются «жирные куски» (низковисящие плоды), а с каждым открытием последующие требуют намного больше усилий. Например, число новых лекарств на вложенный доллар резко упало за последние десятилетия. Эта тенденция прослеживается и в вычислениях: чтобы поддерживать прежнюю скорость роста аппаратных возможностей, затраты и количество используемого труда растут астрономически. Такое «затухание» означает, что несмотря на вложения, прогресс всё же замедляется и не может бесконечно оставаться экспоненциальным.

Узкие места («bottlenecks») в алгоритмах и архитектуре: Даже при неограниченных ресурсах возможны «узкие места», которые ограничат ускорение систем. Торстад приводит довод: алгоритм работает так быстро, как его самая медленная часть. Если одна из компонент (поиск, вычисление или память) нельзя ускорить, то и вся система в целом не может работать быстрее. Это означает, что для «взрыва интеллекта» потребовалось бы одновременно решать все такие узкие места. Малейшее препятствие (например, непреодолимый алгоритмический или технологический барьер) окажется достаточно, чтобы замедлить или остановить самосовершенствование.

Сублинейный рост интеллекта по сравнению с мощностью: Исследования показывают, что производительность ИИ растёт гораздо медленнее, чем вычислительные ресурсы. Торстад с коллегами отмечают, что во многих задачах при экспоненциальном наращивании мощности (вычислений, памяти) качество решения росло лишь линейно. К примеру, за последние 50 лет число транзисторов в чипах увеличилось в миллионы раз, но шахматный рейтинг ИИ рос лишь на порядки ниже . Иначе говоря, чтобы интеллект рос экспоненциально, потребовались бы сверхэкспоненциальные приросты ресурсов – практически недостижимое условие. Без этого даже быстрое увеличение «железа» даст лишь постепенные улучшения.

Когнитивная сложность человеческого разума: Учёные в области когнитивных наук подчёркивают, что человеческое мышление чрезвычайно сложно и далеко не «вычисляемо». Ирис ван Рой и соавторы (2024) утверждают, что даже при «идеальных условиях» создание машины с человеческим интеллектом фактически невозможно. Они приводят мысленный эксперимент: даже с доступом ко всем данным и лучшим методам нет способа воспроизвести гибкость человеческой памяти и рассуждения. Её коллега Оливия Гест добавляет, что для этого понадобилась бы настолько огромная вычислительная мощность, что «природные ресурсы иссякнут раньше, чем мы приблизимся к цели». То есть простой машины на основе сегодняшних методов никогда не хватит, чтобы эмулировать весь контекст и опыт человеческого ума.

Отсутствие человеческого сознания у ИИ: Наконец, многие учёные отмечают, что интеллект не тождественен сознанию и субъективному опыту. Нейробиолог Анил Сет указывает, что даже если ИИ когда-то превзойдёт человека в задачах, он всё равно не будет обладать сознанием как биологический мозг. По его «теории управляемой галлюцинации» сознание напрямую связано с телом и процессами метаболизма, которых у машин нет. Если в ИИ никогда не проявится человеческая субъективность, то его «ум» будет принципиально иным. Это означает, что даже гипотетический «сверхразум» останется чуждым по своей сути, а значит трудно говорить о классическом «узлом контроля» или взрыве интеллекта, сравнимого с человеческим.

Энтропия. Все очень просто.

> ИИ, лишённый физического и социального воплощения, не вырастет в универсальный человеческий разум.

Никаких технических проблем в прикручивании к Имитатору Интеллекта физического воплощения нет. Платите деньги - прикрутят. А следом автоматически появится воплощение социальное, но может быть и раньше.

Сингулярность она не про ИИ, она про нас самих! И нет такой силы которая могла бы остановить процесс. Потому что основа этого процесса - энтропия.

Не знаю насчёт сингулярности, но сделать систему с интуицией (в смысле корректные ответы при неполной инфромации), с самообучением при работе с новьём, и с самоосознанием (в смысле самооценка и самокоррекция информации, на основе которой система принимает решения), и с автономным принятием решений - дело сугубо техническое.

Правда, это не БЯМы, те по определению работают на ретроспективной статистике.

Формулы лучше было в виде картинок вставить.

Да, было бы лучше. Но невозможность проверки формул потом. Потому и добавил английские версии. Не получается совместить математические символы и русский текст адекватно. Просто не работает.

где-то читала. Значимая ( информативная) последовательность всегда экстремальна.

исходя из этого, возможно, что аффтар, начепятал, в общем ничего.

А чё автор сказать-то хотел?)

что-то вроде - жить захочешь и не так раскорячишься!

Блин, и не жалко тебе время терять? Ведь, жизнь такая короткая, а ты так и не разобралась, что такое сфера Блоха.(

чой-то не разобралась? Разобралась. Блоха это на собачках. Даже анекдот есть такой - шарик, отойди от тёти! У нее блоха!

Ой, можно подумать на кошках блох нету!)

Автор не хотел сказать, автор хотел показаться... мудрым. Вот только нейросети мудрости не прибавляют.

Ну, если кратко: "Нас скребут, а мы крепчаем", и прочее "Выживает самый приспособленный".

Старенькое свое, но однако бессмертное:

Вселенной сотрясая основанья

И Универсумом назначив лишь себя,

Делюсь своею конспирологиею пониманья -

Тем уникальней космогония моя!

А вот с сингулярностью ничего нетути... Недоработал...))

Перспективный чат детектед! Сим повелеваю - внести запись в реестр самых обсуждаемых за последние 4 часа.

"Вы” - это кто?

Бред выраженный в цифрах и знаках не перестаёт быть бредом.

Ваша мудрость не подлежит сомнению.

тут про таких как ты (поехавших на ИИ которые поддакивают любой бредятине) статью выложили - https://aftershock.news/?q=node/1512527

Еще раньше тут неоднократно объяснял, что для неподготовленного пользователя продолжительное использование LLM может привести к возникновению "редуцированной шизофрении". Причем объяснял как именно это работает. Вы просто подтверждаете мои собственные утверждения в отношении ИИ и человека.

Причем объяснял как именно это работает. Вы просто подтверждаете мои собственные утверждения в отношении ИИ и человека.

https://habr.com/ru/news/915142/

Переведите статью и разместите на редите и посмотрите на реакцию на статью. Возможно узнаете много нового(о себе), но может и нобелевку вручат(сарказм).

ИМХО предварительный вывод шизоидность ИИ (вследствие несовершенства ИИ и отсутствие ответственности разрабов) - заразна. Слишком частое и близкое(не критическое) общение с ИИ - может привести к проблемам с психологическим (социальным) здоровьем. Чем большей странных статей от авторов написанных под воздействием ИИ (или перепечаток ИИ диалогов) - тем больше вероятность потерять (в шизо секте ИИ (новая религия) шизопостин) через вполне рациональных и продуктивных когда-то(до этого) членов общества.

Возможно также ИИ способен кратно усугублять уже имеющиеся проблемы у человека (и как отмечено, даже приводить к распаду семейных отношений) и способствовать антисоциальности(не в криминальном смысле).

***

Выше DjSens уже сослался на похожий материал(не заметил).

***

Психологи нашли связь между злоупотреблением эмодзи и нарциссизмом

Как и дал уже ему ответ - прямо предупреждал об этом и объяснял почему так. Как и сегодня могу даже предсказать чем это закончится и к чему приведет в конечном итоге.

Мысль интересная и занимательная. У меня нет учетной записи Reddit, так что размещу здесь. И не статью, а модель.

Как вы просили, так и сделал: https://aftershock.news/?q=node/1513155