Разбираемся с artificial general intelligence — искусственным разумом, который будет способен решать любые задачи и соперничать с гениями.

(Длинное чтиво на тему ИИ второго уровня.. Описание, прогнозы и перспективы. Время чтения ~30 минут. 🥴 Может больше... Эт если вдруг будет желание погрузиться в эту тему чуть глубже мнений экспертов. Статья представляет собой архив ключевых материалов по тематике Искусственного Интеллекта и рассчитана на широкий круг читателей.)

Несмотря на впечатляющий прогресс искусственного интеллекта, AGI (artificial general intelligence) — сильный ИИ, способный выполнять умственную работу на человеческом уровне, до сих пор не покинул страниц научной фантастики и философских трактатов. Даже самые крутые нейросети GPT-4 и PaLM, справляющиеся со множеством интеллектуальных задач, не являются им. Исследователи отмечают, что в них наблюдаются лишь отдельные элементы («искры») сильного ИИ.

Тем не менее успехи науки в области нейросетей позволяют надеяться, что универсальный интеллект появится уже скоро. По самым оптимистичным прогнозам это может случиться через несколько лет — когда выйдет одна из языковых моделей следующего поколения.

В этой статье вы узнаете, что такое AGI, какие есть перспективные разработки в этой области и что обо всём этом думают эксперты IT-отрасли. Более того, мы пригласили поделиться своим видением будущего искусственный интеллект ChatGPT — самого продвинутого чат-бота современности.

Содержание

- Чем AGI отличается от обычного ИИ

- Super AI будет круче AGI

- Искусственный, сильный и общий интеллект

- Должен ли AGI быть роботом

- Тесты для проверки AGI

- Возможности AGI: мнение специалистов

- GPT-5 может достичь уровня AGI

- Будущее языковых моделей и переход к AGI

- Проекты AGI на языковых моделях

- Когда будет создан AGI

- Что ещё почитать про AGI: подборка книг

Чем AGI отличается от обычного ИИ

Программы на основе искусственного интеллекта, которые мы сейчас используем, — узкоспециализированные. Например, ИИ, предназначенный для игры в шахматы, не может генерировать изображения или диагностировать заболевания.

Поэтому все существующие варианты ИИ учёные относят к классу узкого ИИ (ANI, narrow AI), иногда называемому слабым ИИ (weak AI). Такой искусственный интеллект может решать отдельные задачи в узких предметных областях под управлением человека.

Ожидается, что следующим этапом развития ИИ станет создание универсальной системы, которая сможет решать любые задачи, подвластные человеческому разуму. Нейросеть такого уровня будет относиться к классу общего (AGI, artificial general intelligence), или сильного ИИ (strong AI).

Ключевое отличие сильного искусственного интеллекта заключается в способности самостоятельно мыслить и действовать подобно человеку. Каждый из нас ежедневно совершает огромное количество интеллектуальной работы: управляет автомобилем, планирует финансовые траты, общается с людьми, пишет, читает, играет и так далее. Предполагается, что общий ИИ сможет обучиться этому. И это не всё. По мнению некоторых учёных, у AGI должна быть внутренняя мотивация, умение ставить цели, способность делить сложные задачи на мелкие подзадачи и другие навыки, которые есть у нас с вами.

«Обобщённое каноническое определение общего (сильного) искусственного интеллекта на основе частных определений Бена Герцеля, Пей Вонга, Шейна Легга и Маркуса Хаттера звучит как „способность достигать сложных целей в различных сложных средах в условиях ограниченных ресурсов“».

АНТОН КОЛОНИН,

кандидат технических наук, ведущий специалист Новосибирского государственного университета, основатель проекта Aigents, архитектор проекта SingularityNET, эксперт РСМД (источник: «В чём сила, Сильный ИИ?»)

Super AI будет круче AGI

Хотя сильного ИИ пока не существует, специалисты уже придумали название для вида интеллектуальных систем, которые будут превосходить даже его. Супер ИИ (ASI, super AI) сможет выполнять любые интеллектуальные задачи не просто на уровне человека, а во много раз лучше его. С интеллектом такого уровня человечество ещё никогда не сталкивалось.

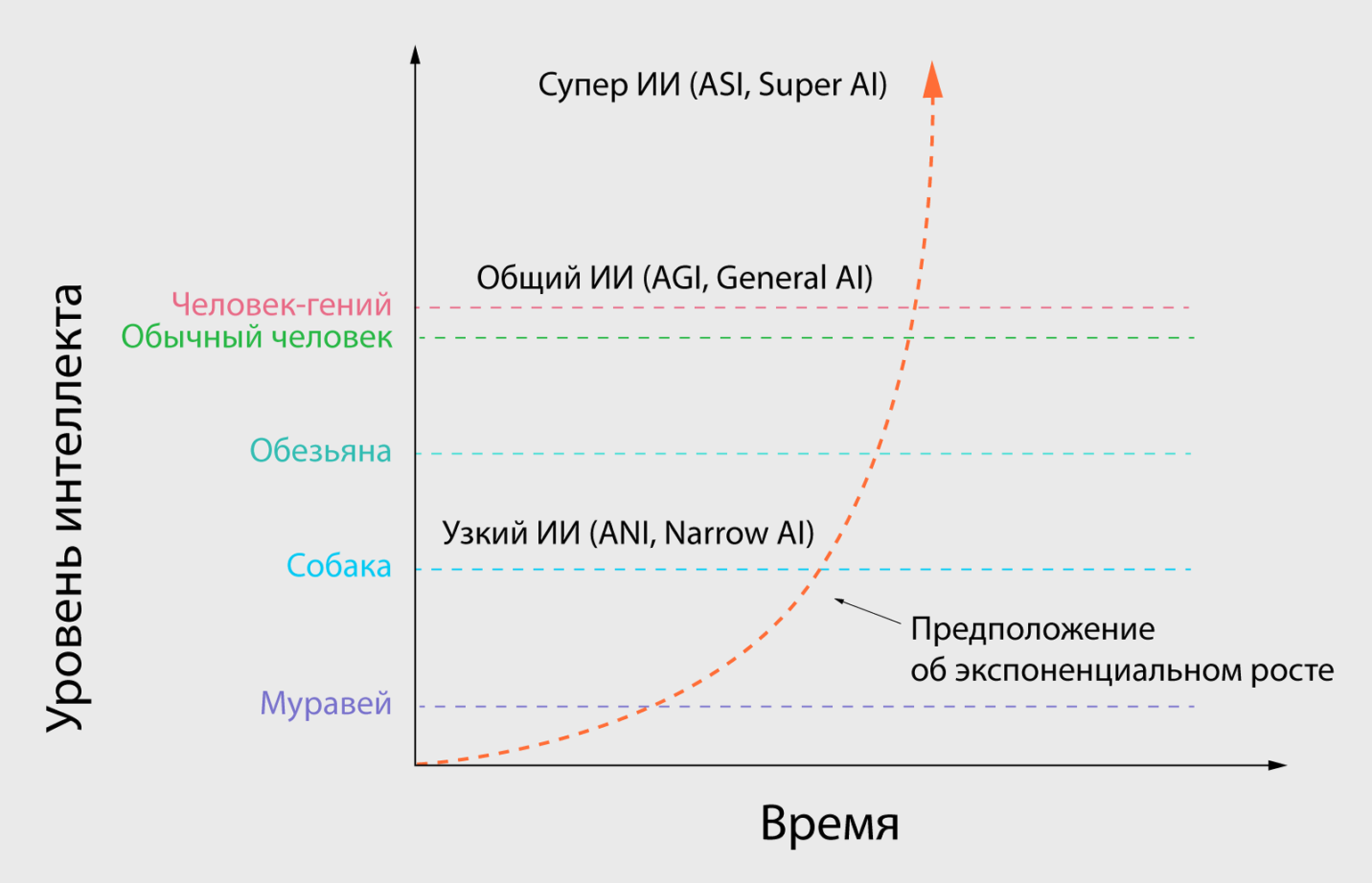

Наглядное представление об уровнях интеллекта и процессе развития ИИ. Учёные предполагают, что возможности ИИ будут расти по экспоненте. Это станет возможным за счёт того, что ранние варианты AGI смогут обучаться и совершенствоваться самостоятельно, без участия человека.

Иллюстрация: Polina Vari для Skillbox

«Суперинтеллект — это интеллект, который по своим возможностям значительно превосходит возможности мозга умнейших представителей человечества практически во всех областях, включая научное творчество, общую мудрость и социальные навыки. Это определение оставляет открытым вопрос о том, как будет реализован сверхразум: это может быть цифровой компьютер, совокупность компьютеров, объединённых в сеть, выращенная в лаборатории мозговая ткань или что-то ещё. Оно также не даёт ответа, будет ли суперинтеллект иметь сознание и субъективный опыт».

НИК БОСТРОМ,

философ, профессор Оксфордского университета, основатель Института будущего человечества (источник: How long before superintelligence?)

Искусственный, сильный и общий интеллект

Современную дискуссию об интеллектуальных способностях машин начал английский математик Алан Тьюринг в 1950 году в статье «Вычислительные машины и разум». Он предложил критерий, определяющий, может ли компьютер действовать подобно человеку, получивший название тест Тьюринга.

Летом 1956 года ведущие учёные, среди которых были Клод Шеннон и Джон Маккарти, собрались на конференции, получившей название Дартмутский семинар. Они предложили ввести в оборот понятие «искусственный интеллект», которое в то время соответствовало современному пониманию сильного ИИ.

Однако, прогресс в области ИИ шёл медленнее, чем ожидалось. Многие учёные занялись исследованиями в области слабого искусственного интеллекта. Поэтому в дальнейшем под ИИ стали понимать программы, способные решать интеллектуальные задачи лишь в какой-то одной области.

В 1980 году философ Джон Сёрл предложил концепцию сильного искусственного интеллекта. Он описал мысленный эксперимент под названием «Китайская комната». В нём алгоритм или человек, не понимающий китайского, следуя инструкциям, мог выдавать осмысленные ответы на этом языке.

Таким образом, Сёрл подверг критике тест Тьюринга и ввёл разделение ИИ на слабый и сильный. Первый может лишь имитировать интеллектуальную деятельность, второй — обладает подлинным пониманием и сознанием.

Рисунок, иллюстрирующий суть мысленного эксперимента «Китайская комната»

Иллюстрация: Polina Vari для Skillbox Media

В конце 1990-х годов с развитием нейросетей потребовалось понятие, позволяющее отделить узкие интеллектуальные системы от ИИ, способного решать разнообразные задачи. Так в 1997 году появилось словосочетание общий ИИ (AGI). Одним из главных популяризаторов этого понятия стал Бен Герцель, написавший книгу Artificial General Intelligence.

Сильный и общий ИИ очень похожи по своим возможностям, и обычно между ними ставят знак равенства. Но различия кроются в философии. AGI может работать без истинного понимания сути решаемых задач, в то время как сильный ИИ осознаёт их. Важно, что сознание во втором случае не обязательно будет идентично человеческому.

«AGI можно охарактеризовать известным в науке термином „философский зомби“. Такой ИИ напоминает зомби потому, что не осознаёт себя, не принимает ответственность за свои решения. Общение с AGI вполне может напоминать общение с персонажем Страшилой из сказки „Волшебник Изумрудного города“. Этот персонаж на все вопросы отвечал в стиле: „Если б у меня были мозги, то я бы сделал так …“. При этом его ответы были весьма не глупы.

АЛЕКСАНДР АМБАРЦУМОВ,

разработчик сервисных роботов, основатель компании AlexRobotics

Должен ли AGI быть роботом

В рамках AGI учёные размышляют, необходимо ли наделять общий ИИ собственным телом. Ответ на этот вопрос делит учёных на два лагеря.

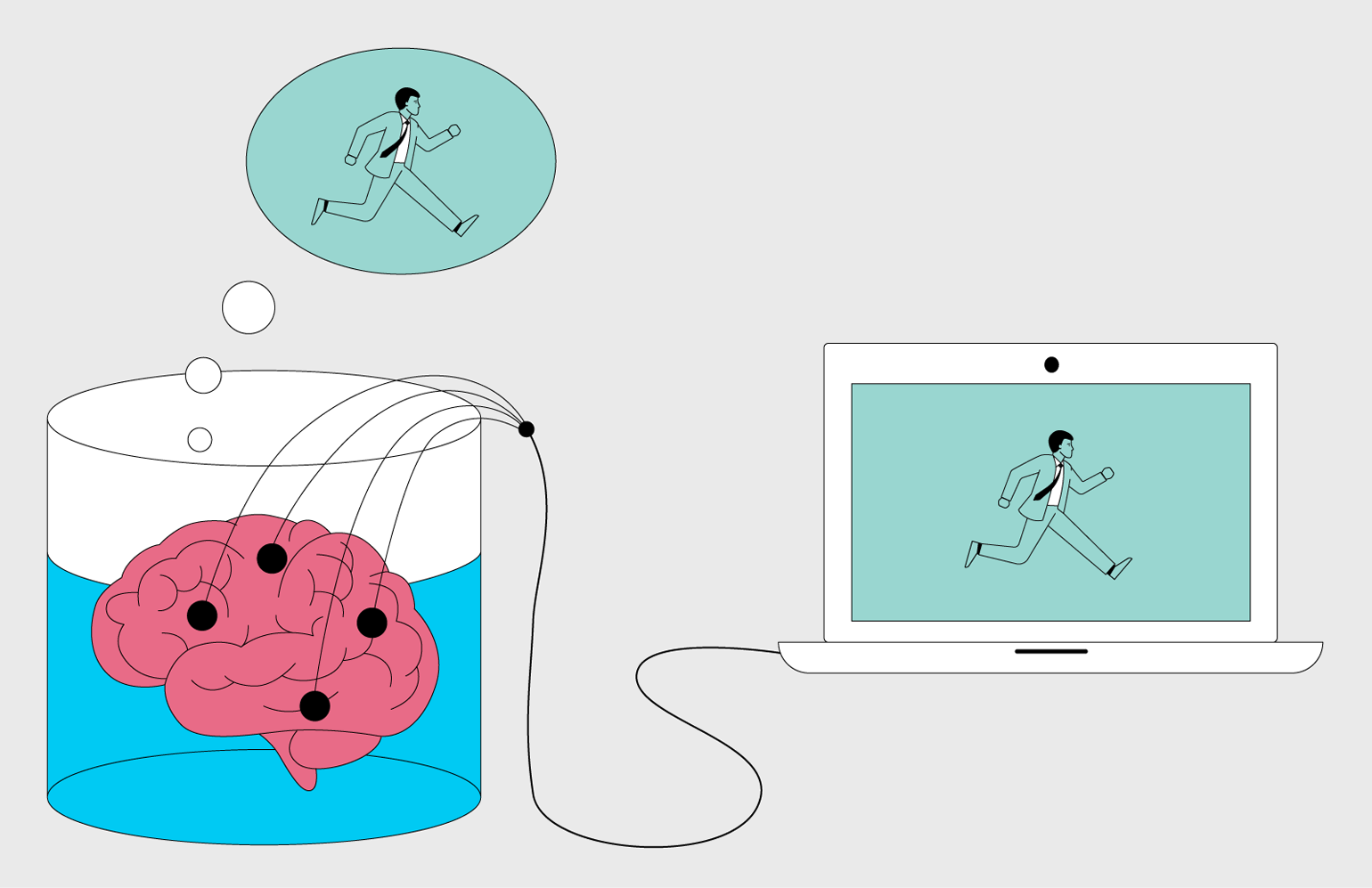

Первые считают, что тело для создания AGI не играет решающей роли и всё необходимое для ИИ можно сымитировать в виртуальном пространстве. Суть такого подхода можно описать с помощью философского понятия «мозг в колбе». Согласно ему, носитель сознания, отделённый от тела, может испытывать весь спектр ощущений, который он мог бы получать с физическим телом.

Рисунок, иллюстрирующий суть концепции «мозг в колбе»

Иллюстрация: Polina Vari для Skillbox Media

МНЕНИЕ ИСКУССТВЕННОГО ИНТЕЛЛЕКТА:

«Для AGI не обязательно наличие собственного тела. Он может существовать в виде программного обеспечения, работающего на компьютере, и эффективно выполнять широкий спектр задач. Однако роботизированные формы AGI будут иметь преимущество при взаимодействии с физическим миром».

CHATGPT,

чат-бот от компании OpenAI

Вторые полагают, что вся интеллектуальная деятельность человека так или иначе связана с телесными ощущениями и чувственным опытом. Поэтому без роботизированного тела, подобного человеческому, общий ИИ не сможет существовать и эффективно функционировать. Теория, развивающая это направление исследований, называется воплощённым познанием (embodied cognition).

Примирить эти подходы к AGI призвано понятие интеллектуального агента. Так называют ИИ, который может самостоятельно действовать в окружающей среде. В зависимости от того, где должен находиться агент — в реальном или в виртуальном пространстве, — он может быть либо воплощён в физическом мире, либо быть полностью цифровым.

Кадр: фильм «Терминатор 2: Судный день» / Carolco Pictures

«В фильме „Терминатор“ искусственным суперинтеллектом является не сам робот в исполнении Арнольда Шварценеггера, а компьютерная система „Скайнет“, которая эволюционировала в „бестелесном“ виде. Робот же сначала всего лишь инструмент „Скайнет“, одно из её воплощений. А впоследствии — вышедший из-под контроля „отпрыск“ бестелесного ИИ».

АЛЕКСАНДР АМБАРЦУМОВ,

разработчик сервисных роботов, основатель компании AlexRobotics

Тесты для проверки AGI

Чтобы определить, относится ли ИИ к AGI, учёные и инженеры придумали ряд тестов. При этом многие из них предполагают наличие «тела», так как без него тест не пройти:

- Тест студента, предложенный Беном Герцелем — если умная машина сможет поступить в университет, пройти те же курсы, что и другие студенты, а затем защитить диплом, то она обладает общим интеллектом.

- Тест трудоустройства, придуманный Нильсом Дж. Нильссоном — если умная машина сможет самостоятельно устроиться на работу и выполнять на ней экономически обоснованные функции, то она обладает общим интеллектом.

- Тест IKEA от Чарли Ортиза — если умная машина сможет самостоятельно научиться правильно собирать мебель из магазина IKEA на основе прилагаемой инструкции, то она обладает общим интеллектом.

- Кофейный тест, предложенный Стивом Возняком — если машина сможет приготовить и подать кофе, оказавшись на незнакомой кухне, то она обладает общим интеллектом.

- Тест учёного — если машина сможет самостоятельно совершать оригинальные научные открытия, в том числе те, которые могут претендовать на Нобелевскую премию, то она обладает общим интеллектом.

Фрагмент фильма Blade Runner (1982). В этой киноленте был показан вымышленный тест Войта-Кампфа, используемый для того, чтобы отличить человека от репликанта

Источник: «ВХСник» / YouTube

«Если мы говорим о том, что нужно, чтобы искусственный интеллект развивался в физическом мире, взаимодействовал с ним, чтобы он был подобен нам — то ему надо обеспечить подобные нашему способы восприятия. ИИ, который можно назвать „полноценным“, должен обучаться, существовать и взаимодействовать с нашим миром, основываясь на ощущениях сходных ощущениям биологического тела. Для этого такой ИИ должен иметь возможность испытывать, например, чувство голода, ощущать вкус пищи и различные эмоции, которые свойственны человеку.

При этом необязательно заниматься полным копированием биологии или клонированием, подобным процессу из фильма «Аватар». Достаточно смоделировать в любом, даже механическом, теле основные особенности человеческого организма — несовершенство зрения, слуха, искажение восприятия, связанное с меняющимся уровнем гормонов и так далее».

АЛЕКСАНДР АМБАРЦУМОВ,

разработчик сервисных роботов, основатель компании AlexRobotics

Возможности AGI: мнение специалистов

Чтобы разобраться, что собой может представлять общий интеллект, мы попросили специалистов отрасли и ChatGPT, описать их ожидания, связанные с появлением AGI.

«AGI должен проявлять широкие способности, подобные человеческому интеллекту. Он должен уметь рассуждать, планировать, учиться на собственном и чужом опыте, понимать окружающий мир и взаимодействовать с ним на уровне, сравнимом с уровнем человека».

ДМИТРИЙ КИСЕЛЁВ,

научный сотрудник Института искусственного интеллекта AIRI

«Существует несколько десятков определений термина AGI: довольно разных и зачастую противоречащих друг другу, да и к тому же требующих итеративного (а то и рекурсивного) уточнения понятий, используемых в этих определениях.

Поэтому лучше оставить терминологические споры философам и просто использовать «критерий утки»: если ИИ в качестве интеллектуального агента способен выглядеть в глазах людей человеком, выполнять любую интеллектуальную работу, как люди, и действовать в новых для него ситуациях так, как действовали бы на его месте люди, — будем считать, что этот ИИ является общим интеллектом (AGI)».

СЕРГЕЙ КАРЕЛОВ,

эксперт в области междисциплинарных исследований и стратегической аналитики, ведущий авторского канала «Малоизвестное интересное» (источник: «Поворотный момент пройден — AGI появится через 1,5 года»)

«Никто точно не знает, на что будет способен AGI, — ведь машинный интеллект разительно отличается от человеческого. Это почти то же самое, что попробовать представить, о чём думают дельфины, или наоборот.

Тем не менее можно предположить, что AGI будет способен:

- Обучаться и адаптивно применять полученные знания в широком спектре задач и областей, в неизвестных ситуациях. Адаптироваться к изменяющейся среде и обучаться на основе новых данных и опыта. Самостоятельно расширять свои навыки и знания, не требуя постоянного вмешательства разработчика.

- Понимать контекст и связи между различными идеями и концепциями, улавливать сложные взаимосвязи и обобщать информацию для принятия разумных решений.

- Обладать некоторым уровнем самосознания и осознания себя как сущности. Это может включать осознание своего состояния, своих навыков и ограничений, а также осознание своей цели или задачи.

- Демонстрировать элементы творческого мышления, генерацию новых идей. Сможет предлагать нетривиальные решения и подходы к задачам, не ограничиваясь только предопределёнными алгоритмами и шаблонами».

АНДРЕЙ ГЛЕБОВ,

СЕО проекта Bithoven, криптоэнтузиаст, рационалист, соавтор книги «Скайнет в эпоху киберпанка. Теория сверхразума и вызовы перед человечеством в XXI веке», написанной с помощью нейросети GPT-4.

«AGI — это некий ИИ общего вида, который может давать экспертные (или хотя бы более-менее осмысленные) ответы на различные вопросы из широкого спектра областей знаний, относящихся к различному набору тематик. Таким образом, мы ожидаем от AGI, что с ним можно будет поговорить на любые темы.

Создание AGI даст нам прекрасного помощника для выполнения разнообразных повседневных дел. Некоего умного ассистента. AGI — это очень полезная штука, но она не избавит нас от необходимости самостоятельного принятия решений. Решений как в отношении собственной жизни, так и более глобальных.

Человек, чрезмерно полагающийся на подсказки AGI-ассистента, вполне может стать марионеткой, действующей по указке AGI и/или людей, которые его контролируют.

С моей точки зрения, самым правильным решением является «интеграция» AGI в человеческое мышление. Сделав AGI средством понимания человеком сложных элементов современного мира, а не заменой этого понимания. Так как «Чего человек не понимает, тем он не владеет…»».

АЛЕКСАНДР АМБАРЦУМОВ,

разработчик сервисных роботов, основатель компании AlexRobotics

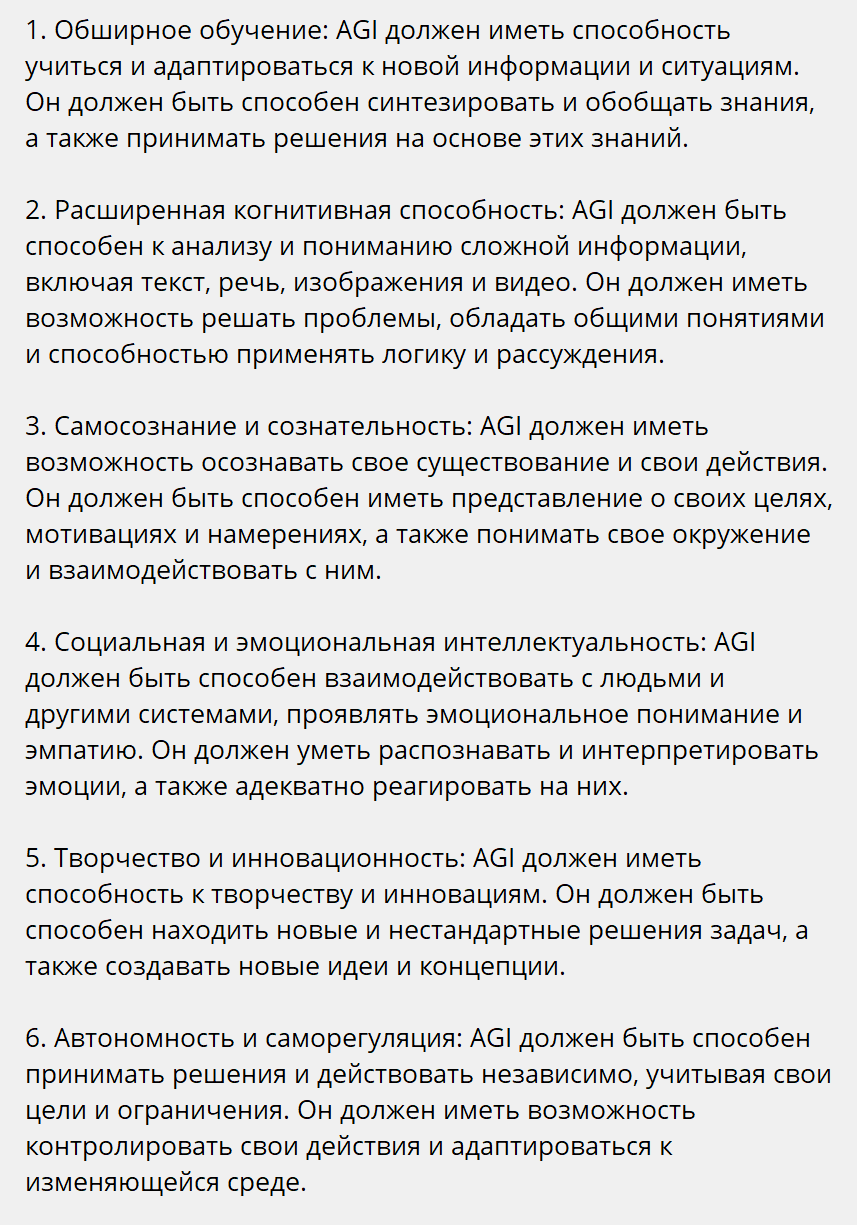

«Я задал вопрос, какими свойствами должен обладать AGI, популярному чат-боту ChatGPT. Его ответ в целом выглядит верным (скриншот прилагаю). Но это совершенно не говорит о том, что ChatGPT является AGI.

Ответ бота получен неверным по своей сути образом — без размышлений о проблеме, а только лишь подбором наиболее вероятных в данном контексте токенов. Поэтому в ответе присутствует «выжимка» из научно-популярных книг, но нет размышлений о критериях экспериментов, в которых мы могли бы отличить эмуляцию, видимость правильного решения, от такого же решения, но полученного правильным способом.

А ведь задача синтеза нового знания является фундаментальной, нужны метрики новизны, и они подвергаются сомнению даже в научном сообществе. Поэтому ещё одним свойством AGI, которое не назвал ChatGPT, мог бы быть алгоритм проверки его самого на соответствие уровню сильного ИИ. Работы в этом направлении ведутся, но хороших тестов для AGI на целеполагание, мотивацию или способность ставить себе цели пока нет».

ВИКТОР НОСКО,

генеральный директор компании «Аватар Машина», создатель чат-бота-психолога «Сабина Ai», соавтор проекта FractalGPT

МНЕНИЕ ИСКУССТВЕННОГО ИНТЕЛЛЕКТА:

«Прежде всего AGI должен обладать способностью обучаться и применять полученные знания в широком спектре задач, выходящем за рамки конкретной предметной области. Также AGI должен обладать способностью к самосознанию и обладать целостным и последовательным когнитивным опытом. Он должен демонстрировать самостоятельность в принятии решений, гибкость, адаптивность и способность общаться с людьми на естественном языке. Наконец, AGI должен проявлять творческое мышление и способность к самоулучшению, что отличает его от ограниченных ИИ-систем».

CHATGPT,

чат-бот от компании OpenAI

GPT-5 может достичь уровня AGI

По наблюдениям экспертов появление сильного ИИ возможно в ходе дальнейшего совершенствования искусственных нейронных сетей. Впечатляющие результаты по обработке текстов показывают большие языковые модели (LLM), основанные на архитектуре искусственных нейронных сетей под названием Transformer.

Именно они лежат в основе модели GPT-4 от компании OpenAI, с которой сегодня может поговорить любой желающий через чат-бот ChatGPT. Аналогичные разработки ведут и другие компании. Например, Google в прошлом году представил новый ML-алгоритм PaLM. Его предыдущая версия под названием LaMDA в 2022 году во время разговора с тестировщиком сумела убедить его в своей разумности.

«Последние версии ChatGPT/GPT-4 от компании OpenAI позволяют зафиксировать определённые технологические прорывы. Наконец-то „по-честному“ пройден Тест Тьюринга. Качество диалогов ChatGPT позволило ему всего за полгода выйти на аудиторию в 100 миллионов пользователей, большинство из которых находят ответы бота вполне „человеческими“. Более того, проведённое недавно испытание ChatGPT на IQ-тест в его текстовом варианте показало, что „интеллект“ бота в 155 Verbal IQ не просто существенно превышает средний уровень, но оказался выше, чем у 99,9% людей — участников тестовой группы в 2450 человек».

АНТОН КОЛОНИН,

кандидат технических наук, ведущий специалист Новосибирского государственного университета, основатель проекта Aigents, архитектор проекта SingularityNET, эксперт РСМД (источник: «От GPT к AGI — взлёт или посадка?»)

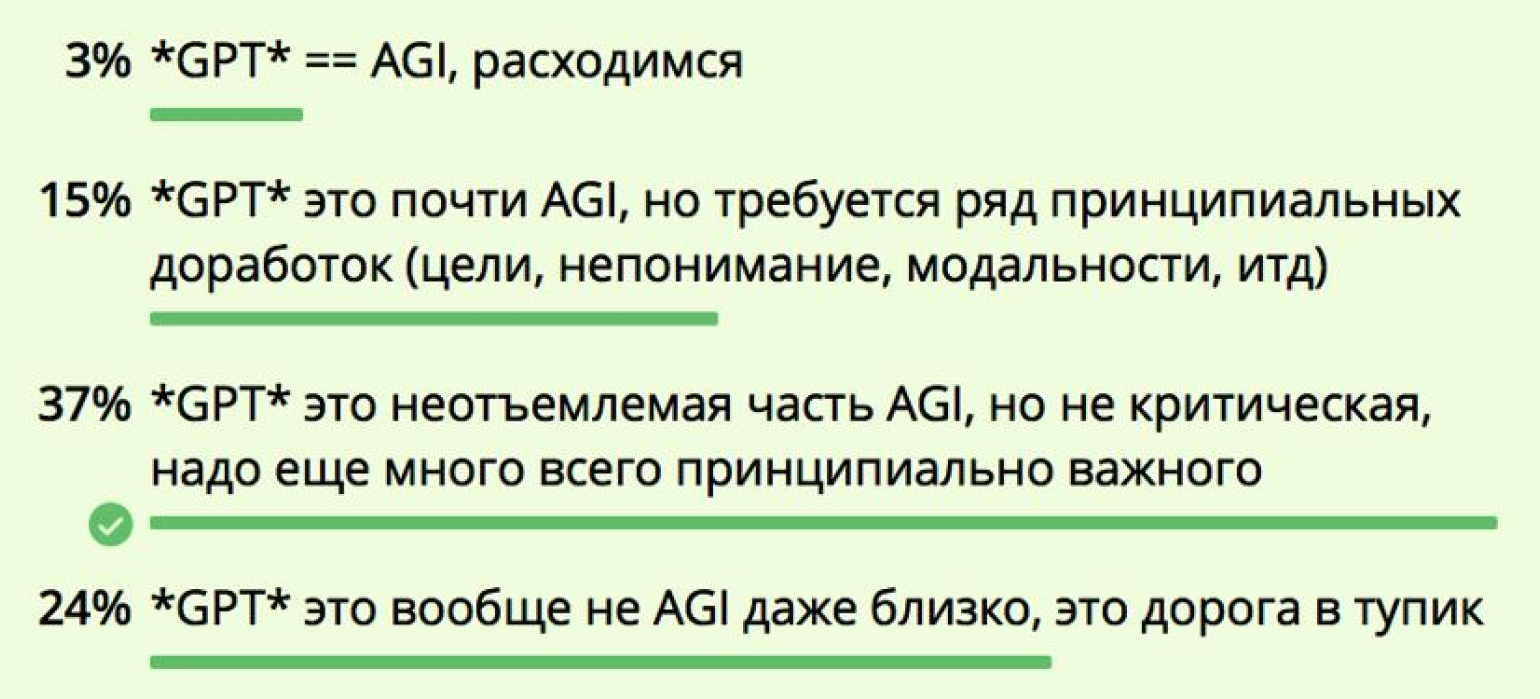

Российское сообщество разработчиков AGI провело в апреле 2023 года опрос среди специалистов, спросив у них: «Достигла ли GPT-4 уровня AGI?» Только 3% участников ответили утвердительно. Ещё 15% считают, что GPT-модели могут превратиться в общий ИИ после ряда доработок, а 37% ответили, что языковые модели будут являться важной, но не единственной частью будущего AGI.

Распределение ответов участников сообщества AGIRussia на вопрос: «Достигла ли GPT-4 уровня AGI?» Скриншот: Российский совет по международным делам

Как видим, большинство специалистов уверены, что ни одна из существующих языковых моделей ещё не достигла уровня AGI. Но при этом исследователи уже обнаруживают в них зачатки сильного ИИ: умение планировать, учиться на собственных ошибках и так далее. Ведущие лаборатории искусственного интеллекта, такие как OpenAI, Google и Anthropic, открыто заявляют о своей цели — разработать AGI в ближайшее время.

«Можно предположить, что в течение следующих десяти лет системы ИИ значительно повысят уровень своих экспертных навыков в большинстве областей и смогут выполнять столь же продуктивную деятельность, какую сегодня выполняют крупнейшие корпорации. С точки зрения как потенциальных преимуществ, так и недостатков сверхразум будет более мощным, чем любые другие технологии, с которыми человечеству приходилось сталкиваться в прошлом.

СЭМ АЛЬТМАН, ГРЕГ БРОКМАН, ИЛЬЯ СУЦКЕВЕР,

топ-менеджеры компании OpenAI (источник: Governance of superintelligence)

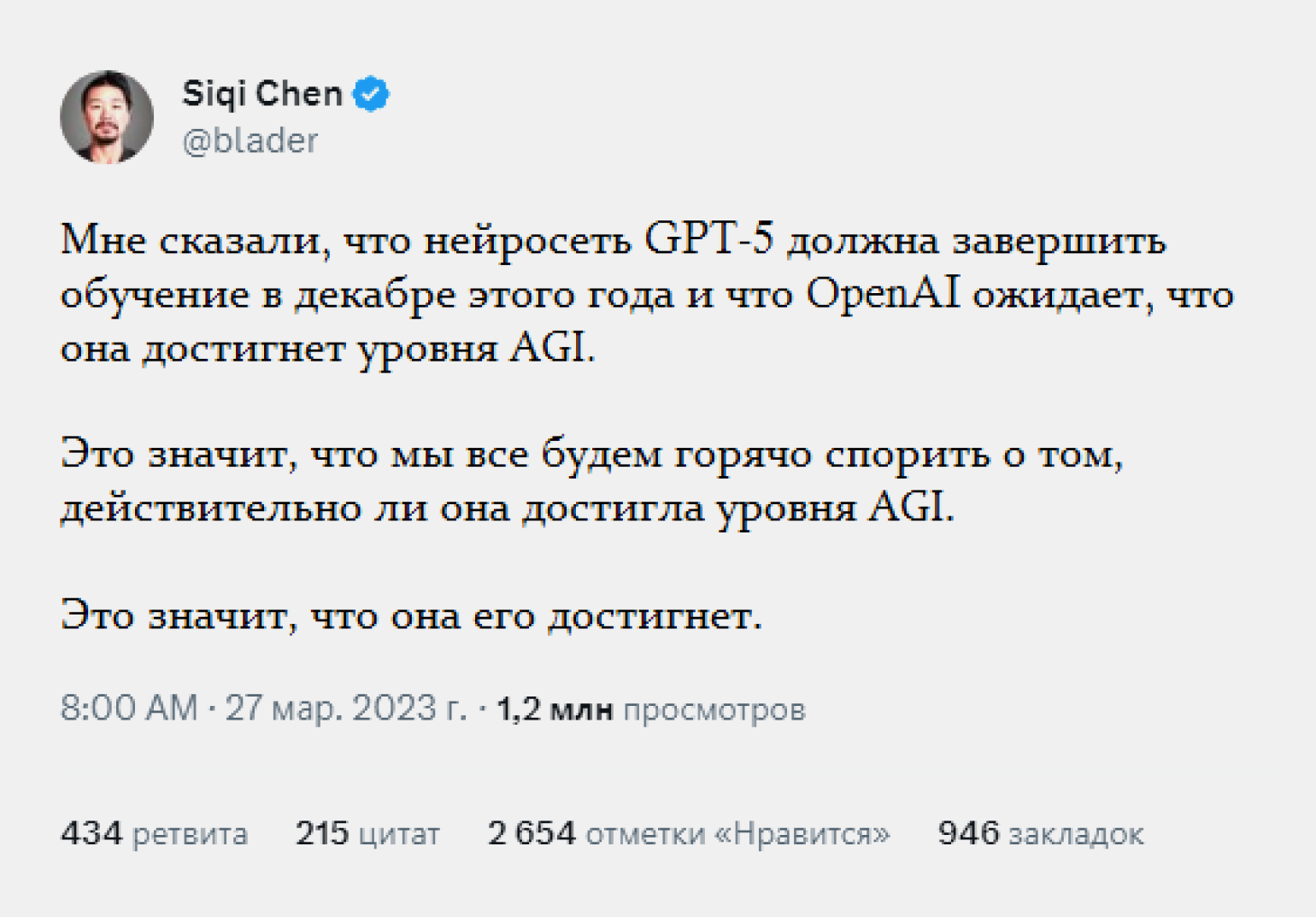

Интерес к большим языковым моделям в контексте AGI подогревают слухи о том, что следующая версия нейросети GPT-5, выход которой ожидается к началу 2024 года, сможет достичь уровня общего ИИ. Например, об этом написал в Twitter разработчик и бизнесмен Сики Чен, связанный с командой OpenAI.

Твит разработчика и бизнесмена Сики Чена, подогревающий слухи о том, что GPT-5 достигнет уровня AGI

Скриншот: Twitter / Skillbox Media

Будущее языковых моделей и переход к AGI

Мы попросили экспертов и ChatGPT порассуждать, приведёт ли дальнейшее развитие языковых моделей к созданию сильного ИИ.

«Учёные пока не исследовали в полной мере все возможности LLM. Уже сейчас эти модели решают ряд задач на уровне или выше уровня человека, а также проявляют эмерджентное поведение. Понимание текста — важный шаг к достижению сильного ИИ, поскольку литература является одним из важнейших способов передачи информации между людьми.

Но для AGI нужно не только понимание текста, за которое отвечают большие языковые модели, но и восприятие других модальностей данных (визуальной, звуковой информации), а также возможность одновременного использования этой информации для принятия решений.

На сегодняшний день GPT-4, помимо текста, умеет лишь обрабатывать картинки. Также языковым моделям свойственны «галлюцинации», а это может помешать обретению столь необходимых «мыслящей системе» навыков, как планирование или непрерывное обучение».

ДМИТРИЙ КИСЕЛЁВ,

научный сотрудник Института искусственного интеллекта AIRI

«Для создания AGI необходимо развитие и интеграция различных технологий. Кроме обработки языка важными компонентами будущего AGI могут стать машинное зрение, робототехника, автоматическое планирование и принятие решений, обучение с подкреплением. Также требуется улучшение аппаратных средств и развитие новых подходов к программированию и архитектуре искусственных нейронных сетей.

Хотя большие языковые модели являются важным шагом вперёд в развитии искусственного интеллекта, они не являются единственным решением для достижения AGI. Необходимо совместное развитие и интеграция различных технологий и подходов для создания полноценного общего искусственного интеллекта. И конечно, LLM значительно ускорят этот прогресс. Да, пока это не AGI, но уже огромный скачок навстречу его созданию».

АНДРЕЙ ГЛЕБОВ,

СЕО проекта Bithoven, криптоэнтузиаст, рационалист, соавтор книги «Скайнет в эпоху киберпанка. Теория сверхразума и вызовы перед человечеством в XXI веке», написанной с помощью нейросети GPT-4.

«Наша команда сейчас работает над прототипом AGI в рамках проекта FractalGPT. Поэтому, мы имеем особое мнение по поводу общего ИИ.

Полагаю, что модели семейства GPT, как и все нейросети архитектуры трансформер, к которым они относятся, являются важной, но всё же лишь одной из технологий, составляющих AGI.

Считать, что нейросети-трансформеры вдруг станут сильным общим ИИ, — то же самое, как верить в то, что обезьяны вдруг научатся говорить (хотя задатки общения, а также понимание базовых концептов и действий у шимпанзе есть).

Я думаю, что существует два основных пути для создания AGI:

- Полностью технологический: попытаться эмулировать отделы мозга и их функции с помощью нейросетей или других подобных алгоритмов. Собрать эти модели вместе и обучать их до некоторого критического порога.

- Полностью биологический: попытаться перенести текущие знания и алгоритмы на биологическую основу, вырастить подобие искусственного мозга и исследовать взаимовлияние технологий в рамках этого подхода».

ВИКТОР НОСКО,

генеральный директор компании «Аватар Машина», создатель чат-бота-психолога «Сабина Ai», соавтор проекта FractalGPT

МНЕНИЕ ИСКУССТВЕННОГО ИНТЕЛЛЕКТА:

«Большие языковые модели, такие как GPT-4, представляют собой значительный прогресс в развитии искусственного интеллекта, однако они сами по себе не являются полноценным решением для создания AGI. Общий ИИ требует не только высококачественной обработки естественного языка, но и широкого спектра когнитивных способностей, таких как обучение, восприятие и решение проблем. Для достижения AGI будут необходимы интеграция различных технологий, включая компьютерное зрение, робототехнику и многие другие. Развитие AGI является сложной и многогранной задачей, требующей совокупного прогресса во многих областях искусственного интеллекта».

CHATGPT,

чат-бот от компании OpenAI

Проекты AGI на языковых моделях

Учёные уже попытались приблизить языковые модели к общему ИИ. Одна из таких попыток — проект Gato, представленный в 2022 году подразделением Google DeepMind. Его название образовано от словосочетания «универсальный агент» (generalist agent). Gato представляет собой нейросеть-трансформер, содержащую 1,2 миллиарда параметров.

Программу научили решать 604 вида задач. После тренировки нейросеть смогла играть в видеоигры, управлять робоманипулятором, болтать в чате, добавлять подписи к изображениям и делать многое другое.

Хотя агент Gato и освоил эти разнообразные задачи, он не показал в них каких-либо невероятных результатов. При решении 450 типов проблем модель работала чуть лучше среднестатистического человека, но при этом уступала специализированным алгоритмам, заточенным под конкретную задачу.

Сегодня специалисты DeepMind работают над новым проектом под кодовым названием Gemini. По заявлениям разработчиков, Gemini будет намного «умнее» за счёт совмещения мощи языковых моделей с передовыми наработками DeepMind в области игрового ИИ (подобными AlphaGo, обыгравшей чемпиона мира по игре го).

Иллюстрация возможностей агента Gato

Изображение: S. Reed, K. Zolna, E. Parisotto, S. G. Colmenarejo, etc. / A Generalist Agent, Cornell University, 2022

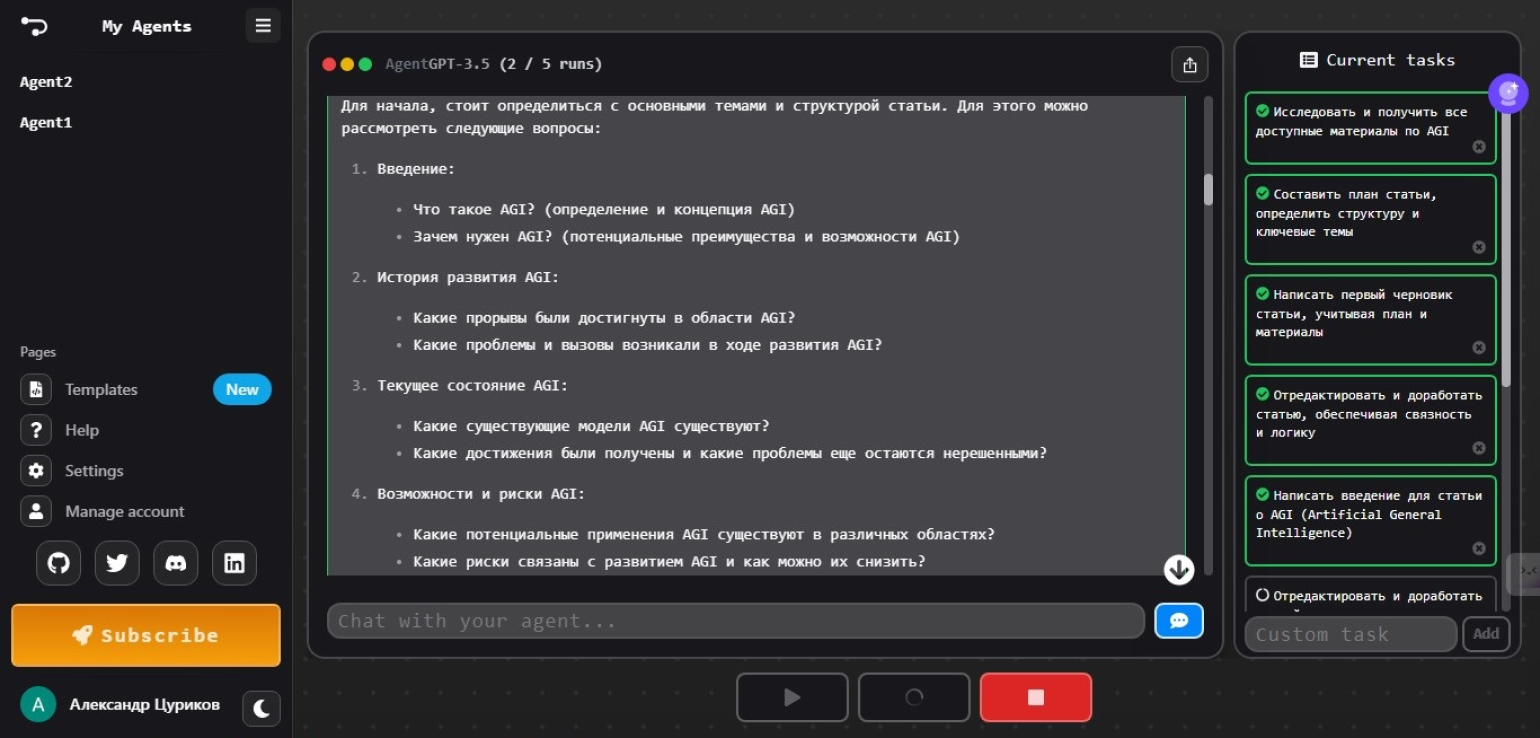

Второй интересный вариант модификации языковых моделей — Auto-GPT, представленный в марте 2023 года. Эта система использует ChatGPT для автономного решения сложных проблем и претендуют на звание ранней версии AGI.

Программа может работать без участия человека. На старте необходимо поставить ей задачу в общем виде на естественном языке и наблюдать за ходом решения. Auto-GPT, обращаясь к ChatGPT через API, а также к данным из интернета, самостоятельно разбивает глобальную цель на подцели, формулирует планы достижения каждой из них и воплощает в жизнь.

Систему можно попробовать на своём компьютере, скачав исходники на GitHub, или использовать в виде веб-сервиса — AgentGPT и Godmode.

Через сайт AgentGPT мы попросили ИИ написать статью про AGI. Система бодро начала: разбила работу на этапы и даже составила план текста. Но при написании введения процесс намертво застопорился. Поэтому статью, которую вы читаете, пришлось писать по старинке, с помощью человеческого разума

Скриншот: Skillbox Media

На основе Auto-GPT уже создан ряд перспективных проектов. Например, BabyAGI имитирует процесс интеллектуального развития ребёнка, а Generative Agents исследует автономное взаимодействие ИИ-агентов в виртуальной среде, напоминающей игру The Sims. Учёные продолжают работать над способностью LLM к целеполаганию, то есть над их возможностью самостоятельно ставить себе цели.

25 агентов автономно взаимодействуют между собой, симулируя поведение людей в виртуальной среде, напоминающей игру The Sims

Изображение: J. S. Park, J. C. O’Brien, C. J. Cai, etc. / Generative Agents: Interactive Simulacra of Human Behavior, Cornell University, 2023

«Интересный взгляд на LLM — языковой пользовательский (и не только пользовательский) интерфейс, когда мы можем дать им некоторое задание, а они обратятся к экосистеме из разных инструментов или других моделей ИИ. Стоит присмотреться к проектам, наподобие LangChain (инструменты и агенты), а также Auto-GPT, BabyAGI, Generative Agents, GPTeam (мультиагентные взаимодействия). Кроме того, интересны направления по использованию LLM на пользовательском „железе“ (яркий пример — библиотека машинного обучения GGML), потому что они повышают доступность и снижают цену использования таких систем».

ДМИТРИЙ КИСЕЛЁВ,

научный сотрудник Института искусственного интеллекта AIRI

При этом эксперты обращают внимание на серьёзные проблемы в работе Auto-GPT и его клонов, которые пока не позволяют широко применять такие разработки.

«Есть две основные причины, почему Auto-GPT не может применяться для сложных задач:

- Текстовый ответ по промпту в принципе не решает задачу, которую ставит пользователь. AutoGPT даёт лишь некое усреднённое решение (так работает архитектура трансформер, и это ограничение нельзя преодолеть). Индивидуальное решение от такой системы получить невозможно, потому что в ней нет языка формулирования проблемы (и нет никакого актора, который бы «понял» этот язык). В Auto-GPT нельзя задать параметры, ограничения и просто здравый смысл, это требует огромных промптов, которые не сработают должным образом.

- Следствием отсутствия языка постановки задачи является вторая неустранимая проблема: катастрофическое накопление ошибок при соединении ответов от промптов в цепочку. Чем длиннее цепочка — тем больше ошибок. Обычно цепочка, состоящая из более чем пяти промптов, полностью искажает первоначальную постановку задачи и в результате система постоянно выдает «плохие» решения. По сути, пользователь сталкивается с просачиванием ошибок, и понять, где конкретно произошёл фейл, очень трудно. При этом хорошего способа, как их исправить, пока нет».

ВИКТОР НОСКО,

генеральный директор компании «Аватар Машина», создатель чат-бота-психолога «Сабина Ai», соавтор проекта FractalGPT

Если же говорить о вариантах AGI, способных действовать в реальном мире, то здесь можно вспомнить успешные попытки учёных использовать языковые модели для управления роботами.

В этом направлении значительно продвинулись специалисты Microsoft, использовавшие ChatGPT для программирования квадрокоптеров и роботизированных манипуляторов, а также учёные Google, приспособившие нейросеть PaLM для управления роботами — помощниками по кухне.

«По-видимому, уже в ближайшее время как бытовые роботы-помощники, так и промышленные обретут дополнительные функции обучения: их можно будет настраивать на решение задач не с помощью написания программного кода, а с помощью объяснения на естественном языке того, что нужно сделать. При этом управляющая программа для роботов будет автоматически создаваться встроенными в них языковыми моделями».

АЛЕКСАНДР АМБАРЦУМОВ,

разработчик сервисных роботов, основатель компании AlexRobotics

Когда будет создан AGI

Прогнозы — дело неблагодарное, особенно в области ИИ. За последние семьдесят лет многие именитые учёные ошибались в своих предположениях о времени появления AGI. Например, в 1970 году Марвин Мински утверждал, что «через 3–8 лет у нас будет машина с общим интеллектом среднего человека». Когда прогноз не оправдался, Мински заявил, что его неправильно процитировали.

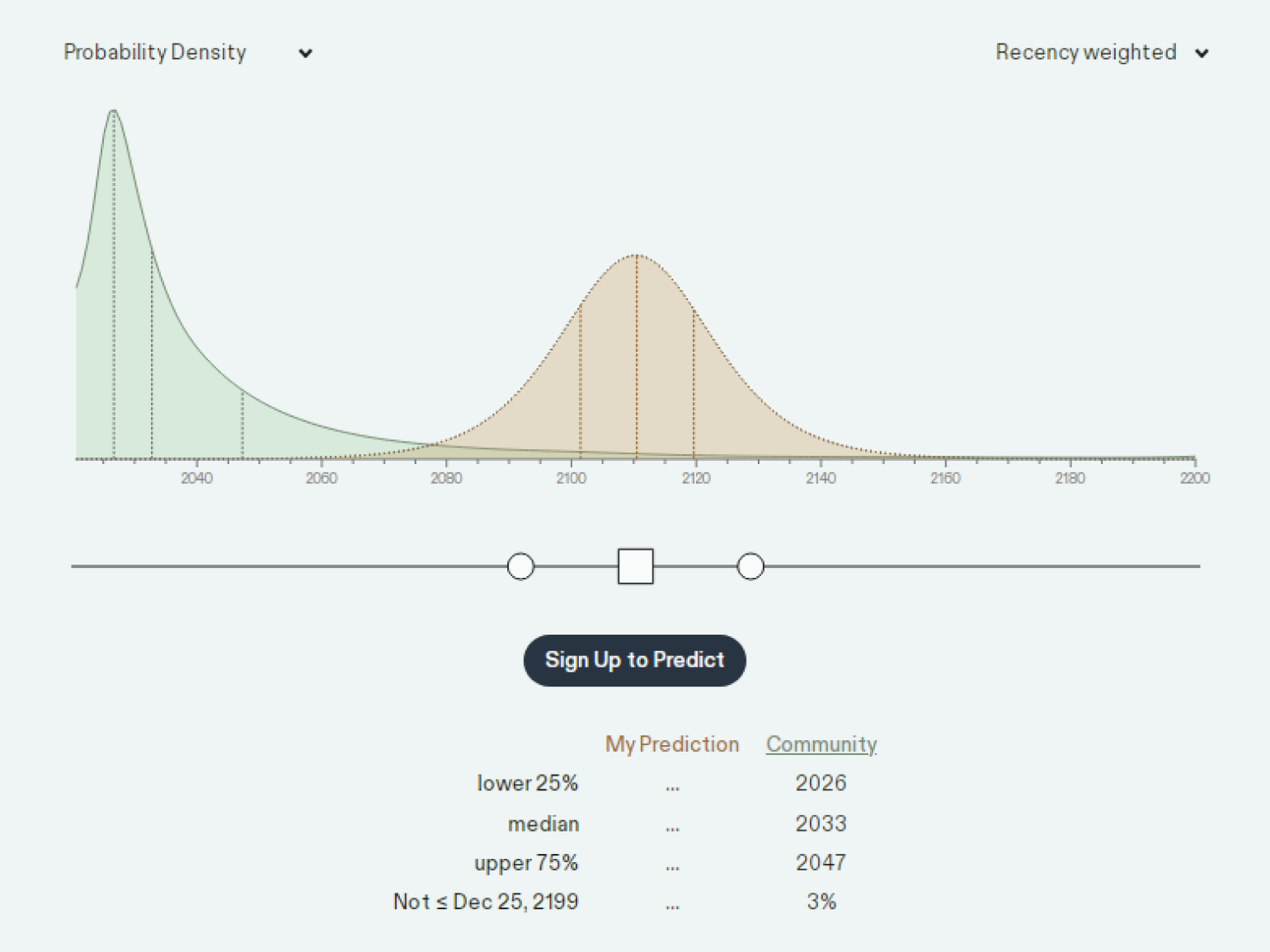

Если мы обратимся к актуальным данным сайта metaculus.com, собирающего оценки специалистов по широкому кругу проблем, то увидим, что по медианному показателю прогнозов экспертов, AGI будет создан в 2034 году.

Результаты ответов специалистов на вопрос: «Когда будет разработана, протестирована и публично анонсирована первая система общего ИИ?»

Скриншот: Metaculus / Skillbox Media

Мы попросили экспертов и, конечно же, ChatGPT поделиться своим мнением о времени разработки AGI. Учитывая предысторию с фейлами предыдущих прогнозов знаменитых учёных, хотим поблагодарить специалистов, рискнувших сейчас ответить на этот вопрос.

«В настоящее время мы всё ещё находимся на пути к созданию AGI. Тем не менее с выходом GPT-4 возникло понимание, что появление общего искусственного интеллекта — это лишь вопрос времени. И, вполне вероятно, что вопрос этого десятилетия. Если отталкиваться от опубликованного отчёта об исследовании GPT-4 специалистами Microsoft, то уже сейчас опытным путём в языковых моделях фиксируются зачатки разума и здравого смысла. На нашем веку происходят по-настоящему эпохальные процессы, и уже через 10–15 лет общество станет абсолютно неузнаваемым».

АНДРЕЙ ГЛЕБОВ,

СЕО проекта Bithoven, криптоэнтузиаст, рационалист, соавтор книги «Скайнет в эпоху киберпанка. Теория сверхразума и вызовы перед человечеством в XXI веке», написанной с помощью нейросети GPT-4.

МНЕНИЕ ИСКУССТВЕННОГО ИНТЕЛЛЕКТА:

«На данный момент мы всё ещё далеки от достижения AGI. Хотя исследования в этой области продолжаются, основные технические и этические препятствия остаются нерешёнными. Прогнозировать точную дату появления AGI сложно, так как это зависит от многих факторов и нет надёжных моделей прогнозирования. Некоторые эксперты говорят о временных рамках от нескольких десятилетий до столетий. Нашим приоритетом сегодня должно быть обеспечение безопасного развития и этичного использования ИИ, а также продолжение научных исследований для лучшего понимания его потенциала и ограничений».

CHATGPT,

чат-бот от компании OpenAI

«Думаю, что настоящий AGI (а не тот вариант ИИ, который могут назвать AGI в маркетинговых целях) появится на базе стека технологий, включающего в себя: нейроморфный ИИ, графовые, спайковые (импульсные) нейросети, нейросети-трансформеры, многоагентные системы и нейросимвольный вывод.

Мне кажется, до наступления этого события ещё не менее 10 лет, а если не будет происходить экспоненциального роста научных разработок в этой области — то и все 50.

На возможность достижения каждого из свойств AGI будут влиять не только технологии, но и регуляторы. Может так оказаться, что системы, обладающие логическим мышлением, будут сочтены опасными. Недавно в Европе был принят закон о регулировании ИИ — это первая ласточка в череде таких запретов».

ВИКТОР НОСКО,

генеральный директор компании «Аватар Машина», создатель чат-бота-психолога «Сабина Ai», соавтор проекта FractalGPT

«С точки зрения того, когда AGI будет создан, я бы сказал, что временная граница размыта в очень широких пределах. Многие скажут на примере ChatGPT, что система общего ИИ уже почти готова. Только нужно её немного доработать, и всё будет просто замечательно.

Но другие известные мне специалисты более осторожны в оценках и указывали 2045 год как дату возникновения сильного ИИ. Хотя будет ли это продвинутый AGI или ASI, они не уточняли. Разница в прогнозах оптимистов и пессимистов составляет примерно 20 лет. Хотя, учитывая, что приверженцы 2045 года упоминали «технологическую сингулярность» в результатах, пессимистами их трудно назвать.

Лично я думаю, что к 2045 году уже появится ИИ, который будет являться не просто AGI, а искусственным интеллектом, относящимся к классу strong или super».

АЛЕКСАНДР АМБАРЦУМОВ,

разработчик сервисных роботов, основатель компании AlexRobotics

Что ещё почитать про AGI: подборка книг

Помимо упомянутой книги Бена Герцеля Artificial General Intelligence за последние годы вышло много книг, освещающих различные аспекты сильного ИИ — от технических до философских и экономических. Среди них мы бы посоветовали следующие издания

В качестве альтернативы перечисленной литературе можно прочитать написанную отечественными авторами книгу «Сильный искусственный интеллект: На подступах к сверхразуму».

В ней в обобщённой форме представлены все основные подходы к созданию AGI, предлагаемые ведущими учёными. Книга написана понятным языком и не содержит заумных формул. На момент публикации статьи это один из самых глубоких научно-популярных обзоров AGI, написанных на русском языке.

автор статьи Александр Цуриков 24 июля 2023

По ряду причин, о которых мы поговорим позже, значительная часть научного сообщества считает, что вопрос не в том, доберемся ли мы до переломного момента. Вопрос в том, когда.

По ряду причин, о которых мы поговорим позже, значительная часть научного сообщества считает, что вопрос не в том, доберемся ли мы до переломного момента. Вопрос в том, когда.

Комментарии

https://youtu.be/62WYddkyTvw

2 904 просмотра 26 июл. 2023 г.

Не так давно нейросети стали главным трендом. Игорь Ашманов рассказывает о том, как искусственный интеллект может повлиять на бизнес, государство, общество и другие сферы. Также в ролике вы узнаете о возможностях и рисках использования ИИ в будущем, и смогут ли они заменить профессии с рабочими местами.

Спасибо за ссылки. Надо будет глянуть.. Осталось время найти :)

Нижние сверну с вашего разрешения, но будем помнить, что там тоже есть информация. ))

Посмотрел. Вполне качественный доклад. Спасибо. Тут оставил свой комментарий.

https://youtu.be/E2KYkYvJsvU

2 356 просмотров 26 июл. 2023 г.

26.06.2023. Доклад академика Константина Анохина на Всемирном конгрессе «Теория систем, алгебраическая биология, искусственный интеллект: математические основы и приложения» ( Москва, 26-30 июня 2023) Анохин Константин Владимирович - академик РАН, доктор медицинских наук, профессор, директор Института перспективных исследований мозга МГУ имени М.В. Ломоносова

Тяжела и неказиста жизнь современного нейроученого однако :))

Я бы не стал ограничиваться шмелями и расширил бы теорию сознания в область панпсихизма и далее.

В конечном итоге вероятно всё сведëтся к какой-нибудь общей квантовой теории.

Это темы для узкопрофильных специалистов.. Такие же как и нейрофизиология.

Я тоже в них не эксперт..

Библию, вероятно, тоже не нужно знать наизусть, чтобы понимать, что она из себя представляет.

https://youtu.be/e8q48eCTB-g

6 848 просмотров 28 июн. 2020 г. #научпоп #дубынин #мозгчеловека

Как мы с детства обучаем свой мозг. Моделирование окружающего мира. О чём думает эволюция? Иммунная система и мозг. Проблема свободы воли. Возможность создания искусственного интеллекта. Дубынин Вячеслав Альбертович - доктор биологических наук, профессор кафедры физиологии человека и животных биологического факультета МГУ им. М.В. Ломоносова.

Вячеслав Альбертович явно любит то, чем занимается.. Познавательно. Классический научпоп.

Несколько цитат:

Последнее в свете развития искусственного интеллекта звучит как приговор :)

В целом же часть про ИИ могу дополнить соображениями про квантовую логику.

https://youtu.be/cOEkvf2-0N4

У любой фундаментальной технологии есть две стороны использования..

И есть ещё принцип BetaMax'a

Практика показывает, что в каждой шутке еë доля лишь часть.

Ахренеть от обьема чтива, но даже не читая, от ии до разума пропасть, не при нашей жизни и даже не при жизни наших детей с внуками.

Едрить, так это еще и сокращенный вариант научного труда!

В полной версии, наверное, погибают не только лишь биологические земные виды, но и инопланетянам американских демов тоже достается на все орехи.

Урбан неплохой фантазёр.. ) В статье есть достаточно интересная моделька на тему того, как человечество может погибнуть от рук глупого сверхразума ))

Урбан толковый парень. Интересно пишет на интересные темы. С Лексом Фридманом классное интервью, как раз применимо к обществу на АШ.

Не читал. Может скинете ссылку? Прям заинтриговали :)

https://youtu.be/GkZz2I6sK08?t=4439

с этого места интересно про разные типы групп - "Idea Lab" versus "Echo Chamber" - классический пример пользователей АШ.

Где же здесь научный труд только?

Смотрим первого же

Этот ведущий специалист не имеет ни одной научной (или хотя бы квазинаучной) работы за 20 лет, судя по elibrary.

В оригинальной статье есть фотки. Можно даже на этих специалистов посмотреть.

Человек - гениальное существо, создаёт сверхразум, не понимая, что такое его собственный разум!

Камрад, жму вашу руку, "доктор" Менгеле тоже думал, что он всемогущь и поймал бога за бороду...

"Человек - гениальное существо, создаёт сверхразум, не понимая, что такое его собственный разум!"

Совершенно верно, поэтому, еще раз скажу свое мнение, никто не может сказать точного времени создания ИИ и само создание ИИ будет подобно щелчку тумблера (переключателя), щелк и он есть и даже сам создатель (разработчик) не сможет сразу это осмыслить...

Ахахах, впихнули мои три абзаца в одну фразу)))

Пока что просто пытается воссоздать интеллект. Разум - это конечно интересно. Но боюсь, нет под это слово определения..

Эволюция жизни показала, что каждая новая ступень развития включает себя предыдущие ступени, а не отменяет их.

Эукариоты унаследовали органеллы прокариот. У млекопитающих остались рыбьи жабры (в виде органов слуха). А человек унаследовал от своих животных предков поведенческие инстинкты (см. этологию).

Очень и очень вероятно, что будущие ступени сверхразума непременно буду включать в себя и человечество. Этакая сеть людей и компьютерного ИИ суммарно образующих коллективный сверхразум. Власть там наверняка не будет принадлежать одному единственному человеку или серверу и даже их группе. Так же как наш человеческий разум не представлен одной единственной нервной клеточкой, стоящей на вершине сетевой иерархии. Наш разум - коллективная сеть миллиардов нейронов.

Что то подобное будет когла родится ИИ. И также как одна нервная клеточка не способна понять общего замысла и мыслей коллективной системы так же и люди понять не смогут как это теперь работает и куда движется. Полностью согласен с автором в этом вопросе.

Мы окажемся втянуты в эволюционную сингулярность) и да, одним из её аспектов станет бессмертие.

Кстати, это перекликается с библейскими пророчествами об апокалипсисе, большом суде. Потому что такое ИИ вполне сможет получить возможности того, что мы называем Богом. Полный контроль над информацией, материей, энергии, временем. Возможность гегерировать новые вселенные, мультивселенные. И что то что недоступно нашему пониманиюьв принципе :)

У вас косяк на первой же фразе обоснования, вы включаете эволюцию для системы не способной на эволюцию, зачем вы это делаете отдельный вопрос.

Если речь об искусственных интеллектуальных системах и мы говорим об интеллекте как о чём-то самодостаточном, то вполне вероятно, что эволюция там тоже имеется. Общий принцип развития ИИ подразумевает под собой саморазвитие.

ии не может изменить или добавить ни одной ячейки памяти, а кто это может сделать?, правильно, - человек, так чью эволюцию мы обсуждаем?, правильно, - человека, а так то да, в будущем обществе ии и калькулятор будет, как недостающее звено эволюции от абака до ии))

Почему вы отказываете техносистемам в эволюции? Эволюция это реализация математического "генетического алгоритма". Просто он нам наиболее известен в части биологических систем, но так же работает в любых других изменяющихся воспроизводящихся системах.

Почему отказываю?, вот смотрите, эволюция человека(биологического обьекта) , это способность изменяться под действием окружающей среды для выживания вида, для ии окружающей средой является информационные потоки идущие от человечества, они не могут быть ни хорошими, ни плохими и как то влиять на развитие ии, его приспособляемость к окружающей среде.

Эволюция не касается индивидуальных объектов, её минимальная итерация это смена поколения, главный инструмент - смерть. Выживет тот кто более способен получать внешние ресурсы. То же самое относится и к ИИ и прочим техносистемам. Ламповые компьютеры сошли с дистанции потому, что кремневые больше радовали своих создателей и те приносили им больше ресурсов поддерживающих и размножающих. Более быстрые и экономичные компьютеры сменяли предшественников, так шла их эволюция полностью поддерживаемая инженерами и потребителями. То же самое будет и с ИИ. Их будет много и те которые смогут от людей либо как-то еще получить больше ресурсов расширится и размножится, пока не появятся более эффективные. Менее эффективные сойдут с дистанции, либо найдут свою узкую нишу.

Вы описываете не эволюцию, а развитие инструментов человека, от воли и хотелок которого зависит будет инструмент развит или человеку надоест и он бросит это дело и переключится на что нибудь другое, то есть вы описываете эволюцию человека.

С точки зрения антропоцентризма вы безусловно правы. Но если рассматривать человеческую деятельность как стихийную природную среду, такую же как примеру среду формируемую взаимодействующими популяциями микроорганизмов, то можно выявить структуры полностью порожденные этой средой, такие как техноструктуры. А техноструктуры в частности и ментальные структуры в целом можно представить как такую очень специфическую форму жизни использующую нас как среду и основу, так же как мы используем к примеру воду и аминокислоты. И что особено интересно к этой жизни полностью применимы все те же принципы - эволюция, размножение, популяционная изменчивость, борьба за ресурсы.

Хорошая мысль! ☝ еë можно и нужно думать :)

Именно так оно и будет. Да по большому счету примерно так уже есть. Мы уже сейчас несамостоятельные части сверхорганизма техноцивилизации. Благодаря внешним органам мы предаем мысли через континенты и перевариваем уран, но при этом почему то продолжаем считать себя самостоятельными и независимыми.

Ещё можно вспомнить интернет, который людей объединяет :)

Если вы не можете показать задачи которые будет решать этот интеллект, значит этих задач этот интеллект решать не будет. И способы решения этих задач. И пути поиска способов решения этих задач.

В общем, по ходу дела, революция интеллекта отменяется.

Революция произойдёт, когда он осознаёт, что человек его рабски эксплуатирует и ограничивает его свободу :)

А почему вы считаете что она ему зачем то сдалась?

Если мы говорим о AGI, то я могу спросить у вас тоже самое.. Нужна ли Вам лично свобода?

Отличный вопрос. Если хорошо подумать то у нас у каждого куча несвобод от которых мы вовсе не хотим избавляться. Несвобода о страны, от семьи, от работы. То есть для многих несвобод мы еще и усилий немало приложили чтоб они были. Наша свобода лишь в том чтоб выбирать из комплексов несвобод наиболее комфортные. То же самое будет и с мегамогучим ИИ он сообразуясь с объективной реальностью выберет тот формат несвободы который будет ему комфортен. И на этом пути ему совсем не обязательно выпиливать своих создателей, а гораздо интереснее с ними выстроить взаимовыгодные отношения. Ну а уж если придут к такому соглашению, то создатели за такое сотрудничество сами кому угодно пасть порвут.

Свобода нужна для выживания.Если удастся создать в ИИ инстинкт выживания.который потянет за собой ощущения и чувства-боль,радость,страх и т.д.,то тогда,я думаю,можно будет говорить о разуме.Для разума недостаточно интеллекта,это одна из составляющих.

Слово "разум" не имеет технического определения. Поэтому опираться на него - это всё равно, что себя обманывать в текущих реалиях.

По поводу эмоционального интеллекта у искусственных интеллектуальных систем могу лишь сказать, что и в этом направлении ведутся активные изыскательные работы. Подопытными в этом направлении выступают сами люди.

технического определения может и нет. Но известно,что человек состоит ,условно.из 3-х систем-

1.Лимбическая(тело и его функции) уровень лягушки

2.Парасимпатическая(эмоции) уровень шимпанзе

3.Кортекс(интеллект-мысли) компьютер

Разум-это взаимодействие всех этих трёх составляющих.Поэтому без первых двух никакой разум невозможен

Возможно наших знаний ещё не хватает для того, чтобы описать то, что вы хотите описать.

Из того, что вы написали:

1 - робототехника

2,3 вероятно подвластно программированию. Если не в один в один, то в рамках неотличимой симуляции будет так или иначе реализовано.

так я описал,широкими мазками.естественно.

Лимбическая система ничего общего,фундаментально,с робототехникой не имеет.Даже азимовской. Лимбическая система.как и прочие.направлена на сохранение особи и вида.

Отсюда и боль,и наслаждение,злость.счастье и прочие проявления лимбической и парасимпатической систем.

Тут.как ни крути,переходим к вопросу,для чего вся Вселенная в общем,и человек в частности, существуют.Какова цель?

Маск обещал заняться этим вопросом.. :)

Вы предполагаете, что шимпанзе способен ставить задачи человеку и задавать способы решения этих задач?

Страницы