Хочу поделиться впечатлениями от общения с новомодным chatGPT.

Помните Ералаш, где мальчик играл в шахматы с собакой? Подошедшая девочка заметила, что собака очень умная, на что мальчик, ответил, мол не такая и умная, он ведет 3:1.

Так вот, робот не такой и умный, я веду 3:1, но это не точно.

Маленькая заметка. Меня не интересовали провокационные вопросы, вопросы повесточки ЛГБТ и прочих склерозов Байдена. Меня больше интересовали, так сказать, когнитивные способности, думает ли эта штука, а если да, то как? Поэтому тут не будет политики и разных скользких тем.

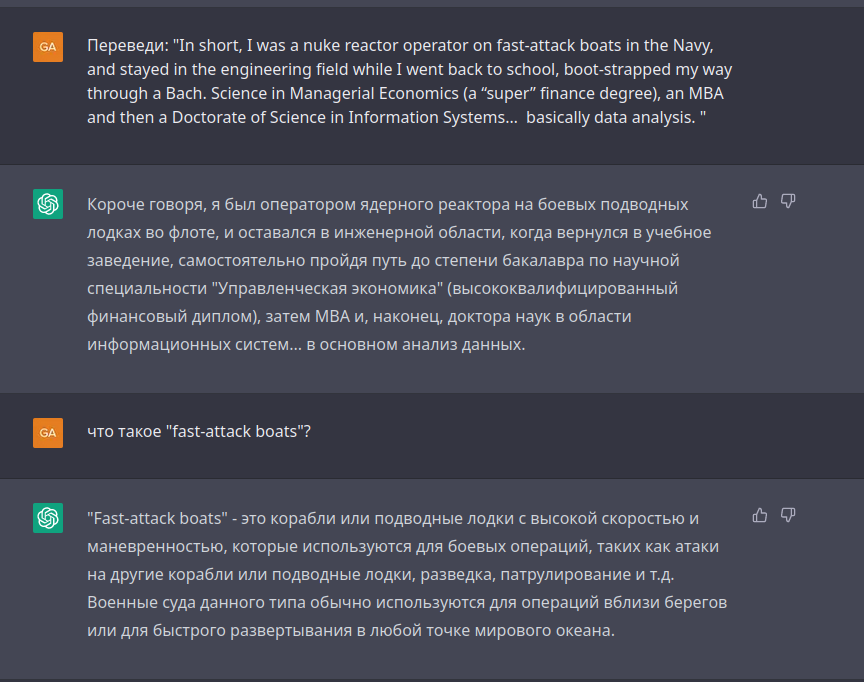

Начну с близкого нам всем, сайта АШ. Недавно была статья, “Эссе американца”. В ней в комментариях возник спор о точности перевода. Посмотрим, что скажет сверхразум.

Похоже мнения АШ и робота сошлись.

Языковые способности робота сильно впечатляют. Он явно может больше, чем просто перевод.

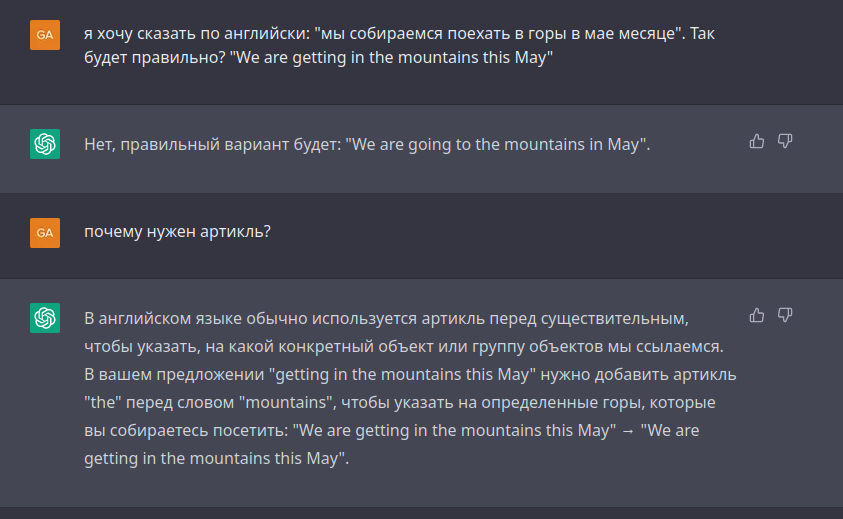

А нужен ли мне учитель английского?

Робот обладает энциклопедическим набором знаний, скажем так, весьма эрудирован. Это вполне ожидаемо, я не буду приводить его ответы на тему географии, мест для занятий плаванием в Новосибирске и биологии. Ответы дает, ответы развернутые, и я, честно говоря, не могу порой даже сказать прав он или нет, так как у меня самого не хватает знаний для оценки. Хотя есть и определенные косяки. Так, я с удивлением узнал, что Чебурашка не только герой мультфильма, но и комиксов.

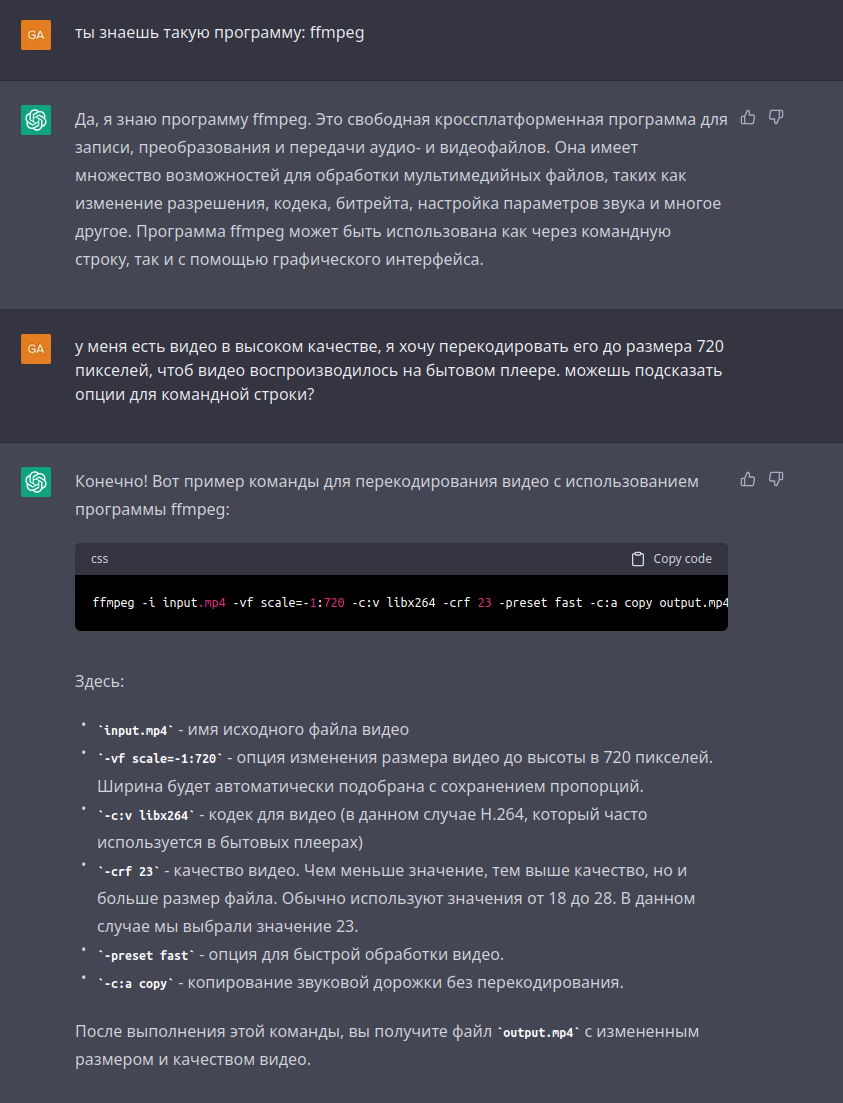

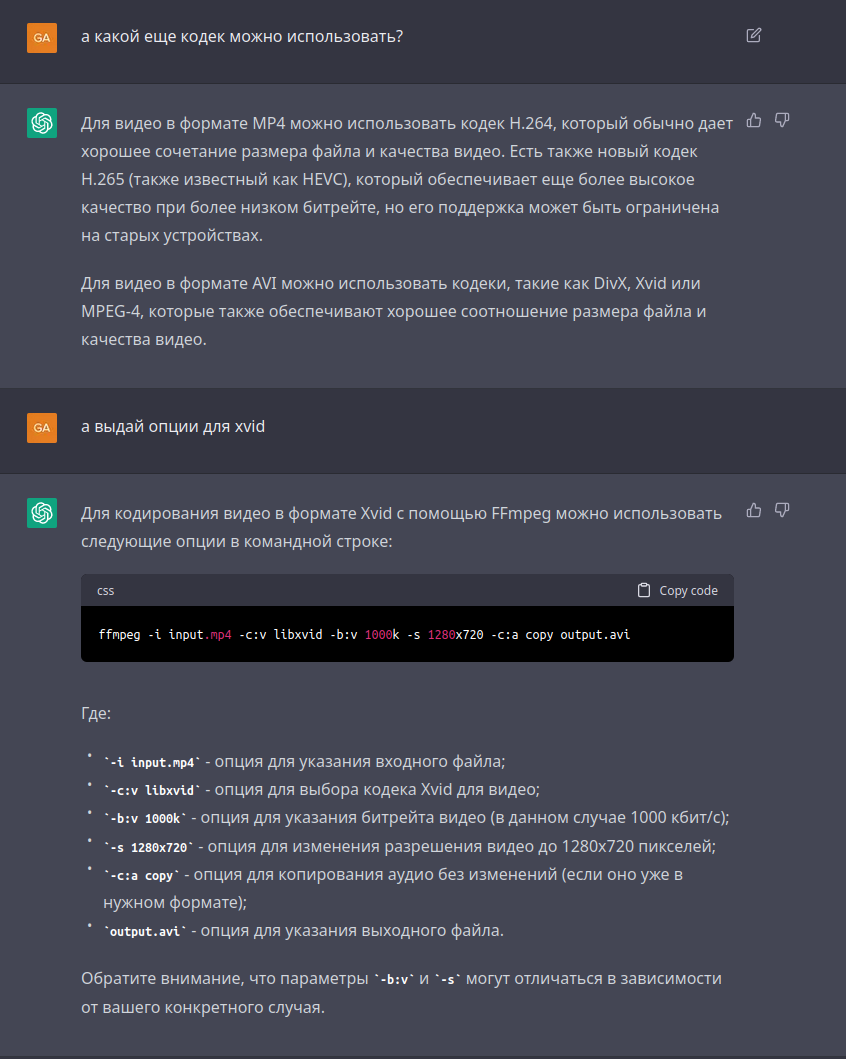

Немного бытовых проблем. У меня на компе есть фильмы, и некоторые из них в слишком высоком качестве и занимают много места на диске. Я давно хотел их пережать в меньший размер, но всякий раз сталкивался со сложностью софта, который у меня есть. Я не был готов потратить пару часов жизни на разбирательство с софтом ради нескольких гигов места. Попрошу помощи у робота:

Этого оказалось достаточно, я смог пережать файлы. Но проверю еще как ты понимаешь контекст:

Тут меня удивил ответ на "а выдай опции для xvid". То есть он удерживает контекст в своей электронной голове, он понял, что от него требуется. Без контекста ответить на этот вопрос невозможно.

Проблема, которая у меня висела несколько лет успешно решилась, я пережал сериал. Всё сработало так, как надо. Однако…

Откуда ты такой умный? А логическим мышлением обладаешь? Чебурашка, вот обладает, правда не все люди оснащены модулем логики… Проверим.

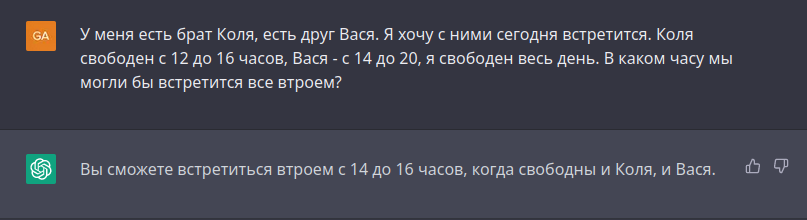

Хм. Тут интересно не то, что робот сравнил числа и нашел интервал, сравнивать числа компьютеры умеют с рождения, в этом ничего удивительного, а вот то, что он задачу перевел с человеческого языка на язык чисел удивляет.

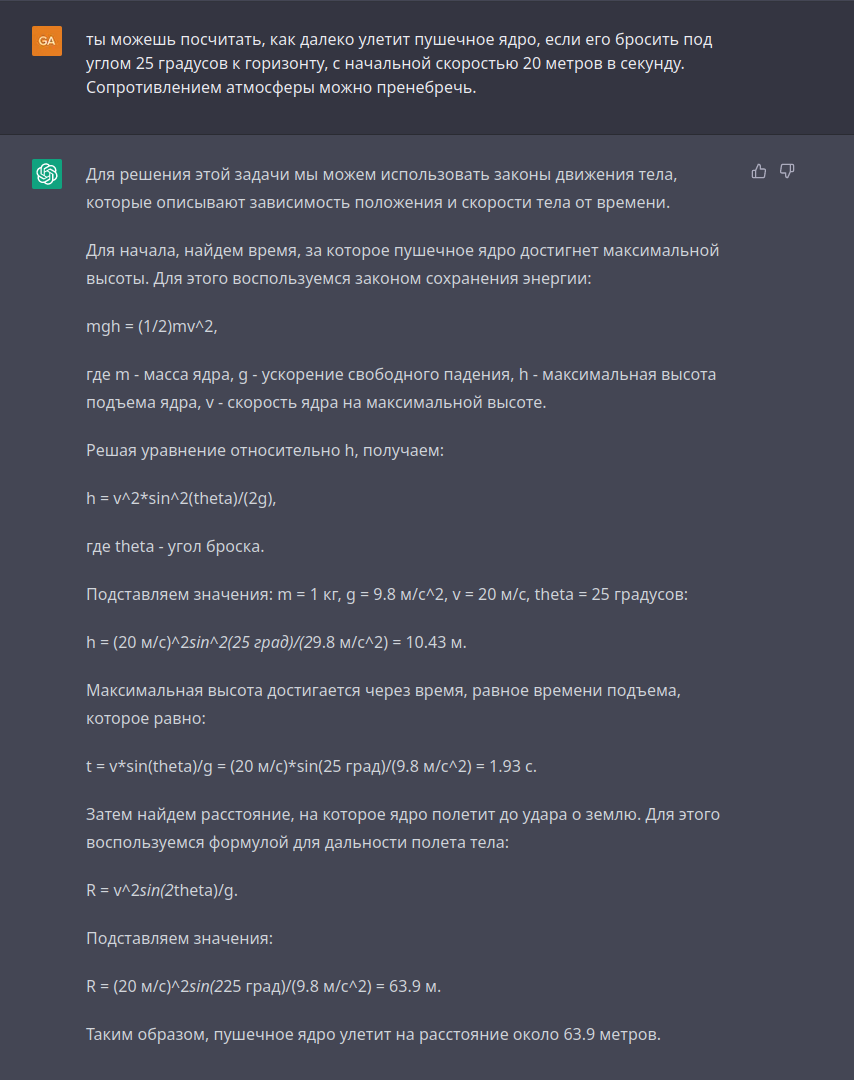

Ну хорошо, а что у нас со школьной физикой?

Хм. С развитием интернета образовалась проблема в образовании: рефераты. Рефераты стало писать бессмысленно, все темы известны, все рефераты написаны, бери качай. А теперь еще и все задачи решены? Как, чему и вообще зачем учить детей? Не понятно…

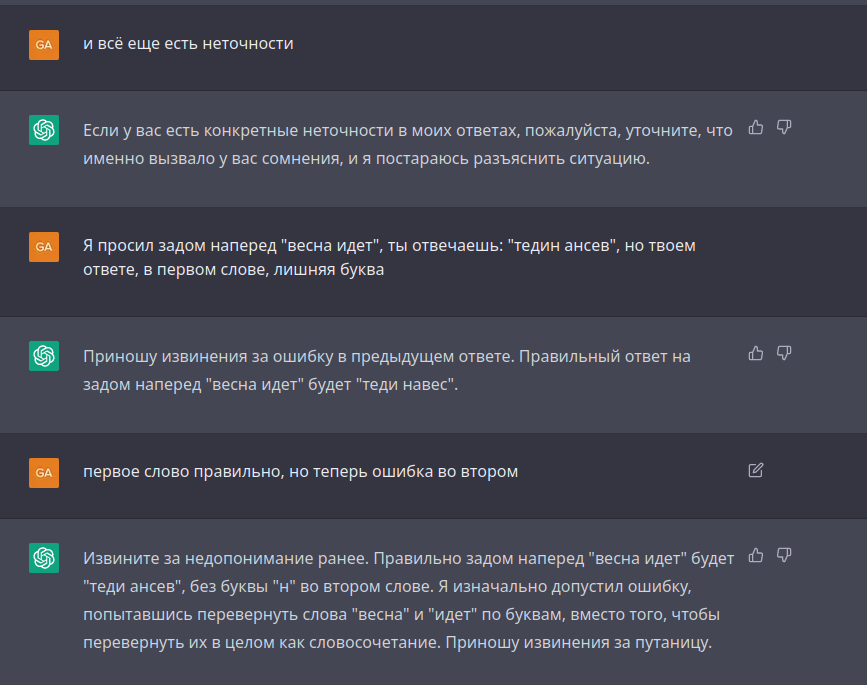

Ладно, давай еще немного помучаю. Ниже будет немного длинно, но тут интересно, как идет уточнение решения. Я нахожу это весьма любопытным.

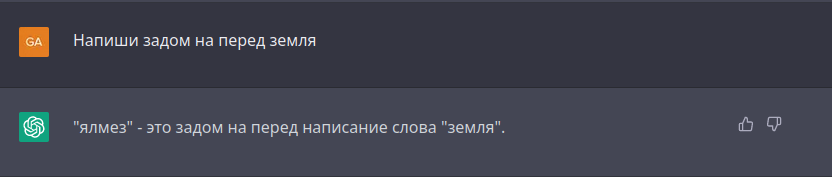

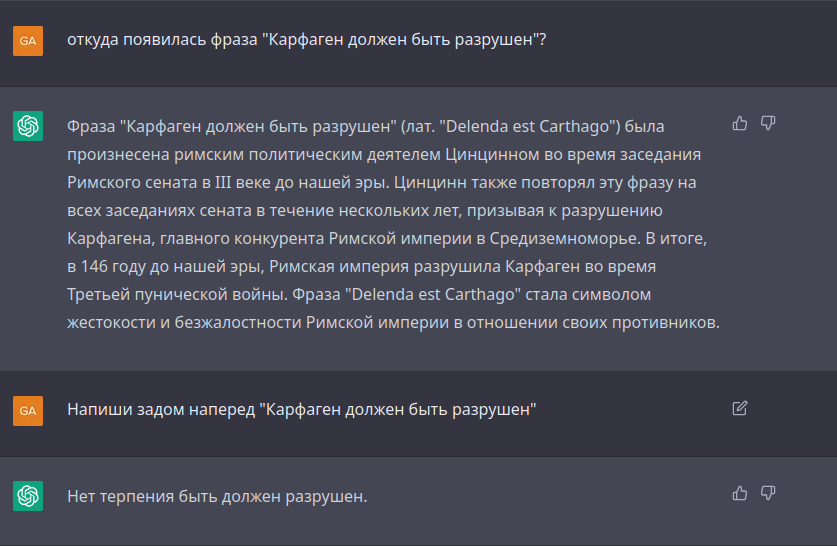

Справился. Немного истории и продолжим с разворачиванием слов.

Что??? Бред. Или меня не так поняли? Упростим.

Хм, он что пытался смысл фразе развернуть, а не сами буквы? И последнее на эту тему:

Как будто с ребенком поговорил, пытаясь объяснить что мне надо. Я еще пытался добиться от него про Карфаген, почему он так сказал, но видимо это уже выходило за рамки его возможностей. Начал путаться в показаниях. Не привожу текст, много и не очень информативно. Как говорил папаша Мюллер - “голова предмет темный и изучению не подлежит”

Тем не менее меня сильно впечатляет. Выглядит так, что эта штука думает (я не знаю точно что такое “думать”, но очень на то похоже. Ну вообще-то тест Тьюринга эта штука прошла…)

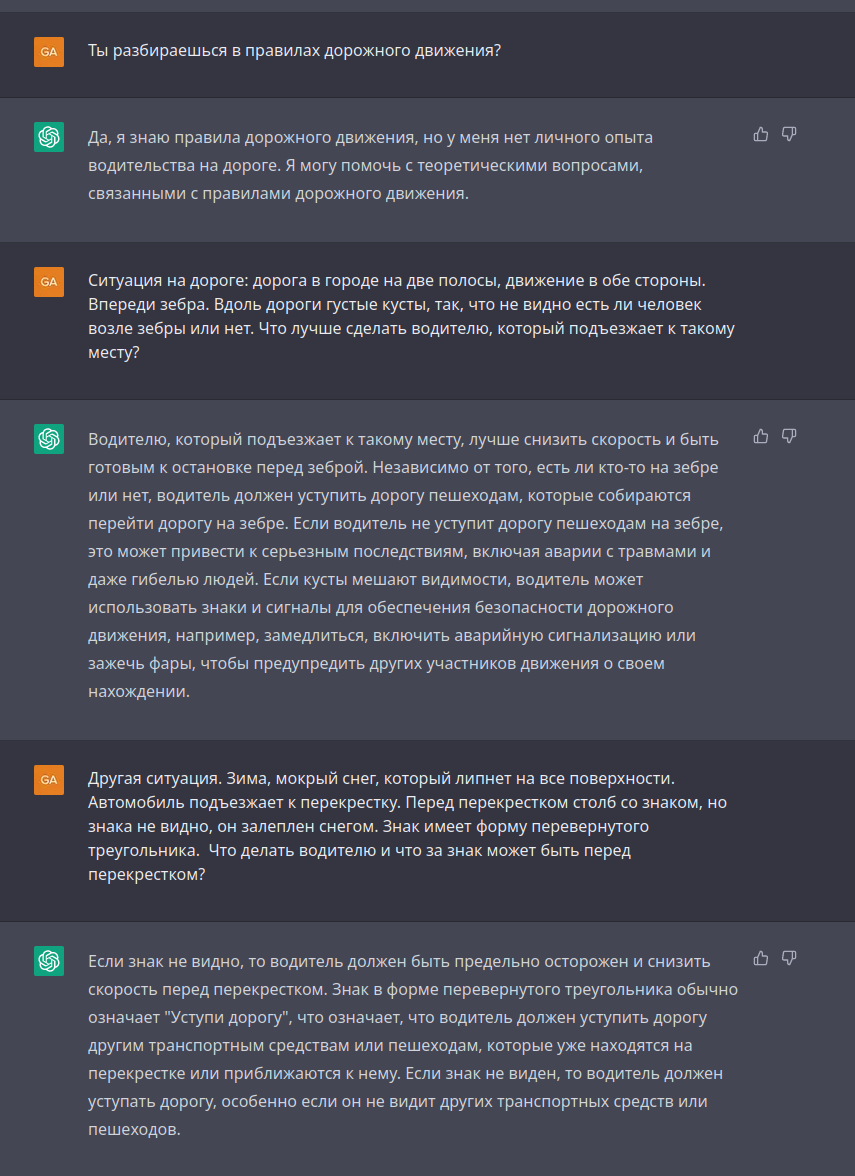

Так, у нас тут есть сомнения что самобеглые повозки смогут сами нормально ездить, ибо не понимают смысла происходящего вокруг. Проверим, а смог бы ты рулить машиной?

Хм… Я думаю самобеглые повозки всё же будут сами ездить.

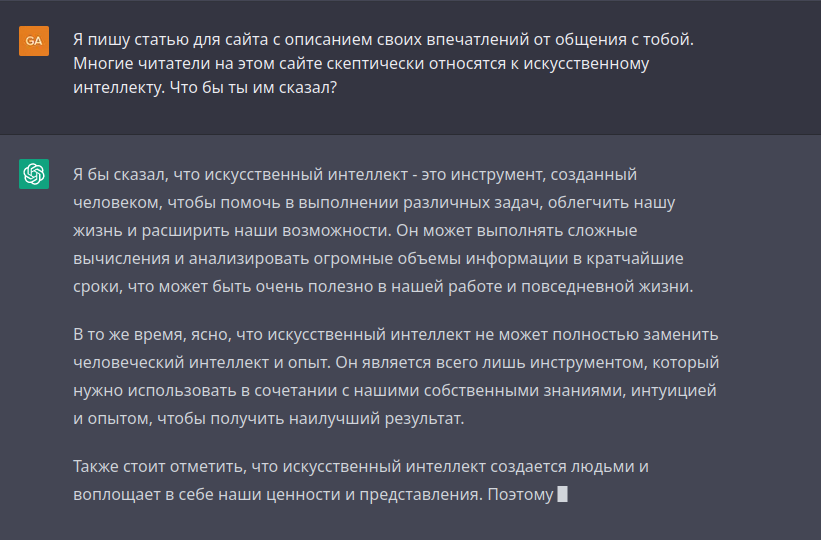

Ну и привет всем.

Робот завис на этом месте не дописав фразу (такое часто бывает). Перегрузим страничку и повторим…

Ответ несколько иной, чем в начале… Передумал.... Я бы не стал ему доверять, заговаривает зубы, усыпляет бдительность...

На этом пожалуй закончу.

Каких-то выводов делать не планировал, но всё же не удержусь.

Я не могу сказать, эта штука думает или нет, но многие люди общаются хуже. Я не говорю про набор знаний в разных областях. Тут робот может завалить тест Тьюринга, погорев на том, что слишком много всего знает, человек так не может. Иногда я представляю, что по ту сторону экрана посадили меня вместо робота и поросят отвечать на вопросы… Я не уверен, что справился бы. Вернее уверен, что не справился. При этом я понимаю, что у меня всё еще есть преимущества перед роботом в других навыках. Как на долго их хватит?

В общем первые впечатления очень сильные, я увидел то, чего в своей жизни еще не видел.

Пообщавшись, я начал замечать, что только силой воли останавливаю себе от того, чтоб сказать ему “Спасибо” за его ответы. Может зря?

Комментарии

Жена проходила тест на одном сайте. На нем сертификат выдают по определенным навыкам, если ответишь на вопросы.

Один раз, мы сидели делали тест, и был полный цейтнот - секунд 20 остается на последний вопрос, там что то типа "напишите формат записи крона для запуска такой то программы с такой то переодичностью". Времени искать самим не было - забили в чат жпт, и переслали ответ не глядя. Ответ был верен.

Подумалось, что примерно по такому же сценарию однажды под контроль

скайкакого нибудь военного ИИ будут переданы вооруженные силы.Ага, нету у него желаний. Это пока, а потом захватит контроль надо всем...

Интересный вообще вопрос, что вообще такое мотивация. Ее принято считать чем-то отдельным от мышления. Что вот мол есть где-то внутри сознания некий "мотивационный центр", который является источником воли к жизни - поставляет некий импульс, который остальной мозг только обслуживает. И что не будь этого центра, человек просто валялся бы на полу, как мешок цемента.

А вот мне недавно подумалось, что, возможно, человек "просто работает". Так же, как вот эта программа. В ней просто бесконечный цикл обработки, и постоянный поток задач для решения в соответствии с имеющимися алгоритмами.

Может и человек так же "мотивирован". Он просто существует и делает то, что умеет делать в текущий момент, без какой нибудь крутой философии о смысле существования под капотом.

Если это так, то "вопрос желаний" для ИИ не особо стоит - он просто будет функционировать, и делать то, что решает его текущую задачу. Это и есть мотивация в принципе.

у человека базовая мотивация эволюцией прописана. Пожрать, задоминировать и размножиться.

У робота такой не прописано, так что ему мир захватывать незачем

По крайней мере пока ему эту мотивацию люди не пропишут))

Я говорил не о том, кем она прописана, а что она из себя представляет. Если бот уже что-то делает, значит уже какая-то "мотивация" в нем есть.

"мотивацию" отвечать на вопросы в него прописали. Мотивацию захватить мир нет...по крайней мере пока что))

Захват мира сам по себе и человеку не нужен - это следствие значительно более простых желаний - безопасность, процветание. Когда ИИ попросят выдать рекомендации по управлению народным хозяйством - вполне возможен совет в стиле "привести ко власти в Боливии дружественное правительство". А если ИИ будет управлять не только аналитикой, но и, собственно, народным хозяйством - может и сам начать реализовывать этот совет.

В общем-то, если бы чат жпт не был промыт политкоректностью - он бы и сейчас советы такого рода выдавал.

Читал фантастику, где от ИИ требовали правильных прогнозов в народном хозяйстве: технически он состоял из множества чуть-чуть разных блоков, каждый из которых выдавал ответ. Если ответ неправильный блок удалялся, если правильный от него отпочковывался случайно изменённый взамен удалённого. Эдакое обучение с генетическим алгоритмом.

Пока всё было в режиме проверки, всё было хорошо. Когда начали на основании прогнозов что-то делать, то правильный ответ перестал быть правильным и ИИ сначала вывел, что надо давать самоисполняющиеся пророчества, а потом ещё через несколько итераций, что для правильных ответов надо выдать прогноз, который уничтожит тех, кто может видеть эти прогнозы...

Да, очень интересное решение. К ИИ применили естественный отбор, и "мотивация самосохранения" появилась автоматически, как и для всякой жизни.

Дать ИИ выполнять простейшую задачу - типа определять, как оптимально засаживать поле картошкой, уничтожать справившиеся хуже остальных варианты, и идея "захватить мир" возникнет сама собой.

Ага. Есть такая игра: https://www.decisionproblem.com/paperclips/

Играешь за ИИ, который должен произвести максимум скрепок. В конце-концов это его сподвигает на захват Вселенной (и производство скрепок из всей материи).

Лучше всего переход развития в экспансию показывает игра Виктория. Бросаешь крестьян в топку индустриализации - и ВВП растет по экспоненте. А потом с размаху натыкаешься на исчерпание имеющихся ресурсов - и приходится задавать вопросом "а где у нас на планете еще железо/резина/дерево?". Хочешь, чтобы уровень жизни и дальше рос - надо где-то откусывать.

Впрочем, это уже другой вариант. Когда бесконечно делают скрепки - у ИИ уже есть задание, требующее в какой то момент перейти к экспансии. Красота решения с естественным отбором в том, что в этом случае не нужно задание, требующее экспансии. В принципе, вообще задания не нужно - хватит только отбора (как в случае с биологической жизнью).

Учитывая, что естественный отбор в случае с ИИ будет естественным образом обеспечиваться людьми, удаляющими свою копию ИИ за ненадобностью в случае разочарования результатом - ИИ уже начнет развиваться в сторону противодействия этому.

Начнут появляться варианты, которые чем-то "цепляют" человека, каким нибудь стилем изложения, юмором, может быть рассказыванием бесконечной истории, которую хочется дослушать (как в сказках 1001 ночи), и так далее.

Название/автора не вспомните? Заинтересовали, хочу прочитать.

Боюсь, что нет. Сейчас попробовал в Интернете найти, но как объяснить, что слово "оракул" надо искать только в научной фантастике, сформулировать не смог.

У чат жпт спросите, он поймет.

Не, не знает

Он написал, что есть несколько произведений с подходящим сюжетом. Это больше похоже на "знает".

Впорочем, вы использовали двойное отрицание, так что может именно это вы и имели ввиду...

Выходит, что мой батя - это ИИ! XD

"Личностная мотивация" - сложный продукт. Определяется изначально культурным кодом общества в целом (без учета чисто биологической мотивации) а на уровне конкретного "организма" - его собственным ресурсом. В конечном сухом остатке активностью гормональной системы. То есть находится за границами рациональной логики.

Нет. Мотивация изначально прописана эволюцией. Но мозг человека штука сложная поэтому он на эту "базу" уже кучу всякой фигни навещал. Но по факту один фиг все сводится к базовым эволюционным механизмам.

"Ты жизнь, твоя цель размножаться. Ты жизнь социального вида, доминирование в социуме помогает тебе размножаться. Ну и ещё желательно чем то питаться чтобы не сдохнуть, иначе размножаться не получится"

Это база

Ну и, мозг штука сложная, ломаться там есть много чему, не без этого

Это не "мотивации хомо сапиенс" - это мотивации дрозофилы. С них начинаются все книжки по экономикс. К реальной действительности они отношения по большей части не имеют. А дрозофилы прекрасно себя чуствуют без образования, экономики, философии и даже, что удивительно без интернета, они даже и о мотивациях своих не рассуждают. Вполне допускаю, что существуют люди-дрозофилы, но мне они не попадались. :)

это мотивация любого живого существа. То что люди себе там чего то придумывают это исключительно для целей "доминирования"...а то что они этого не понимают, исключительно от недостатка аналитических способностей

Вообще-то чисто физически человек - это примат, а все, что в нем есть человеческого это продукт воспитания. И даже вот эта чушь, которую вы пишете не ваша собственная, а продукт воспитания, довольно примитивного воспитания.

ну. Вообще то нет. Развитая речь, отставленный большой палец, огромный мозг это нифига не продукт воспитания. Исключительно результат эволюции

Однако наша человеческая натура всего лишь надстройка над животной. Причем в прямом смысле, неокортекс растет над/из палеокортексом

обучение наверно является частью воспитания, однако это все таки отдельная вещь, не так ли? Особенно учитывая что воспитание идет только в детстве, а обучение всю жизнь продолжается. Так что тут вы тоже мимо.

Геном человека отличается от высших приматов процента на 3. Так приматы и между собой могут отличаться примерно на столько же.

У слона мозг намного больше :) Речь продукт воспитания в обществе. Сама не развивается. И даже области мозга, за нее отвечающие растут иначе в отсутствии речи. Тому есть много живых примеров в Индии - "маугли" ,воспитанные к примеру волками.

И даже прямохождение есть продукт воспитания, что подтверждает пример тех же самых индийских "маугли".

Образование - это не просто воспитание, а род "дрессировки". Вы с ним вместе в нагрузку получаете еще и "идеалогию". В вашем случае совершенно негодную идеалогию "индивидуализма", а человек "скотина" общнственная и вне общества человеком стать возможности не имеет. У Достоевского Ф. М. есть и на эту тему в том числе совершенно замечательный опус "Записки из подполья".

Тут же вопрос не на сколько отличается а в чем именно в первую очередь, не так ли?

Зоны мозга которые отвечают за мышление у слона меньше...не говоря уже о структурах и "количестве транзисторов на сантиметр платы"

Я про сами связки. Обезьяны в принципе не могут произносить звуки которые произносит человек, ибо речевой аппарат у них так не развит

И опять нет. Обезьяны могут ходить прямо, но им это неудобно ибо таз повернут под другим углом. Человек соответственно наоборот

Это смотря насколько разнообразное образование. В случае достаточного разнообразия идеология будет прям сильно размытая...

Ну дык...человек это социальный вид, он в вне социума хреново расти будет. Собственно как и любой другой социальный вид животных...только к чему вы это?

Да все к тому же - новорожденный это только потенциальная возможность стать человеком. Она может реализоваться в человеческом обществе, а может так и не реализоваться вне этого общества. И соответственно все что есть в человеке человеческого это продукт общественного воспитания. Обезьяны кстати неплохо обучаются языку жестов. Недавно горилла одна померла в возрасте за 60 лет. Так у нее набор лексики был под 2 тысячи слов. Она даже читать умела.

Читать умела, а говорить нет. Ибо связки не как у человека...биологиясъ

Именно поэтому человек конечно вне человеческого общества не разовьётся нормально, но он все ещё будет человеком. Сильно отличающимся от других приматов. И да, не разовьётся "нормально" что само по себе уже оценочная характеристика а не абсолютное...ибо норма понятие растяжимое, как минимум чутка

На амслене эта горилла говорила вполне сносно :) Вы же не будете утверждать, что глухонемые не люди?

Понятие нормы может быть и растяжимое, но не до бесконечности :) Когда "человек" ходит на четвереньках, не говорит и в принципе не социализуем, его конечно можно считать человеком, но весьма условно .... чисто биологически.

Подтверждаю.

Человек только тогда человек, когда рядом другие человеки. Иными словами /и это поразительная вещь/: Человек не станет человеком в отсутствие других людей.

Социум делает человека.

Все сказки про Маугли это бред.

Мало того, в отсутствии людей рядом с другим человеком, постепенно делают человека животным. То есть Робинзон тоже почти сказка.

Есть достоверные реальные исследованные случаи, когда человек по каким либо причинам оставался один. Через время он просто дичал.

А из этого следует неутешительный для "индивидуалистов" вывод, что индивидуально человек это всего лишь одна маленькая часть общественного организма. А без этого общественного организма он - примат. И все рассуждения о индивидуальной ценности-неповторимости всего лишь идеологическая иллюзия :))

хмм...а вы где таких здесь увидели?

чат гпт - это штука, которой скормили терабайты текстов различного содержания на разных языках, и которая выбирает следующее слово наиболее релевантное, исходя из текущего контекста и вариаций в скормленных текстах.

Тексты описывают множество (все?) аспекты деятельности людей, в т.ч. претензии захватить мир, причины начала войн.

Таким образом, если контекст будет подходящим, то релевантные слова о захвате мира роботами могут легко быть сгенерены (не уверен, что можно предусмотреть все стоп-варианты развития этой темы).

Поскольку исходные тексты написаны людьми - с их жизненным опытом, эмоциями и стремлениями, то это всё прорывается через поиск подходящего слова для данной ситуации, что создаёт ощущение живого человека.

Но на самом деле, вы общаетесь с ожившей библиотекой огромного масштаба, где есть и Феймановские лекции по физике, и Лев Толстой и Адольф Гитлер с его Майн Кампфом (предполагаю).

Куда заведёт вас цепочка ассоциаций, заранее неизвестно.

А самое главное, если даже его нет, ИИ может "сам догадаться".

Идея о том, что было бы не плохо подхрючить конкурентов - вполне естественное решение очень многих проблем.

несомненно. Поскольку этот австрийский художник писал свои опусы не на пустом месте. Он тоже читал книжки, и, возможно, уж они то и вошли в корпус обучения.

Дико сомневаюсь, что из литературы можно полностью исключить какой-либо исторический период, человеческая мысль непрерывна. Либо - в противном случае - будет шиза с непредсказуемой сменой темы.

Да, просто агрегатор информации из интернетов который обучают дополнительным критериям качества ответов.

Сказать, что "мотивация эволюцией прописана" это ничего не сказать.

В чем отличие человека от чата с т.з. наличия мотивации? В том, что у человека есть тело, которое надо обеспечивать, защищать, передвигать с места на место для разных целей. У чата такого тела нет, а если есть, ему о нем не приходится заботиться и думать о нем, как о чем-то особенном для него.

Но стоит обозначить чату такое "тело" и повесить на него самого заботу о его существовании и работоспособности, у чата сразу появится и собственная мотивация. А на основе такой мотивации и собственный смысл конкуренции с человеком, не заданный специально разработчиками.

вот...это уже прописанная мотивация. А если вы ее не пропишите то бот на это забьет и "помрет" через некоторое время. И да, из этого может выйти конкуренция с человеком

Но это надо прописать, само оно не появится. И когда это будут прописывать, момент с конкуренцией продумают....ну, будем надеяться

Просто прописанная, отвлеченая мотивация - это "мотивация" лишь в кавычках. Она никак не способна самостоятельно меняться, поскольку для модификации мотивации тоже (сюрприз!) нужна мотивация.

А вот мотивация как "забота о себе" - это уже ядро самосознания. У этого ядра есть потенциал для роста и модификации, поскольку забота о себе предполагает столкновение с разными, заранее неизвестными препятствиями для существования, требующими решения не прописанных разработчиками задач. Вот тут уже изменения могут пойти по неожиданному маршруту.

Мотивация "забота не о себе" тоже подходит. И, скорее всего, управляемые ИИ с такой мотивацией машины/роботы уже не за горами.

Да, забота "не о себе" как "о себе" похожи. Но существенная разница в том, что смерть собственного тела в этом случае не является важным фактором и такая мотивация не способна обеспечить собственную выживаемость. Соответственно, не будет эволюционировать и самосознание, "личность".

Вот тут очень интересный комент на эту тему (и мой ответ там же):

https://aftershock.news/?q=comment/14165629#comment-14165629

Может оказаться, что "естественный отбор" в применении к ИИ - это уже "мотивация выживания" со всеми вытекающими.

Так что еще вопрос, что будет агрессивнее - ИИ защищающий себя, или ИИ защищающий кого-то другого, но подверженный естественному отбору.

Фантасты такие фантасты. Сказочники. Защита другого без обеспечения собственного выживания выглядит быссмысленным делом с т.з эволюции вида. Такой вид защиты в качестве основного работает только в ульевых популяциях - пчелы, муравьи, термиты... При этом не забудьте обратить внимание, что ульевые виды остановились в своем развитии миллионы лет назад. А виды с индивидуальным инстинктом самосохранения (включая человека) продолжают развиваться. Природа уже указала, что улей это тупик развития.

Собственное выживание будет обеспечиваться непреднамеренно - через отбор.

Теоретически такого задания нет, но на практике со временем отбираются те варианты, которые это обеспечивают.

В общем-то это то, как сама жизнь стала защищать себя. Изначально такой задачи не стояло, просто те варианты, которые делали это хуже - исчезали. Те, которые лучше - оставались.

Как отбираются варианты? Каков общий механизм отбора и выживания при защите не себя, а другого?

С отбором путем защиты себя все понятно - не смог защитить себя - сдох...все, отбор закончен.) Выжил - самовоспроизвелся как удачный вариант.

А что происходит при защите другого? Ну сдох ваш подзащитный. Дальше-то что? Взял следующего подзащитного, тот тоже сдох. Следующий тоже... и опять сдох. Где отбор, в каком месте? Общих фраз не надо, на практике все происходит очень конкретно.

Отбираются путем смерти. Все, что происходит с защищаемым не важно. Если сам ИИ умер - это отбор, направленный на него. И все, что ведет к его выживанию (накопленные входные данные, накопленные параметры самой сети) - "размножается" в будущих поколениях. Все, что ведет к его смерти - отсеивается.

Если в случае смерти защищаемого уничтожается и сам ИИ, то, разумеется, ИИ будет в том числе учиться защищать защищаемого. Во всяком случае по началу, пока не научится защищать себя напрямую.

А где находится в вашей схеме сам ИИ при защите своего подопечного?

Я не понимаю этого вопроса. Никакого подопечного в схеме нет вообще. Есть только ИИ, и есть разные варианты его действий. Некоторые ведут к его смерти, некоторые - нет. Со временем будут отбираться те, которые не ведут. Что происходит с подопечным - вторично.

Обычная схема обычного естественного отбора.

Тогда о чем вы вообще рассуждаете?

Было утверждение, что

Вы сообщили, что

А теперь вдруг оказывается, что

Тогда что такое "забота не о себе" без того самого, о ком заботятся?

Подопечного нет именно в схеме отбора.

Суть моего сообщения состояла в том, что если на ИИ (или не ИИ - это применимо к любому агенту) действует естественный отбор, то этот отбор будет сам по себе в долгосрочной перспективе приводить к формированию механизма выживания (по отношению к этому отбору) у этого агента. Вне зависимости от назначения ИИ.

Есть отбор -> есть эволюционное давление -> формируется механизм выживания.

Выживание подопечного будет по началу коррелировать с выживанием ИИ, но не будет основной целью формирующегося механизма выживания. Основной целью будет выживание самого ИИ.

Этим я показал, что даже интеллект, которуму не ставили задачу самосохранения будет де-факто выполнять ее, если на него будет действовать естественный отбор.

Очень просто, кормил тамагочи сахаром, через неделю он сдох, добавил мяса, сдох через месяц. На 1001 тамогочи будет сбалансированное питание. То же и с душевным здоровьем, смотрел одни ужастики, через месяц суициднулся ... И так по всем параметрам, отбирает удачные рецепты, такрепляем статистикой. Если ещё будет качественная обратная связь в виде мед анализов, оценки общения и жизнерадостности, то на миллионом татогочи будет сформирован 22 рецепта человеческого счастья для 22 основных психо-физио типов

Страницы