Занимаясь поиском надежных и контролируемых технологий, Пентагон старается установить глобальные стандарты использования искусственного интеллекта (ИИ). На днях консультативной группой Пентагона опубликован долгожданный проект документа, выходящий за рамки аналогичных перечней принципов, уже обнародованных крупными технологическими компаниями.

Ключевыми понятиями нового кодекса являются: ответственность, объективность, контроль, надежность и управляемость.

В конце прошлого года руководители Пентагона попросили Совет по оборонным инновациям разработать список морально-этических принципов для ИИ. Совет привлек множество экспертов по правам человека, специалистов по компьютерной технике, инженеров, исследователей, лидеров гражданского общества, философов, инвесторов, бизнес-лидеров и служащих Пентагона, включая представителей Facebook, Microsoft, Google и других подобных компаний.

Ответственность формулируется максимально просто: "Люди должны проявлять мудрость и оставаться ответственными за разработку, развертывание, использование и результаты действий систем ИИ".

Объективность предписывает осторожность при построении наборов данных, используемых в машинном обучении, чтобы, как это часто случается, необъективные наборы данных не создали расистские или расово предвзятые алгоритмы.

Контроль должен всегда позволять понять каким образом ИИ пришел к конкретному решению. Заявляется о необходимости в "проверяемости методологий, источников данных и процедур разработки и документации".

Надежность требует "явного и четкого определения области использования" и прохождения множества строгих тестов перед внедрением.

Управляемость подразумевает способность обнаружить и избежать нанесения непреднамеренного вреда: ИИ должен быть в состоянии остановить свою работу, если видит возможные проблемы от своих действий.

Руководство предполагает, что Пентагон должен обладать полным контролем над программным обеспечением ИИ: "не только проверка данных, но и кто имеет к ним доступ, для чего еще и кем используются эти модели и т.п.". Говорится, что перед каждым случаем использования ИИ не по прямому назначению, необходимо тщательное исследование целесообразности подобного использования и возможных последствий этого.

Проблема обеспечения надежности видится самой серьезной для Пентагона, поскольку предлагает совершенно новый режим тестирования нового программного обеспечения для обеспечения безопасности. Это потребует много времени и серьезных инвестиций.

Некоторые компании, такие как Google, Microsoft и Facebook, уже опубликовали свои собственные этические принципы для ИИ. Но их усилия не имели успеха. Google, например, после публикации своих принципов и созыва Совета по этике ИИ в апреле для определения насколько хорошо эти принципы соблюдаются, распустил Совет уже через неделю.

У Китая и России нет ничего, подобного этому выскокоморальному меморандуму. Вполне возможно наступит время, когда руководство Пентагона почувствует себя скованным этим кодексом. Но, в конце концов, для этого и разрабатывался документ. Пентагон не интересуют поражения в войнах, поэтому если Пентагон будет использовать ИИ опасными способами, нарушая рекомендации, это будет не потому, что у него не было правильных рекомендаций, а потому что он отказался их выполнять.

Последняя фраза настолько хороша, что ее надо бы писать на синдарине, которым я владею отвратительно, к сожалению.

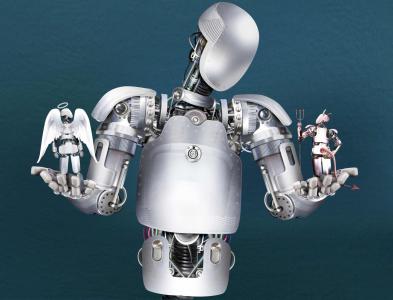

А всего 80 лет назад всё было намного проще и лаконичнее:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

/А. Азимов, 1942 г./

Комментарии

Пелевин лучше описал это в зенитных комплексах Аль-Эфэсби.

Пелевин у ФСБ в штате, поэтому на Пентагон работать не может. :)

Неправильно. Пентагон опубликовал проект лапши на уши лохторату. Нужно быть идиотом чтобы поверить в эту лапшу. Хотелки Пентагона это вам лапша, а нам всё можно. Ибо мы великие. Так Трамп в твитере сказал. а твитер Трампа это глас божий. Ну. или типа того. К счастью идиотов на планете всё меньше.

Почему это называется интеллектом? Хотя бы в кавычки бралось.

вот-вот! Что они понимают под термином "Искусственный интеллект"?

Быстрый перебор данных в таблицах(базах данных) и сравнение с входящими с разной степенью совпадений(для ускорения, поиск с несколькими уровнями. Грубый, точнее и так далее), потом спимок действий... конечно это "интеллект".

искусственный интеллект отличается от натурального тем что не способен украсть бОльшую часть денег выделенных на свою разработку:))

Потому что это самая модная военная тема для распила в этом десятилетии среди остальных "топчиков": ИИ, облачное хранение данных, мультидоменные операции, кибербезопасность, единое управление полем боя на основе анализа с овердохрена (100500+) источников данных - это Топ-5.

Именно!

Пеньтагон? Мораль? в одном контексте с однозначно позитивной коннотацией? да ну, показалось наверное...

И чего, спрашивается, мучились? Взяли бы за основу Моральный кодекс строителя коммунизма и на этом бы успокоились

Наверное, бабло пилили...

Последствия легализации марихуаны

Самое забавное, что после легалайза сначала народ американский радовался, а сейчас койотом драным взвыл: дикий произвол полиции.

В основном, на дорогах: останавливают, фальсифицируют показания, подбрасывают, завышают имеющиеся дозы "на кармане" и т.п. А потом - суд. Чтобы не связываться и не платить адвокатам, подавляющее большинство "наркоманов" идет на досудебное урегулирование со штрафом и условным сроком.

Ага, мораль дайликов проста "Уничтожить".

*далеков :)

Я вчера в книжном энциклопедию друзей и врагов Доктора видел. Около 2 тыс руб, большой формат, обслюнился,ино победила жаба.

Уже нет смысла. Доктор побеждал самых страшных врагов, но потерпел поражение от толерантности. Посоледние три сезона - это тупое толерантное говно. Чувствую, в следующем он станет содомитом.

В двенадцатом он вроде стал женщиной, я еще не досмотрел, но чернокожая лезбичнка уже мотаецца с ним по вселенной. Толерантность рулит, чернокожие господа в цилиндрах в древнем Лондоне уже факт в глазах невнимательных зрителей, история переписывается, не зря королева с будкой Доктора фотографировалась. Мораль Петнагона это еще один круг на инфополе которое переписывается.

Все уже давно есть. Им бы Чапека почитать, особенно про Три Закона Робототехники ;)

Пентагон (впрочем как и любое министерство обороны) и мораль понятия несовместимые, поэтому воспринимается данное заявление просто как скетч.

вспомнилось - "моральный кодекс строителя коммунизма"

Не вам одному. Аллюзии - наше всё! :)

главное что бы не иллюзии.

О чем с этими любителями создавать правила и подписывать договоры, а потом нарушать первые и разрывать вторые говорить? )

Кажется, не работали вы в госструктуре на руководящей должности. :) Главное здесь что? Прикрыть жопу надежной бумажкой.

Я так понимаю, что они как раз не жопу прикрывают бумажкой, а пытаются для всего Мира создать единые правила высокоморальные. Таких, которые тормозили бы развитие всех остальных. Это в их правилах. Похоже, с этой темой у них там сильно туго. Боятся быть в самом конце.

Не. Миру, а если точнее, тем кто может это сделать, глубоко плевать на их хотелки уже давно. Это чисто для внутреннего употребления. Ну... Разве что ЕС'у смогут навязать, а больше никому.

Товарищ Азимов к концу жизни придумал ещё и нулевой закон. Так что их на самом деле 4. Вполне допускаю, что, поживи он подольше, и сделай один-другой ритрит в буддийский храм, вполне мог придумать и минус первый закон.

Да, где-то в конце 80-х. Но он там просто "расширил" "человека" до "человечества", если мне память не изменяет.

Тут вопрос в том, что делать с условным Гитлером. С расширенным законом его можно разве что блокировать в условном бункере, а с нулевым законом его можно даже кокнуть.

Верно. Но Азимов все-таки оперировал условиями "единого человечества", причем не в варианте "единого мирового правительства" в сегодняшней концепции. А то все роботы бы свихнулись, пытаясь определить угрозу человечеству от "условного Путина" или "условного Трампа". :)

А зачем тогда нужно человечество если будет нечто которое может решать что для него лучше?

А как же:

?

Как пишут в словарях - уст.

Прикольно! На месте робота, прежде чем убежать, я бы этих уродов завалил. Садисты.

Моральный кодекс от Пентагона?! 8-D Опять надмозги буковки теряют. "А"-моральный. Так верно будет.