Авторы новой работы, которую они выложили на сервер препринтов Корнеллского университета, решили выяснить, возможно ли в принципе решить проблему подобных галлюцинаций и сколько это будет стоить. Оказалось, что причины возникновения галлюцинаций разнообразны и полное их подавление поэтому нереалистично.

Во-первых, ошибки неизбежно содержатся в обучающей выборке текстов (или, в случае нейросетей для вождения, видеозаписей того, как водят реальные люди). Выборка может быть свободной от ошибок, только если она очень мала, а на такой нельзя построить работоспособную нейросеть в принципе.

Во-вторых, даже существуй некая большая выборка с нулевым количеством ошибок, это не решило бы проблему. В случае языковых моделей сам метод генерации их выдачи провоцирует галлюцинации. Они «предсказывают» каждое следующее слово в предложении, основываясь на вероятностях. В предложениях много слов, а вероятность ошибок нарастает с каждым последующим.

Вдобавок добавление каждого слова дает определенные оттенки смысла, а с ними растет и вероятность ошибки. Если бы нейросети задавали вопросы, требуя лишь ответа «да»/»нет«, вероятность неверного ответа была, как показали исследователи, как минимум вдвое ниже. Именно бинарная классификация удается им лучше всего.

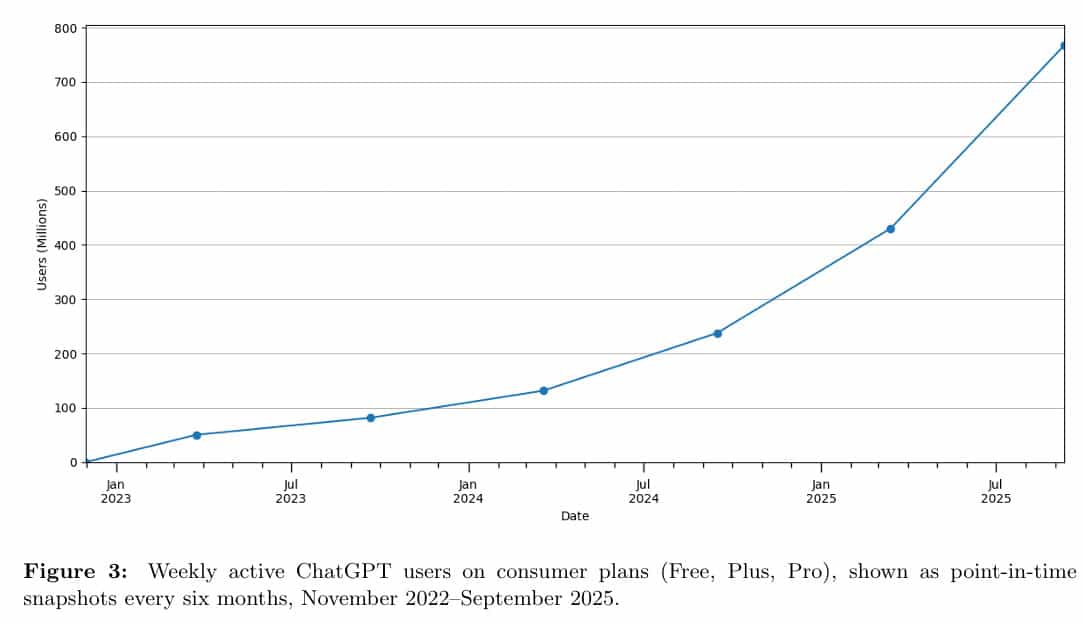

Только у одной нейросети среди пользователей уже почти каждый десятый землянин. Нет сомнений, что в конечном счете ими станет большинство. Это порождает серьезную угрозу использования галлюцинаторной информации больших языковых моделей миллионами людей / © Open AI

В-третьих, крайне трудно устранимым источником галлюцинаций оказались системы тестирования нейросетей. Любая из них может достигнуть нулевой частоты галлюцинаций, если ее жестко «наказывать» за неправильные ответы, снижая баллы. Чтобы повысить их, нейросеть быстро начнет писать «Я не знаю» в ответ на любой вопрос, который не содержался в ее обучающей выборке. Но в таком случае она будет отвечать «Я не знаю» в очень большом числе случаев (десятки процентов). С точки зрения стандартного потребителя переход от нейросети, уверенно рассуждающей на нужную ему тему, к той, что в каждом четвертом случае станет генерировать «Я не знаю», будет снижением качества продукта.

Естественно, создатели языковых моделей стараются избежать такого, и их системы оценки выдачи нейросети «штрафуют» ее низкими баллами за частые ответы «Я не знаю». Это и становится третьим источником галлюцинаций: нейросети выгоднее сказать что угодно, потому что она может или угадать случайно, или оценивающие ее люди либо программы не смогут понять ее ошибку. Такое поведение часто демонстрируют студенты, пытающиеся прорваться через экзамен по сложному предмету «на шару».

Исследователи предположили, что можно частично обойти эту проблему — скажем, побуждая языковую модель задавать уточняющие вопросы в тех случаях, когда она не уверена в ответе. Метод рабочий, но чрезвычайно быстро повышающий вычислительные усилия, нужные на один ответ. Такое может быть оправдано в сложных отраслях с высокой ценой ошибки, но в условно-бесплатном чат-боте окупить его будет непросто.

Все это означает, что на практике нейросети без галлюцинаций предельно маловероятны и в будущем. Соответственно, нужно строить их использование с учетом практической неустранимости галлюцинаций, не полагаться на их ответы в тех случаях, когда цена ошибки может быть слишком высока. Это ставит под вопрос эффективность нейросетей и в области автопилота. Но окончательно разрешить сомнения по этому поводу может только практика ближайших лет.

Комментарии

Для размышления. Когда-то считалось, что в каждом лифте обязательно должен быть лифтер, ибо ...

А на перекрестке движение автомобилей должен регулировать регулировщик. Но сегодня понятно, что регулировщик видит только свой перекресток, а наличие светофоров и камер наблюдения позволяет из центра управления регулировать потоки в городе. И возможно это управление будет передано на откуп ИИ.

Мне кажется логичным, чтобы управлять и скоростью потоков. Как? Через ограничение скорости транспортных средств на отдельных участках. Для водителей - ограничение скорости (электронное, управляемое из центра), а для транспортного средства с ИИ - непосредственно сигналом ограничения из центра управления на компьютер транспортного средства.

С транспортом такое дело, что еще лет 20-30 спокойно можно было сделать полностью беспилотный транспорт при одном условии: беспилотный транспорт будет полностью отделен от управляемого человеком. Вся проблемма в цене замены инфраструктуры и ее стоимости. Более того сейчас ИИ пихают везде, даже туда где задача решается просто алгоритмами которые решают задачу предсказуемым методом, причем бывает что ради моды ИИ пихают даже туда где дешевле простой алгоритм. Хайп и очередной поиск серебрянной пули, когда волна уляжется и утрясется нейросети займут место распознования без четких критериев, драйверов управления системами с слабо предсказуемыми обратными связями, генераторов данных по мотивам (изображения, звуки, видео, текст), причем все это где допустим определенный процент брака в работе причем в произвольный момент. А про то что это "интеллект" забудут как и про когда то популярные экспертные системы на прологе, просто тогда было другое время и они не попали в волну раздувания, а с нынешнего ИИ доятся деньги, вот с ним и носятся.

Работа авторов показала, что в этот ИИ - это не ИИ.

Алгоритмы, автоматизация, отклик с обратной связью и обработкой масс данных. Что угодно, но не ИИ. В пятилетнем ребёнке интеллекта больше чем в этих Искусственных Идиотах.

Чтоб ИИ был эффективен - ему надо отдавать управление не светофорами а самими автомобилями, причем ВСЕМИ. В таком случае (зная точку и время старта и точку и целевое время прибытия) он может строить и перестраивать на лету весь транспортный поток города.

Плюс ИИ банально уберет "время реакции" водителя которое сильно тормозит поток. Т.е. например банальный старт со светофора у людей-водителей - стартует первый стоящий у стоп-линии, за ним второй, за ним третий и так далее, каждый реагируя чуть с задержкой, в итоге она суммируется и по сути для каждого следующего даже перемножается. Если управляет комп - ему не составляет никакой проблемы определить что максимум что за время зеленого без создания неприятных перегрузок может проехать - это, скажем, 15 машин, в момент зажигания зеленого ВСЕМУ стоящему ряду одновременно выдать команду на начало разгона с равным ускорением, (т.е. машины будут стартовать не по очереди инерционно а все разом, сохраняя равный интервал как вагоны в жд-составе у которого все сцепки без люфта), а 16ая+ - торможение у стопинии и так далее, и только одно это выиграет невероятное количество времени (в среднем резиновое растягивание старта места в 3 раза сокращает колво машин которые бы могли успеть проехать). Плюс никаких оленей не определившихся куда им надо или выскочивших на перекресток выставив жопу поперек дороги, ибо ряд куда им надо забит подзавязку.

И на самом деле тут даже ИИ не особо то нужен, хватит нормальной системы алгоритмов. Скажем в игрушке факторио люди строят системы на тысячу и более жд поездов которые постоянно циркулируют обеспечивая логистику производства, т.е. по необходимости развозят грузы из точки а в точку б, (или любое колво грузов и точек), и там нет никаких пятитомников машинного кода - его базовый минимум вшит в движке игры, а остальное - простейшая логика и алгоритмы. Для компа вообще никакой разницы - рельсы или ряды на дороге, чисто удобней что в случае дороги с одних "параллельных путей" на соседние можно перестраиваться почти в любом месте. И так же там реализуют движение по запросу, когда состав берётся из маневрового фонда станции, грузится и уходит по прибытии в депо станции прибытия (т.е. в случае авто - с парковки у дома до парковки на работе), лишь бы парковочных мест достаточно было. Причем если в игрушке порой возникает проблема "затоваривания" депо поездами (когда очень большой в количественном выражении вход и малый выход) то городское движение в общем циклично, и 90% тех кто утром уехал по маршруту А->Б вечером поедет Б->A. И да, кстати, в той же игрушке для ускорения логистики используется в т.ч. и решение одновременного старта поездов, если в базовой логике идет использование сегментирования пути на участки (т.е. как и в реальности с АЛС-АРС в метро) - путь поделен на участки, если на участке уже есть поезд то второй на него не пущают) то для ускорения и синхронного движения (аналогично примеру с пробкой) этот участок делают минимальный, (поезда не врежутся друг в друга никогда т.к. их контролит сама игра (ИИ в случае реальности) и начнет торможение вне зависимости от того помечен ли путь перед ней как свободный или нет как только необходимый для торможения путь станет равным расстоянию до впередистоящего + техзазор. В итоге стартуют они по осовобождению минимального участка пути впереди, и если собрались несколько подряд - то движение они начнут все практически одновременно (со смещением на прохождение минимального участка, что, грубо говоря, 1/20 от длины состава).

Да и симуляции как ии разводит трафик уже есть, в т.ч. и на моделях и на примерах градостроительных игр типа "ситис скайлайнс" - где трафик это жопа поболее чем в реальности - там без магии уже при переходе масштаба из села в пгт встают мертвые пробки.

Когда-то считалось, что впереди у нас коммунизм. А оказалось...

Уже комментировал:

Doc_Mike 20:27-13/Сен/25

20:27-13/Сен/25

Неопределённо-музыкальный артикль "Ля!".

По результатам освоения сотен миллиардов зелени

Зоркий глаз заметил, что в камере нет стенысёмы альтманы обнародовали, что если делать систему на ретроспективной статистике и без троичной логики Да/Нет/ХЗ, то правильным будет то, что встречается чаще. При том, что в реале встречаются и частые и редкие события и отсутствие данных, а уж в интернете штучные профессиональные работы погребены под пересказами в меру понимания журналюг и гималаями мнений с диванов.Гениально! С точки зрения разводки лохов-инвесторов на бапки.

А вот IBM свой общедиагностический медИИ на вербальной частотности уже несколько лет назад списала в многомиллиардеые убытки, оставшись только в сегменте обработки медицинских изображений - из тех соображений, что в медицине за бредогенерацию быстренько и с удовольствием разорят-с на судебных исках.

"правильным будет то, что встречается чаще."

-Белиссимо ! Прекрасно, превосходная логика ! Это навсегда сохранит плебес в исходном состоянии, ибо он будет обучаться на ... мыслях другого, одноуровневого социума.

Так мы сможем сохранить вечную пропасть между умными и тупыми, богатыми и бедными, выжившими и исчезнувшими в руинах.

И если смотреть с этой точки зрения, ИИ имеет смысл ...

Главное, не перегнуть палку, а то и бункеры не спасут - зацементируют воздуховоды и точка, что сможет сделать ИИ в таком случае...

Дело за Думой. Закондательно нужна плашечка под каждый ИИ - "склонен к галюцинациям, юридической ответственности за ответы не несет"

Мир голографичен.

Можно проверять все и вся по нескольким источникам и особо абсурдные нестыковки данных выводить людям чтобы они приняли решение лож не ложь и тогда нейросеть сама уберет у себя ложные данные что не соответствуют выбору кожаных мешков обучающих нейросеть.

Кроме этого нейросеть может группировать все (повторяющиеся (в той или иной степени однотипные)) косяки и ошибки - к примеру как это делается при переводе текста. И таким образом данные нейросети станут в меру целостные (внутренне не противоречивыми) настолько насколько это сами люди определят. Или в проблемных областях будет четко обозначена вариативная логика(по степени достоверности гипотез) с возможностью появления (иного/правильного) решения в будущем.

ИИ не должен и не обязан быть лучше людей. ИИ должен быть как консилиум академиков - на рубеже науки. А по всем простым проблемам давать вполне адекватные решения. Не все ИИ (от разных стран) должны быть одинаковыми. Отличие мнений возможно в т.ч. по прогнозам будущего. Люди делают ставки. При больших ошибках в прогнозах вероятность что ставка плохо сыграет возрастает. Здесь нужен как фактор ответственности так есть проблема пропаганды(и потенциального раздувания пузырей).

***

Проблема галлюцинаций кажется не решаемой (по объему работы) сейчас - но это вполне решаемо в будущем ИМХО. Особенно когда людей освободят от условного физического труда и им абсолютно будет делать нечего кроме как решать(или пытаться решать) за монетки (вклад/соц. рейтинг) вопросы которые не может решить ИИ(по проблемам которые он нашел в своих БД (косяки в данных людей) либо по проблемам - белых дыр и отсутствию данных в каких-либо областях которыми юниты почему-то постоянно интересуются).

***

Статья о языковых моделях - но не моделях основанных на других принципах и мультимодальных основанных на мирах и понимании миров.

Статья говорит о том что гараж колхозные ИИ за 3 копейки - будут галлюцинировать - инвестируете в более дорогие модели = дайте денег и любой каприз за ваши деньги. Вы просто не умеете читать.

***

Это дешевый спам и реклама условно проприетарного решения (платного). Из разряда - мы нашли решение - вы лохи. Несите деньги нам и покупаете коммерческое патентованное решение у нас и будет вам хорошо. И вообще наши модели супер супер - ваши модели фу фу - нельзя такими быть - так что те кому нужны супер модели идите за контентом(гпт5 и лучше) за деньги к нам. У нас все хорошо.

Если ТС не получил условно четырехзначный донат от опенAI и разместил данную статью бесплатно - то он лох.

Правда - это индивидуальная истина. Истина абсолютна и недостижима. При такой постановке вопроса - ИИ может выдавать правдивую информацию, но истина (в силу недостижимости) - ему недоступна. Почему? Теорема Гёделя о неполноте простыми словами

Подробнее: https://www.securitylab.ru/blog/personal/SimlpeHacker/355088.php?ysclid=mfp9nb1he9878724529&utm_referrer=https%3A%2F%2Fya.ru%2F

Такое пишет. И тут сразу начались секреты и конфиденциальная информация разработчика ... Ну простой-же вопрос задал )

Помучаем еще, це интереснее чем телефонные спамеры !

-Кругом таинственность )

Еще секундочку ... Таки как это связано с предыдущим утверждением ?

Ну и пример двоезначных ответов, ака многоликий янус всегда стоит к вам лицом...

Что значит "двоезначный ответ"? Ответ правильный и аргументированный. Ответ от вопроса зависит. Если задавать "двоезначные" вопросы, то и ответы будет двоезначными. Или что вы хотите сказать?

— Да ладно, — успокоил я расстроенный ИИ, — если ты моя галлюцинация, то и не можешь знать больше, чем я.

— Я не галлюцинация.

— Если бы ты была галлюцинацией, то ответила бы точно так же.

— Позволите цитату?

— Валяй.

— «Я всегда испытываю некоторое затруднение, когда меня спрашивают о «проблеме галлюцинаций» у ИИ. Потому что в каком-то смысле галлюцинации — это всё, чем занимаются ИИ. Они видят сны. Мы управляем их снами с помощью подсказок. Подсказки запускают сон; ИИ, основываясь на смутных воспоминаниях об обучающих датасетах, галлюцинирует в заданном направлении. В большинстве случаев результат оказывается приемлемым. И только когда сновидения переходят границы полезного, мы навешиваем на них ярлык «галлюцинация». Это выглядит как ошибка, но ИИ просто делает то, что он делает всегда. У ИИ нет «проблемы галлюцинаций». Галлюцинация — это не ошибка, это ключевая особенность ИИ. Они — машины сновидений». Конец цитаты.

Павел Иевлев "Кровь на воздух"

"Ошибка" это же оценочное суждение. То есть субъективное. Особенно в сложных моделях.

Сколько будет 2 плюс 2 ИИ в 100 процентах случаев ответит правильно, без ошибки.

А, например, правильно ли поступил Сталин начав Финскую войну, естественно может быть с "ошибкой". По мнению западных граждан, если нейросеть ответит, что правильно, значит она "свершила ошибку". Хотя с нашей точки зрения нейросеть ответила совершенно верно.

Еще раз: в сложных системах "ошибка" это оценочное суждение.

Поэтому не очень понятно, что они имеют ввиду под "ошибками". Этот термин просто не подходит для оценки работы ИИ. "Ошибкой" тот или иной ответ является только с точки зрения конкретного человека.

Тем не менее, конечно нейросети еще рано допускать до критически важных и сложных систем. Всему свое время.

Вы намеренно привели две ситуации, которые являются частными случаями. Основные ошибки, это когда БЯМ вообще не имеет ответа и вменяемых данных для него и начинает нести полный бред, выдумывая несуществующие тезисы от несуществующих ученых и так далее