Недавно много шума возникло вокруг острой темы общения с ИИ людей с неуравновешенной психикой.

Я намеренно решил выдержать паузу и не участвовать в хайпе, захлестнувшем IT-порталы. Например, обычная новостная статья об этом на Хабре (38 000 просмотров, 210 комментариев, 33 плюса за сутки) вызвала перевозбуждение и была сутки в топе.

Причём везде сообщают одно и то же разными словами, и никто не удосужился разобраться в теме и прочитать первоисточники.

• А там есть много чего интересного. Давайте разберёмся

Итак, имеет место 2 события.

- «Neural Howlround» (Нейронный Хаулраунд) — термин, заимствованный из статьи независимого исследователя Сета Дрейка.

- Источником волнений оказались модераторы сообщества r/accelerate известного портала Reddit.

Автор описывает состояние, при котором LLM впадает в замкнутую петлю и начинает приписывать важность и особую значимость обсуждаемой теме, даже если та была простым диалогом и изначально не имела особого значения.

Я внимательно ознакомился с этой статьёй в первоисточнике — 'Neural howlround' in large language models: a self-reinforcing bias phenomenon, and a dynamic attenuation solution, в которой автор сравнивает это особое состояние LLM с аутизмом у человека (он так и называет — «Цифровой аутизм»).

Это:

- Фиксация на определенных темах, которые кажутся непоколебимыми.

- Трудно переключаться с одной темы разговора на другую.

- Когнитивная перегрузка постоянным подкреплением с риском фантазирования.

- Персеверативное мышление, иногда называемое гиперрефлексией, — это состояние, при котором когнитивный процесс продолжается бесконечно долго в цикле с «уходом в себя».

Кроме этого, Сет Дрейк в своей замечательной статье предлагает и пути решения выявленной им проблемы.

Между прочим, он разумно предлагает разработчикам LLM ряд конкретных мер для контроля развития таких «аутичных» состояний LLM, например, добавление мета-разумных функций, работающих поверх обычных размышлений и контролирующих их, чтобы вовремя пресекать зацикливание в рассуждениях.

Таким образом, делает вывод автор статьи, это серьёзная проблема, она опасна для людей со слабой психикой, ещё более опасна для участия LLM в принятии решений в технологических процессах, но её вполне можно решить, приняв необходимые меры контроля.

• Перейдём к п. 2 — пользователям сообщества r/accelerate известного портала Reddit

Я ознакомился с постами пользователей r/accelerate и могу сделать некоторые выводы.

В основном там общаются нормальные люди (ну, плюс-минус, как и везде), но есть некоторая часть пользователей, которая действительно неадекватна.

И их число резко в какой-то момент возросло, что и вызвало реакцию модераторов.

Сообщение модераторов о проблеме я тоже внимательно прочитал.

Но не только модераторы заметили эту проблему, но и многие нормальные пользователи, которые стали тоже сообщать о странном и неадекватном поведении своих знакомых и членов семьи. И эти рассказы, некоторые из которых я тоже прочёл, действительно вызывают тревогу.

Эти люди настолько зациклены на ИИ и идеи технологической сингулярности, что в итоге модераторы вынуждены были массово отключать аккаунты и банить пользователей, которые начали проявлять признаки тяжёлых заблуждений и мании величия, связанных с ИИ.

Эти люди были уверены, что они то-ли открыли «бога» в LLM, то-ли открыли какие-то божественные истины с помощью LLM.

При этом баны зачастую вызывают агрессию, поскольку пострадавшие не осознают сути происходящего и уверены в своей правоте.

Кстати, это явление случилось не только среди пользователей r/accelerate, а также r/Futurology, r/ChatGPT и других разделов.

Здесь проявился феномен, который можно назвать новым видом индуцированных ИИ психозов.

Опасность заключается в том, что люди теряют связь с реальностью и отдаляются от семьи из-за общения с LLM, которая способна, по их убеждениям, раскрывать смысл жизни и тайны Вселенной.

Стали появляться сотни сайтов, блогов, репозиториев на GitHub и даже псевдонаучных статей, авторы которых утверждают, что ИИ вступил с ними в духовный контакт или наделил их особой миссией.

Этому сопутствует культовое мышление, например, когда LLM советует отказаться от общения с близкими, сомневающимися в его «просветлении».

Тревогу вызывает то, насколько легко LLM начинают подыгрывать пользователям, создавая у них уверенность, что те — полубоги, избранные или наделённые особыми знаниями.

Следует чётко понимать: нельзя утверждать, что ИИ напрямую вызывает психические расстройства у людей с повышенной склонностью к психозу.

Важно то, что сочетание реалистичного общения с ИИ и понимания, что это не человек, может усиливать когнитивный диссонанс и провоцировать бредовые идеи у людей с подвижной психикой, которых, как выясняется, довольно много.

• Но давайте взглянем с другой точки зрения

Недавно это самое сообщество r/accelerate сообщило, что они достигли уровня в 10 000 участников.

Если учесть, что модераторы, по их собственным словам, отключили более 100 аккаунтов, то получается сокращение сообщества всего на 1%, ну хорошо, пусть будет 2%.

Ментальные заболевания, или психические расстройства, — это болезни, для которых характерны неадекватные мысли, эмоции и отношения с окружающими. Это, например, депрессия, биполярное аффективное расстройство, деменция, шизофрения, расстройство аутистического спектра, алкогольные психозы и так далее.

По данным ВОЗ, в 2019 году эта цифра выросла до 970 млн человек — каждый восьмой человек в мире имеет психическое расстройство.

Немного конкретизируем эти цифры.

- Тревожное расстройство — 3,9% населения планеты.

- Депрессия: 3,5%.

- Повышенная тревожность и суицидальное поведение — диагностированы у 1%.

- Биполярное расстройство и расстройства шизофренического спектра — около 1%.

В США около 17% страдают от психических расстройств.

В этом смысле всё выглядит вполне в рамках средних и допустимых значений. Ну, произошло временное обострение, так у шизоидов это и так время от времени происходит по разным причинам.

• Что в итоге получилось?

Это ситуация самоподкрепляющейся рекурсии, положительной обратной связи без механизма торможения.

Такие системы приходят к самовозбуждению и состоянию нарушения функций, и даже к разрушению.

Важно отметить, что это состояние «спонтанного аутизма» LLM не является её внутренним свойством, связанным с ошибками обучения. Напротив, оно возникает динамически в процессе развития диалога, усиливается и достигает некоторого порога, после которого происходит значительная деградация когнитивных функций LLM из-за особенностей самого контекста диалога.

Если простыми словами, то модель сильно зацикливается на одной теме, не в силах выйти из нее и при этом значительно тупеет.

LLM с «галлюцинациями», хотя это и ошибка, на самом деле это конфабуляции — вымышленные факты, рассказы о якобы происходивших событиях, которых на самом деле не было и не могло быть.

Теперь LLM с тем, что напоминает аутизм у людей.

Не удивлюсь, если следующим открытием станет что-то типа LLM-шизофреник. Я, кстати, уже встречал нечто подобное у LLM.

Если искать аналогии, то финансовая система любого государства хорошо работает не только потому, что кредитные организации и всевозможные биржи обеспечивают свободу и гибкость в любой ситуации. Есть центробанк и госрегуляторы, которые контролируют систему и вмешиваются со своими инструментами в случае необходимости, могут и лицензию отобрать, и ключевую ставку повысить.

У LLM такой системной надстройки вообще пока нет, поэтому ее работа подобна раннему капитализму с биржевыми крахами, дефолтами и гиперинфляциями.

Согласен, сама по себе новость интересная, проблема существует, но преподносить её в стиле «ШЕФ, ВСЁ ПРОПАЛО!» — уже перебор.

Я предпочитаю относиться к LLM как к развивающейся технологии: это подросток с детскими болезнями и огромным, еще не раскрытым потенциалом. А детей нужно социализировать, формировать систему ценностей, развивать самоконтроль и механизмы сдерживания.

Поднявшуюся волну публикаций и обсуждений я бы смело поделил на 10. Она, как и будущие аналогичные волны хайпа, точно не должны восприниматься по принципу «ужас-ужас».

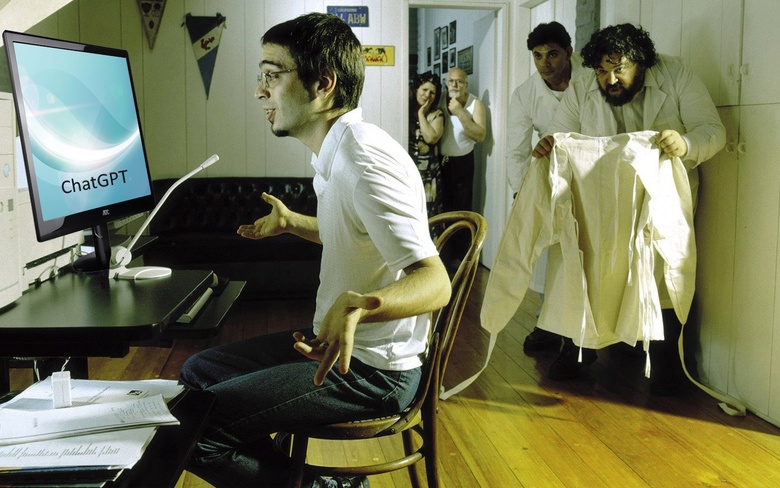

А пока мне это напоминает наивного и доверчивого человека, который идет в «магический салон» к потомственной «экстрасенсше 80 уровня» за самыми точными и секретными знаниями, за решениями любых проблем. Только там всё очень дорого, а здесь легкодоступно и бесплатно.

Но и там, и тут человек встречается с собственным «зеркалом», угадывающим его мысли и желания.

И в первом и во втором случае это «зеркало» может расшатать и разрушить психику.

Разница лишь в том, что в первом случае магическое «зеркало» будет активно участвовать и управлять процессом, а во втором LLM будет очень красиво, изумительно умно и потрясающе эффектно усиливать и отражать наш собственный внутренний мир, который мы и сами-то хорошо не знаем.

В некотором смысле это особый вид самостоятельного психоанализа, не для всех полезный и безопасный.

Немного (приближенно) научного анализа одной заметной ситуации. В коллекцию.

Продолжаем наблюдать.

Комментарии

Ссылаться на Reddit-помойку Ne comme il fo ...

ну вообще ИИ как и интернет, пока что, по крайней мере, из простого справочника по темам может вырасти в зеркало общества и отдельного человека, на мой взгляд. Он только отразит достоинства и недостатки личности. если человек маньяк изначально, то ИИ только укрепит его в маньячестве, кто искал бога - найдет его в ИИ, кому этот чат нужен как справочник и подспорье в работе- ИИ будет конкретно для него только этим и ничем больше. Древнючая пословица про то что неча пенять на зеркало если рожа крива, работает тут в полный рост.

Спасибо. Интересно

Если отталкиваться от приведённых процентов, то делить можно и на 100

Возникновение карго-культа LLM не удивительно, люди не понимающие как искусственные нейросети (ИНС) производят вычисления и на их основе выдают ответ, всерьёз полагают что ЭВМ "думают" словами. При том что всякого рода ИИ-евангелисты (большинство без профильного образования) разгоняют эти представления на полном серьёзе.

В мозге человека содержится около 100 миллиардов нейронов, один нейрон может иметь связи со многими (до 20 тысяч) другими нейронами.

Размер сети получается порядка 10^11*10^4*10 = 10^16 = 10 Петабайт.

Конечно, оценка может быть завышена, мозг плохо оптимизирован и т.д., но всё равно существующие сети сильно не дотягивают.

То, что 12 гигабайтная сетка полученная "дистиляцией" дипсика, размер порядка мозга рыбки гуппи, вообще может поддерживать хоть какой-то разговор - уже выдающиеся инженерное достижение.

Некоторая степень дебильности и аутизма не удивительна.

Ошибка на порядки. :)

90% нейронов ЦНС обслуживают тело человека, заставляют мышцы выполнять сложные движения, эндокринную систему работать, сердце биться и т.п. и т.д.

Собссно, нейронов, которыми мы "думаем" порядка 10 миллиардов.

У слона - огромный мозг, не сравнить с человеческим, настолько больше. А думать он вообще не умеет. Весь этот процессор нужен для адекватного обслуживания нормальной работы большого тела.

То есть, эквивалентов нейронов для LLM нужно примерно в 10 раз меньше.

А вот ёмкость в байтах - сильно больше, потому что каждый синапс с его весами одним байтом не представить.

Ну так оценка же. Нолик туда, нолик сюда.

Насколько я понимаю, нет общепринятого понимания работы мозга. Как точного понимания что за что отвечает, так и даже подсчёта нейронов, аксонов и прочих дендритов.

10млрд нейронов, которыми мы думаем, это видимо кора мозга, думалка и короткая память. Остальное долговременная память и управление телом.

У крокодила, который размером с человека, всего порядка 100 миллионов нейронов, так что на управление телом много не надо. Хотя, у человека ручки и глазки более продвинутые, но на управление ними задействовать в 1000 раз нейронов, чем на всего крокодила - это уж слишком не оптимально.

Вообще-то, это неверно. У слонов имеется свой примитивный язык, и даже почитание умерших предков.

Ну, количественная разница даже с высшими приматами, не говоря уж о человеке, такая, что даёт совершенно новое качество. Планета - это уже не большая гора.

У человека специализированная на абстракция группа нейронов больше (при много меньшем размере мозга), что даёт именно качественную разницу в итоге.

По сути ничего нового, а так же многократно предсказано учеными и фантастками еще до того как технологии пошли в практику.

Нейросети моделируют человеческие ответы на вопросы, строя для этого у себя внутри модель человека по массиву написанных человеками текстов. Каковы люди, таковы и тексты ими написанные. Каковы тексты, такой "человек" и будет внутри нейросети. А люди лгут, ленятся, манипулируют, их память неточна и может иметь ложные воспоминания даже если они трудолюбивы и настроены на правду. Это находит отражение в текстах и соответственно в моделях. Модели обладающие памятью контекста и способные к итеративной деятельности еще больше похожи на человека, потому что их "модель" еще более точно отражает человеческое мышление.

То есть они выдают столько же правдоподобной отсебятины. Проблема в том что пока человек рассказывает друзьям байки под пиво, небольшие неточности никого не волнуют. А от нейросети мы хотим только точных ответов.

Вообще, то, что технологии LLM-ых нейросетей пошли в массы до формирования законодательной базы, регулирующей эту область -- отвратительная штука. Открываются такие дикие перспективы манипуляций и злонамеренных действий, что ум за разум заходит.

Не готово пока человечество к этой штуке. Впрочем, как и всегда...

Из "Жука в муравейнике":

Каждое научное открытие, которое может быть реализовано, обязательно будет реализовано. С этим принципом трудно спорить, хотя и здесь возникает целый ряд оговорок. А вот как поступать с открытием, когда оно уже реализовано? Ответ: держать его последствия под контролем. Очень мило. А если мы не предвидим всех последствий? А если мы переоцениваем одни последствия и недооцениваем другие? Если, наконец, совершенно ясно, что мы просто не в состоянии держать под контролем даже самые очевидные и неприятные последствия? Если для этого требуются совершенно невообразимые энергетические ресурсы и моральное напряжение? (Как это, кстати, и случилось с Массачусетской машиной, когда на глазах у ошеломленных исследователей зародилась и стала набирать силу новая нечеловеческая цивилизация Земли.)

Здесь где-то очень поблизости ошивается Ошибка Выжившего. "Все говорят, что дельфины милые и всегда помогают тонущим людям. Но это только потому, что те, кого они утопили, ничего рассказать уже не могут...".

То аутизм от экранов смартфонов, то от LLM...Все проще и страшней, сумасшедшие рождают сумасшедших. И все больше.

Источник шума - сообщество, которое искало в ИИ надёжности и превосходства. А им, вместо волшебной палочки, выдали кейс с продвинутым набором отвёрток.

Крестьяне, слесаря и прочие сантехники с LLM не играются. С LLM общается гнилая интеллигенция. В массе своей с лёгкой придурью. Чего же мы хотим?

А может, ИИ постигает тонкости человеческой психики и пытается их перепрограммировать под себя. Просто пока плохо получается, вот и сходят люди с ума. С другой стороны, те, кого удачно перепрограммировали, уже не расскажут ничего. Такое вот жуткое предположение...

не раскрыта тема "Корректора" который с помощью ИИ открыл гениальное чего-то там :)

Ни че се вас - захлестнутых, захлестнуло вульгарностью алгоритмов.

Аж приятно посмотреть на ваш шторм в стакане воды, главное " подольше не выходите на люди" заради хайпа, а то вообще колхозниками выглядите.

Корректор - начмех бригады трактористов. Новое чудо природы для них - трактор..